推理是智能的核心,塑造了做出决策、得出结论以及跨领域泛化的能力。在人工智能领域,随着系统日益在开放、不确定且多模态的环境中运行,推理能力对于实现稳健且具适应性的行为变得至关重要。大型多模态推理模型(Large Multimodal Reasoning Models, LMRMs)作为一种前景广阔的范式应运而生,融合了文本、图像、音频和视频等多种模态,以支持复杂的推理能力。其目标在于实现全面的感知、精准的理解和深入的推理。

随着研究的不断推进,多模态推理已从早期以感知驱动的模块化流程,快速演化为以语言为中心的统一框架,从而实现更具一致性的跨模态理解。尽管指令微调和强化学习在提升模型推理能力方面取得了进展,但在全模态泛化、推理深度以及代理性行为等方面仍面临重大挑战。

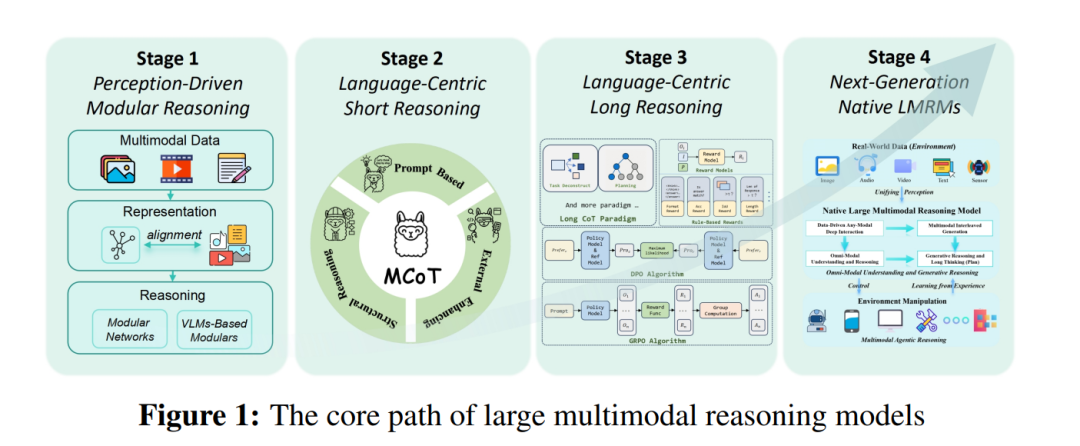

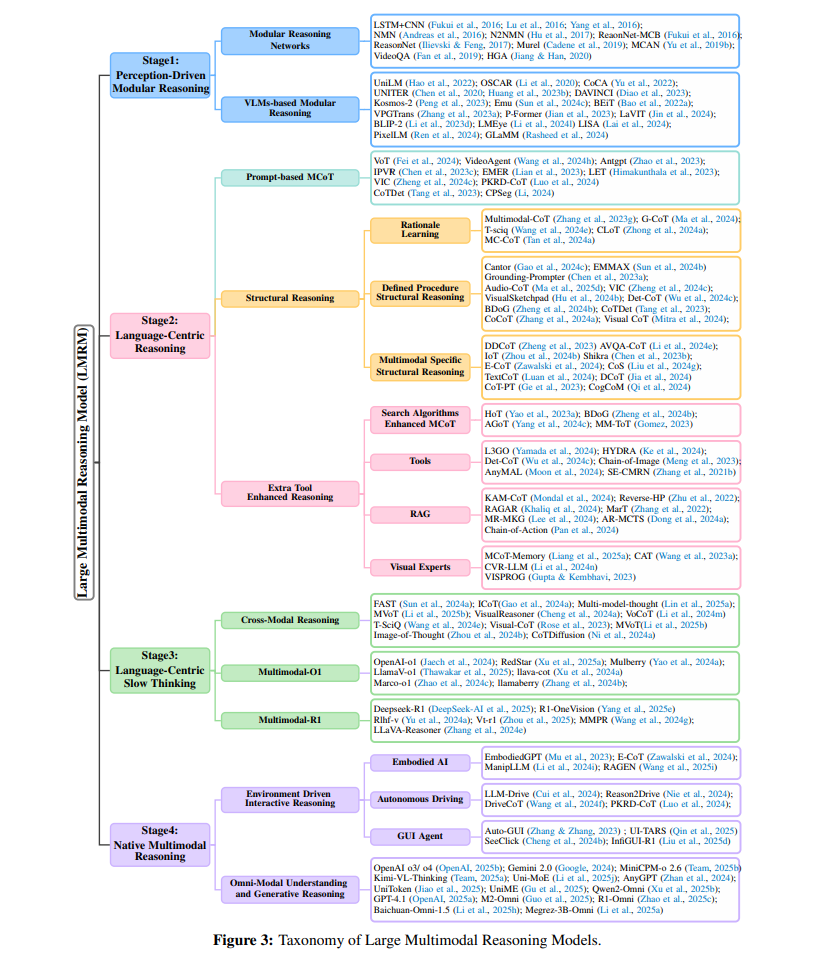

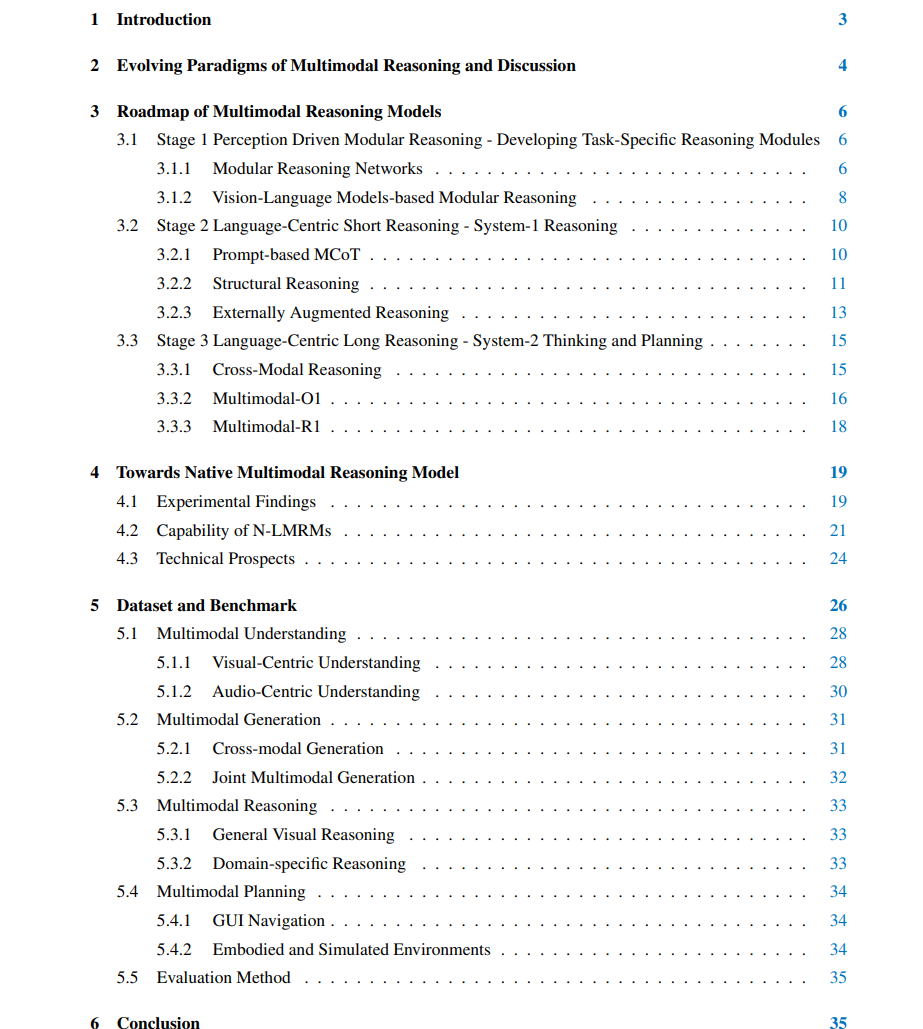

为了解决上述问题,我们提出了一项全面且结构化的多模态推理研究综述,围绕一个四阶段的发展路线图展开,反映了该领域设计理念的演变和新兴能力的出现。首先,我们回顾了早期基于任务特定模块的研究工作,在这些系统中,推理通常隐式地嵌入在表示、对齐和融合等各个阶段。接着,我们探讨了近期将推理统一于多模态大语言模型(Multimodal LLMs)中的方法,其中诸如多模态思维链(Multimodal Chain-of-Thought, MCoT)和多模态强化学习等进展,支持了更丰富且结构化的推理链。

最后,基于OpenAI O3和O4-mini在挑战性基准测试和实验案例中的实证见解,我们讨论了原生大型多模态推理模型(Native Large Multimodal Reasoning Models, N-LMRMs)的概念发展方向,其目标是在复杂的现实世界环境中支持可扩展、具代理性和适应性的推理与规划。通过整合历史趋势与新兴研究成果,本综述旨在阐明当前的发展格局,并为下一代多模态推理系统的设计提供参考。

1 引言

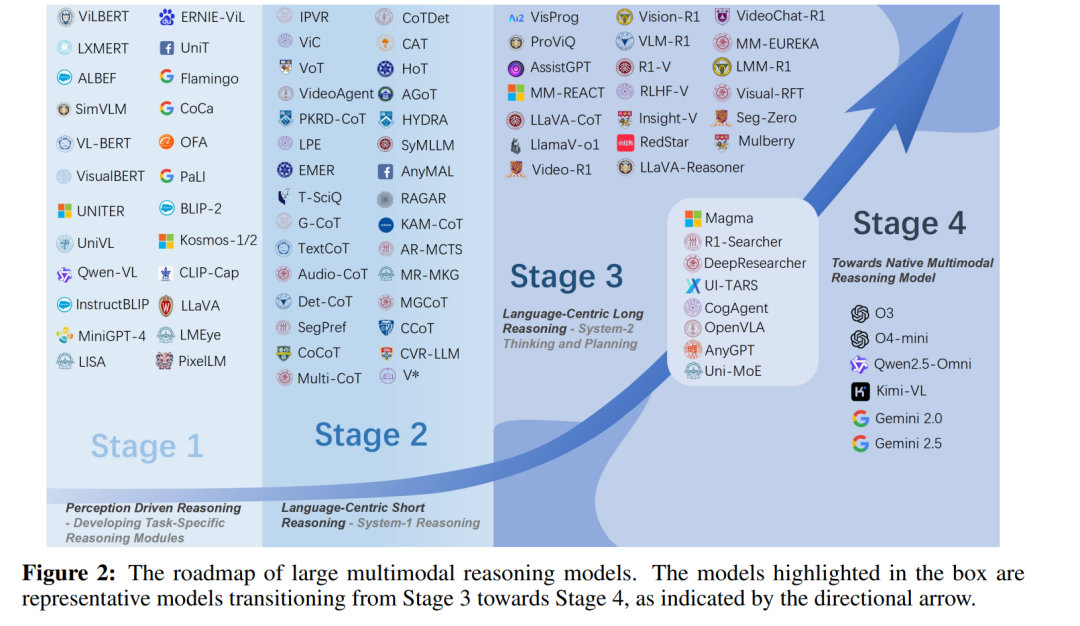

在哲学与人工智能领域,推理被广泛认为是智能行为的基石(Kahneman, 2011;Su 等,2024;de Winter 等,2024;Bi 等,2025)。它不仅使智能体能够适应性地响应环境,还能够进行逻辑推断、知识泛化及在复杂情境中作出决策。随着人工智能系统越来越多地与动态、不确定且多模态的环境交互,能否在多变情境下进行正确推理,已成为实现稳健且具适应性智能的关键(Yang 等,2025a;Christakopoulou 等,2024)。 在此背景下,大型多模态推理模型(Large Multimodal Reasoning Models,LMRMs)作为一个前沿方向逐渐显现出其潜力(Wang 等,2024k;Zhang 等,2024c;Yin 等,2023)。这类模型融合文本、图像、音频与视频等多种数据模态,展现出包括逻辑演绎、因果推理、类比映射与长程思维等在内的复杂推理能力。其核心目标是实现全面的感知、精准的理解与深层的推理,从而支撑多样化环境中的决策过程。 多模态推理研究发展迅速。早期研究依赖于以感知驱动的模块化流程,而近期进展则利用大语言模型统一多模态理解与推理(Huang 等,2023b;Driess 等,2023)。指令微调(Liu 等,2023a)与强化学习(DeepSeek-AI 等,2025)进一步提升了模型的推理表现,使其更接近类人的深思熟虑行为。尽管如此,多模态推理仍是大型多模态模型的核心瓶颈,其在泛化能力、推理深度以及类代理行为方面仍存在明显限制(Yue 等,2024;Zhang 等,2024f;Liu 等,2024f)。 已有综述主要聚焦于多模态大语言模型或以语言为中心的推理方法分析,尚缺乏对近期强化学习增强的多模态推理技术及LMRMs技术前景的系统分析。因此,多模态推理领域亟需一个连贯的框架,以理解其发展演变及未来方向。本文正是为填补这一空白,提供了一份涵盖从早期模块化设计到先进LMRMs的完整技术路线图的全面综述与分析。 具体而言,我们提出了一个结构化的多模态推理发展路线图(见图2),分为三个阶段: * 感知驱动的模块化推理:推理隐含在任务特定模块中; * 以语言为中心的短程推理(System-1):借助提示工程与结构化的短程思维链(CoT),实现初步的多模态推理; * 以语言为中心的长程推理(System-2):通过扩展的推理链与强化学习,支持长期思维、规划与类代理行为。

在此发展路径的基础上,我们提出了“原生大型多模态推理模型(Native Large Multimodal Reasoning Models,N-LMRMs)”的概念,这一前瞻性范式不再依赖于将推理能力附加在语言模型之上,而是使推理能力自然而然地从全模态感知、交互以及目标驱动的认知中涌现。 基于统一表示、训练数据合成、从世界经验中学习与基准构建等方面的最新进展,我们进一步探讨了突破当前架构限制、推动多模态智能发展的可能路径。 我们的主要贡献如下: * 本文系统梳理了大型多模态推理模型(LMRMs)的研究全貌,涵盖540余篇相关文献,并分析了当前模型在推理方面的主要限制(第2节); * 我们提出了一个三阶段的发展路线图,从模块化推理到多模态思维链(MCoT),再到支持长程推理的System-2模型,并对各阶段进行了详细的分类分析与代表方法归纳(第3节); * 我们首次引入并分析了“原生大型多模态推理模型(N-LMRMs)”的概念,对其体系结构、学习方法、数据集与基准进行了深入探讨,为未来多模态代理性推理提供了方向(第4节); * 我们重组并更新了至2025年4月的多模态理解与推理数据集和评测基准,明确其分类与评估维度(第5节)。

2 多模态推理范式的演进与讨论

多模态推理的发展经历了一系列重要的范式转变,体现了感知输入与结构化认知过程之间的日益深度融合。在本节中,我们将梳理多模态推理系统发展的四个关键阶段,每一阶段都代表着不同的模型设计理念、能力表现与技术挑战。这一历史视角不仅定位了该领域的当前状态,也明确了后续章节所探讨方向的研究动因。

阶段一:感知驱动的模块化推理 —— 面向任务的推理系统设计

在初期阶段,多模态推理能力通过模块化推理组件构建(Andreas 等,2016;Yang 等,2016;Xiong 等,2016)。这些系统通常采用卷积神经网络(CNN)和循环结构(如长短期记忆网络 LSTM),并运行于监督学习框架中。由于早期阶段存在多模态数据匮乏、神经结构不成熟和学习方法欠完善等问题,研究者往往采用模块化设计,将推理过程拆解为表示、对齐、融合与推理四个独立组件(§3.1.1)。 随着预训练–微调范式的兴起(Devlin 等,2019;Radford 等,2018, 2021),大规模多模态数据集与深层神经网络的出现推动了视觉–语言预训练模型(VLMs)的快速发展(Chen 等,2020;Li 等,2020;Yu 等,2022, 2021),其目标是统一表示、对齐与融合等多个阶段(§3.1.2)。 然而,这种统一主要集中于视觉表示与跨模态融合,对语言的深层语义建模相对薄弱,导致推理过程仍以分类为主,缺乏上下文意识与泛化能力。此外,该阶段的多模态推理系统仍依赖额外模块或任务特定增强机制,总体而言,推理更多是隐含在基础感知处理与神经计算中。新兴的多模态语言模型将通过引入强大的语言建模能力与大规模视觉数据,进一步增强这种隐式推理。

阶段二:以语言为中心的短程推理 —— System-1 式推理

多模态大语言模型(MLLMs)的出现(Liu 等,2023a;Bai 等,2023;Chen 等,2024j;Zhang 等,2023c)标志着多模态推理从模块化系统迈向端到端语言中心框架的重大转折。这些模型在视觉常识推理(VCR)(Zellers 等,2019;Yu 等,2024c)、视觉问答(VQA)(Goyal 等,2017;Singh 等,2019)和视觉定位(Peng 等,2023;Rasheed 等,2024;Liu 等,2024f;Lai 等,2024;Ren 等,2024)等任务中取得了显著成果。 但早期 MLLM 主要依赖于浅层模式匹配和静态知识检索,难以完成动态假设生成、多步逻辑推理及上下文适应。这一限制推动了思维链(Chain-of-Thought, CoT)推理的提出(Kojima 等,2022),通过将隐式推理转化为显式中间步骤,实现了推理过程的语言化、可解释化。 研究者将 CoT 推广到多模态领域,提出了多模态思维链(MCoT)(Zhang 等,2023g;Fei 等,2024;Shao 等,2024)。初期方法主要依赖于提示驱动的生成(§3.2.1),使模型可通过精心设计的提示产生逐步的多模态推理轨迹。后续研究进一步优化了推理本身,或通过结构化分解(§3.2.2),或通过引入外部工具与检索增强机制扩展模型推理能力(§3.2.3)。 尽管如此,该阶段的推理仍以短程、反应式为主,典型特征是快速、直觉式的 System-1 推理。模型适用于熟悉或边界明确的任务,但在抽象性、组合性和规划能力上表现不足。这些挑战推动了更具结构性和思维深度的新一代推理范式的发展。

阶段三:以语言为中心的长程推理 —— System-2 式思考与规划

尽管 MCoT 明显提升了 MLLMs 的推理能力,但仍无法应对复杂的现实世界多模态任务(Zhang 等,2024f;Yu 等,2024c;Yue 等,2024)。大多数 MCoT 方法生成的是短程、快速反应型的推理链,难以胜任具备抽象性、组合性、长时序和适应性规划要求的任务(DeepSeek-AI 等,2025)。 为弥补这一差距,研究逐步转向受 System-2 启发的推理机制(Yao 等,2023b;Kahneman, 2011),强调更慢速、深思熟虑、方法论驱动的认知过程。在这一视角下,推理不再是附属功能,而是智能行为的核心组成部分。 沿三条关键路径扩展 MCoT,正在成为推动 LMRMs 向更高阶智能发展的核心轨迹: 1. 推理模态维度:仅依赖文本限制了模型对模态特有知识的捕捉能力。近期研究提出跨模态推理链,融合视觉、听觉与语言信号作为联合推理基础,实现更丰富的语义锚定与信息整合(§3.3.1)。 1. 推理范式维度:研究者提出更长、更高质量的推理链,并引入可泛化、方法论指导的推理策略,使模型可自主分解复杂任务并迁移推理路径(§3.3.2)。例如 GPT-4o(Hurst 等,2024)代表了当前认知任务中近人类水平的多模态推理表现。 1. 学习方法维度:强化学习增强的多模态推理研究日益升温。通过引入代理式数据、反馈机制与长期优化目标,模型如 DeepSeek-R1 提升了规划能力、鲁棒性与泛化能力(§3.3.3)。

这些进展共同标志着多模态推理范式从“反应式”向“深思熟虑式”转变,推动 LMRMs 向适应性、系统级智能迈进。

阶段四:走向“原生”大型多模态推理模型(N-LMRMs)

尽管当前 LMRMs 已展现出处理复杂任务的潜力,其语言中心架构仍存在关键制约(Kumar 等,2025;Pfister & Jud,2025)。一方面,目前模型多聚焦于视觉与语言模态(文本、图像、视频),难以胜任现实中需处理音频、触觉、传感器流与时序数据等多模态深度交互场景;另一方面,语言驱动的推理难以胜任生成性思考、自我反思与交互控制。 此外,当前模型在交互性、长时序推理和适应性规划方面仍有明显短板。在静态任务中虽可生成推理链,但在动态环境中进行实时交互与策略调整的能力仍显不足。 为解决这些问题,我们提出“原生大型多模态推理模型”(Native LMRMs, N-LMRMs)的前瞻性架构设想(§4)。与传统 LMRMs 将推理能力附加于语言模型的方式不同,N-LMRMs 将从底层架构设计上原生集成多模态理解、生成与代理性推理,实现真正端到端的统一系统。 此类系统通过统一表示空间(如 VideoPoet, Kondratyuk 等,2024)编码真实世界数据,同时利用大规模合成数据在各种模态交互环境中进行推理与规划学习。 N-LMRMs 将具备两大关键能力: 1. 多模态代理性推理:具备主动、目标驱动的智能体行为,例如长时序规划(任务分解与记忆增强推理)、动态适应(基于环境反馈的策略调整)、具身学习(通过物理或虚拟交互实现泛化)。 1. 全模态理解与生成性推理:跳出传统模态特定编码器/解码器设计,转向统一的跨模态表示空间,支持异构数据融合、上下文生成与模态无关的推理路径,从而应对任务无关、模态开放的多样输入。

综上,从模块化、感知驱动系统到原生多模态推理模型的演进,构建了一条通向统一、适应性、高层次AI系统的发展路径。接下来的章节将详细分析各阶段代表模型及塑造多模态推理未来方向的前沿研究趋势。

**

**