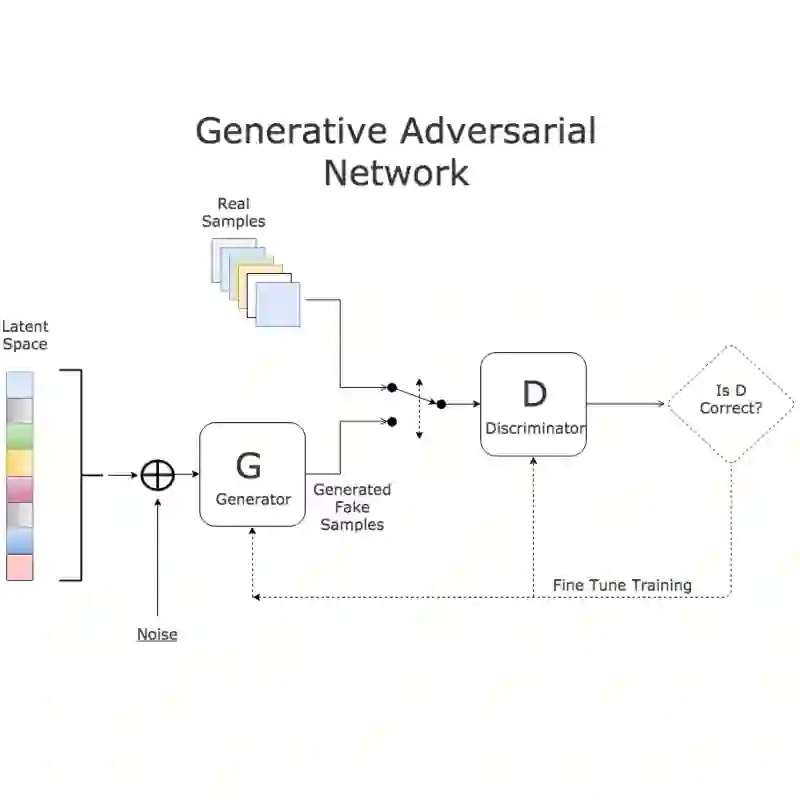

随着工业界对深度学习模型的使用越来越广泛,机器学习即服务(MLaas)逐渐兴起,也利用了这些模型创造了可观的收入。由于这些深度学习模型可以轻松地被未经授权的第三方抄袭与剽窃,深度学习模型的知识产权 (IPR)保护也因此成了各公司会专注的问题。虽然目前已有用于卷积神经网络(CNN)的 IPR 保护方法,但是却不能直接使用在生成对抗网络(GANs)——另一种被广泛用于生成逼真图像的深度学习模型。因此,本文提出了一种基于黑盒与白盒的 GAN 模型 IPR 保护方法。实验结果表明,本方法并不会损害 GAN 本来的性能(如图像生成、图像超分辨率以及样式转换)。本方法也能够抵御去除嵌入的水印(removal)和模糊(ambiguity)攻击。本次分享将会解说如何基于黑盒与白盒的方式保护对抗生成网络(GANs),以及如何抵御各种水印攻击。

https://www.zhuanzhi.ai/paper/60a2152ff08a2ea98f6b6ebfa45cedb2

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2021年6月22日