简介:

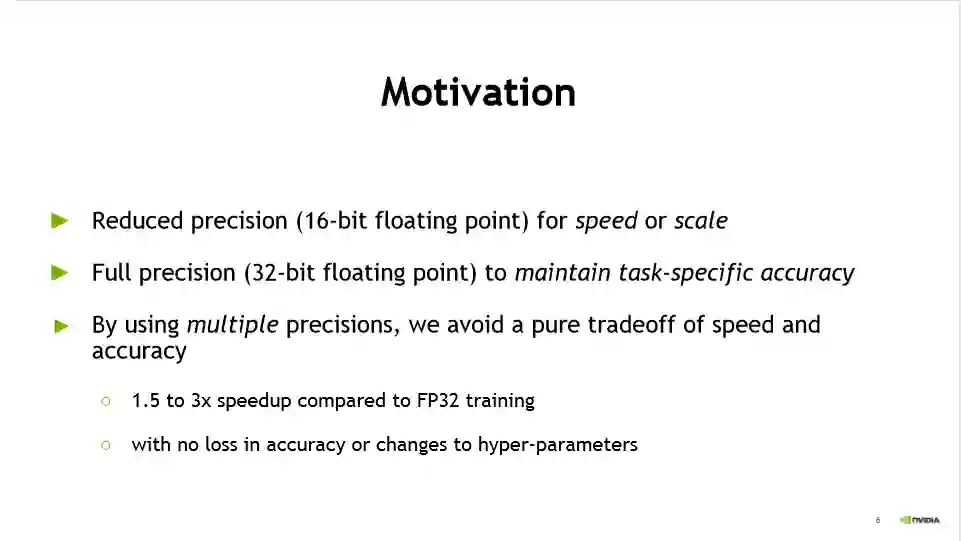

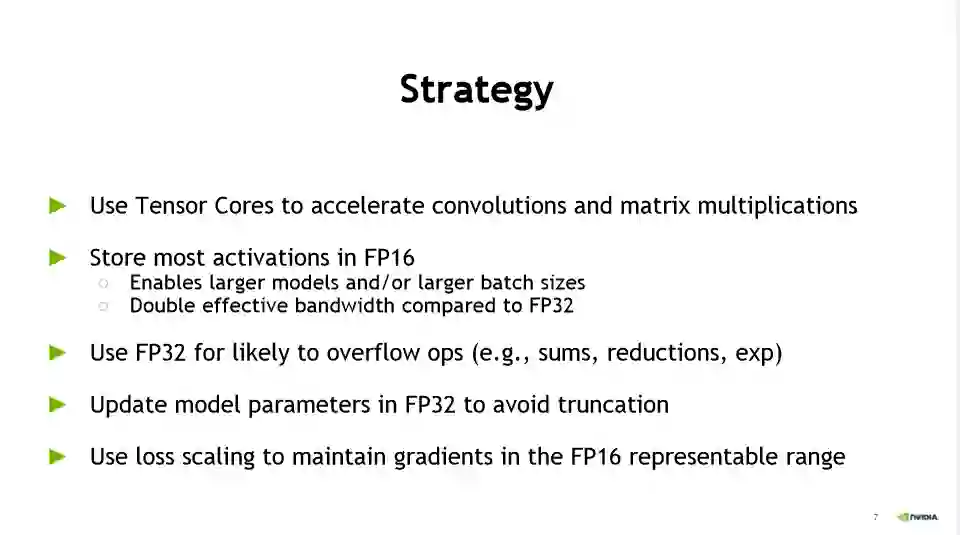

Maggie Zhang,Nathan Luehr,Josh Romero,Pooya Davoodi和Davide Onofrio深入研究了用于加速深度学习训练和推理的通用深度学习和机器学习工作负载的技术。 通过本教程将了解DALI如何消除现实应用中的I/O和数据处理瓶颈,以及自动混合精度(AMP)如何轻松地在Volta GPU上的训练性能提高3倍。 您将看到使用Horovod进行多GPU和多节点扩展的最佳实践。 他们使用深度学习探查器来可视化TensorFlow操作并确定优化机会。 本教程将教读者学习使用TensorRT(TRT)中的INT8量化来部署这些训练有素的模型,所有这些都将在TensorFlow框架的新型便捷API中进行。

嘉宾介绍:

Maggie Zhang是NVIDIA的深度学习软件工程师,她在深度学习框架上工作。 她获得了澳大利亚新南威尔士大学的计算机科学与工程博士学位。 她的研究方向是GPU和CPU异构计算,编译器优化,计算机体系结构和深度学习。

Nathan Luehr是NVIDIA的一名高级开发人员技术工程师,他致力于加速深度学习框架。 他拥有斯坦福大学的博士学位,在那里他致力于加速GPU上的电子结构计算。

Josh Romero是NVIDIA的一名开发技术工程师。 他在GPU计算方面拥有丰富的经验,从移植和优化高性能计算(HPC)应用程序到深度学习的最新工作。 Josh拥有斯坦福大学的博士学位,其研究重点是开发新的计算流体动力学方法以更好地利用GPU硬件。

Pooya Davoodi是NVIDIA的高级软件工程师,致力于在NVIDIA GPU上加速TensorFlow。 之前,Pooya从事Caffe2,Caffe,CUDNN和其他CUDA库的研究。

Davide Onofrio是NVIDIA的高级深度学习软件技术营销工程师。 他专注于NVIDIA的面向开发人员的深度学习技术开发和演示。 Davide在生物识别,VR和汽车行业的计算机视觉和机器学习工程师方面拥有多年经验。 他在米兰理工大学获得了信号处理博士学位。