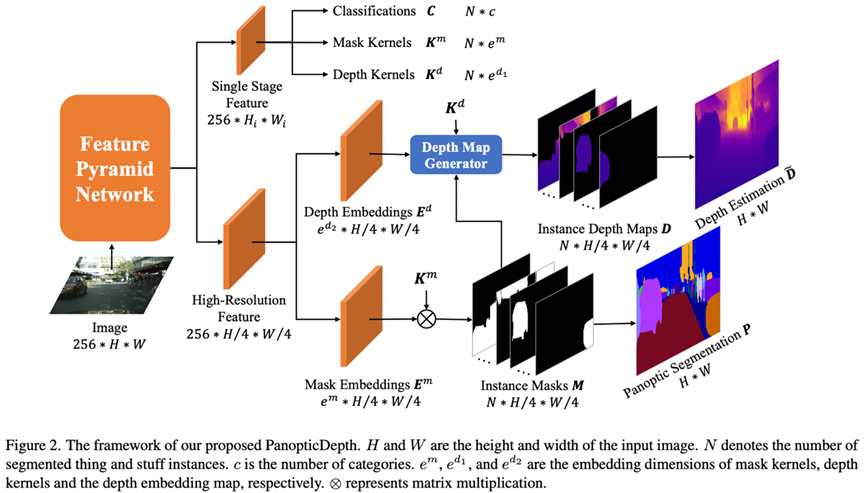

深度感知全景分割旨在从单幅图像的重建3D语义场景。现有方法直接对全景分割模型添加密集预测式单目深度估计分支解决此问题,在深度估计中仅考虑了像素级底层特征,缺乏对实例级几何信息的利用,实例掩码和深度估计方式的不统一也导致多任务间信息交互的不足。为克服这些限制,本工作探索了实例掩码和深度估计的联合建模问题,提出了更加统一的深度感知全景分割方法。该方法将对全图的深度估计分解至各个实例分别学习预测,并在模型推理阶段根据实例掩码组合在一起。同时,为了缓解不同实例间深度分布范围差异过大导致的实例间共享特征难以学习的问题,本工作将实例深度图进一步解耦为归一化实例深度图、实例深度缩放系数和实例深度偏移系数,并同时使用像素级和实例级监督信息指导深度估计的学习,通过减少搜索空间实现了算法性能的提升。实验结果表明,本工作所提出的方法在多个数据集上实现了相对基准方法更优的性能,尤其是显著提升了在前景物体上的掩码和深度估计性能,验证了方法的有效性。

作者:Naiyu Gao, Fei He, Jian Jia, Yanhu Shan, Haoyang Zhang, Xin Zhao, Kaiqi Huang

成为VIP会员查看完整内容

相关内容

专知会员服务

15+阅读 · 2022年3月19日

专知会员服务

8+阅读 · 2022年3月12日

专知会员服务

38+阅读 · 2020年3月23日

Arxiv

0+阅读 · 2022年4月19日

Arxiv

0+阅读 · 2022年4月15日