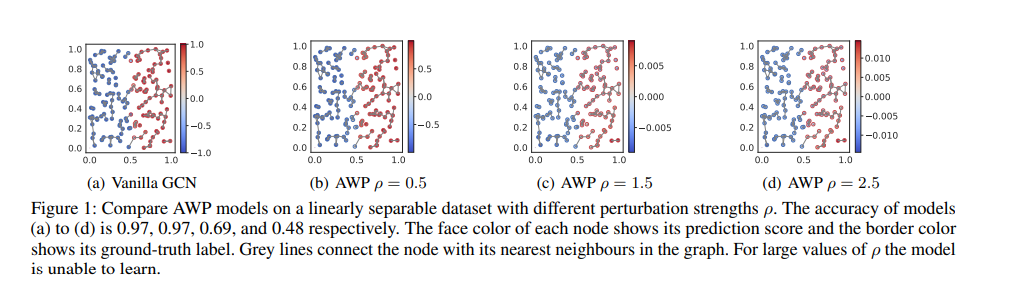

大量理论和经验证据表明,较平坦的局部最小值倾向于提高泛化能力。对抗权重扰动(Adversarial Weight Perturbation,AWP)是一种快速有效地寻找这种最小值的新兴技术。在AWP中,我们最小化损失w.r.t。模型参数的有界最坏情况扰动,从而有利于在其周围邻域内具有小损失的局部最小值。AWP的好处,以及平坦度和泛化之间的联系,已经被广泛研究了i.i.d.数据,如图像。本文针对图数据广泛研究了这一现象。在此过程中,我们首先推导出非i.i.d的泛化界。节点分类任务。用所有现有的AWP公式确定一个消失梯度问题,并提出一种新的加权截断AWP (WTAWP)来缓解这个问题。用WT-AWP正则化图神经网络,持续提高了许多不同图学习任务和模型的自然和鲁棒泛化能力。

成为VIP会员查看完整内容

相关内容

Arxiv

21+阅读 · 2018年12月25日