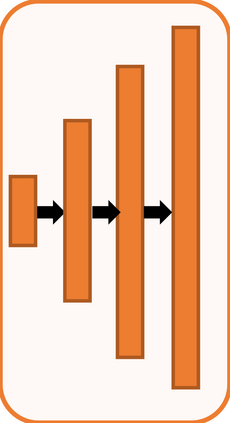

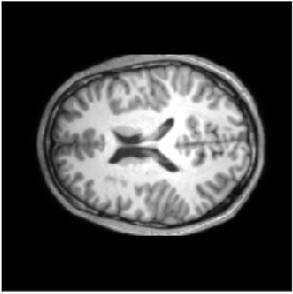

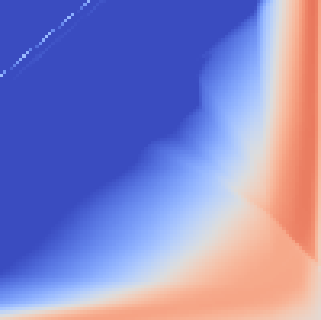

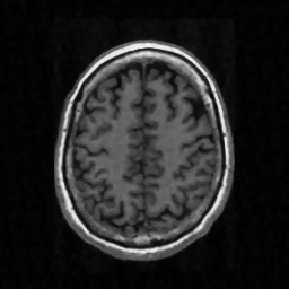

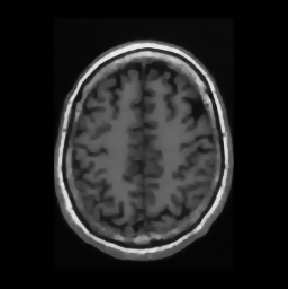

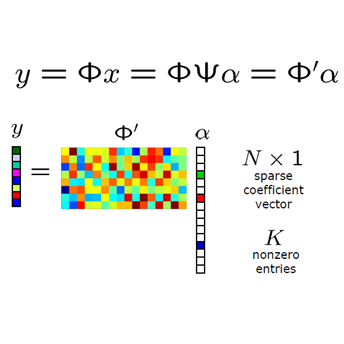

Reconstructing under-sampled k-space measurements in Compressed Sensing MRI (CS-MRI) is classically solved with regularized least-squares. Recently, deep learning has been used to amortize this optimization by training reconstruction networks on a dataset of under-sampled measurements. Here, a crucial design choice is the regularization function(s) and corresponding weight(s). In this paper, we explore a novel strategy of using a hypernetwork to generate the parameters of a separate reconstruction network as a function of the regularization weight(s), resulting in a regularization-agnostic reconstruction model. At test time, for a given under-sampled image, our model can rapidly compute reconstructions with different amounts of regularization. We analyze the variability of these reconstructions, especially in situations when the overall quality is similar. Finally, we propose and empirically demonstrate an efficient and data-driven way of maximizing reconstruction performance given limited hypernetwork capacity. Our code is publicly available at https://github.com/alanqrwang/RegAgnosticCSMRI.

翻译:在压缩遥感 MRI (CS-MRI) 中重新构建下标的 k- 空间测量系统( CS- MRI) 中, 典型地用正规化的最小平方解决了典型的典型问题。 最近, 利用深层次的学习, 培训重建网络, 以抽样化测量的数据集对重建网络进行培训, 以此来进行优化。 这里, 关键的设计选择是正规化功能和相应的重量。 在本文件中, 我们探索了一种新的战略, 即利用超网络生成单独的重建网络参数, 以正规化重量作为参数的函数, 从而形成一个正规化的、 正规化的重建模型。 在测试时, 对于一个未标定的图像, 我们的模型可以快速以不同数量的正规化来计算重建。 我们分析了这些重建的变异性, 特别是在总体质量相似的情况下。 最后, 我们提出并用实验性地展示了一种高效和数据驱动的方法, 以有限的超网络能力来最大化重建绩效。 我们的代码公布在 https://github. com/ lanqr/ RegAgAgnotictictic CSMRI 。