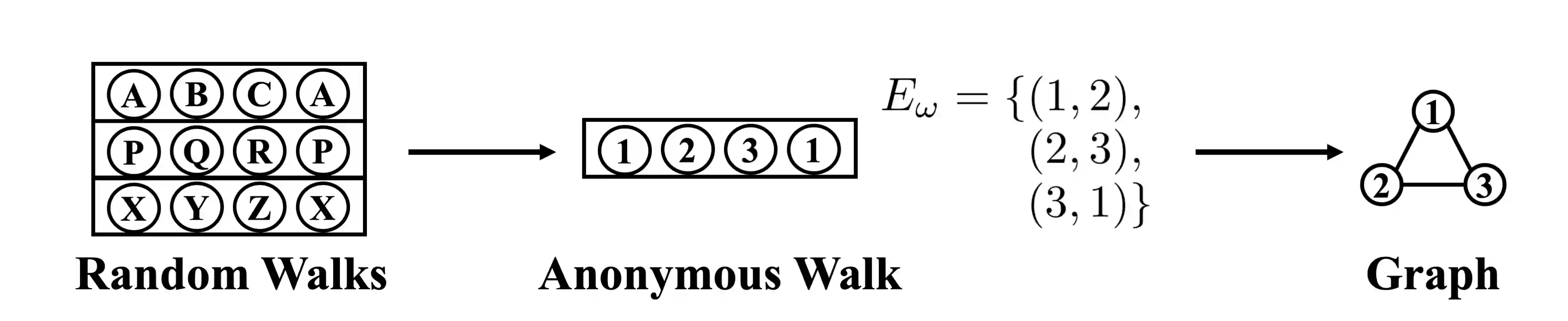

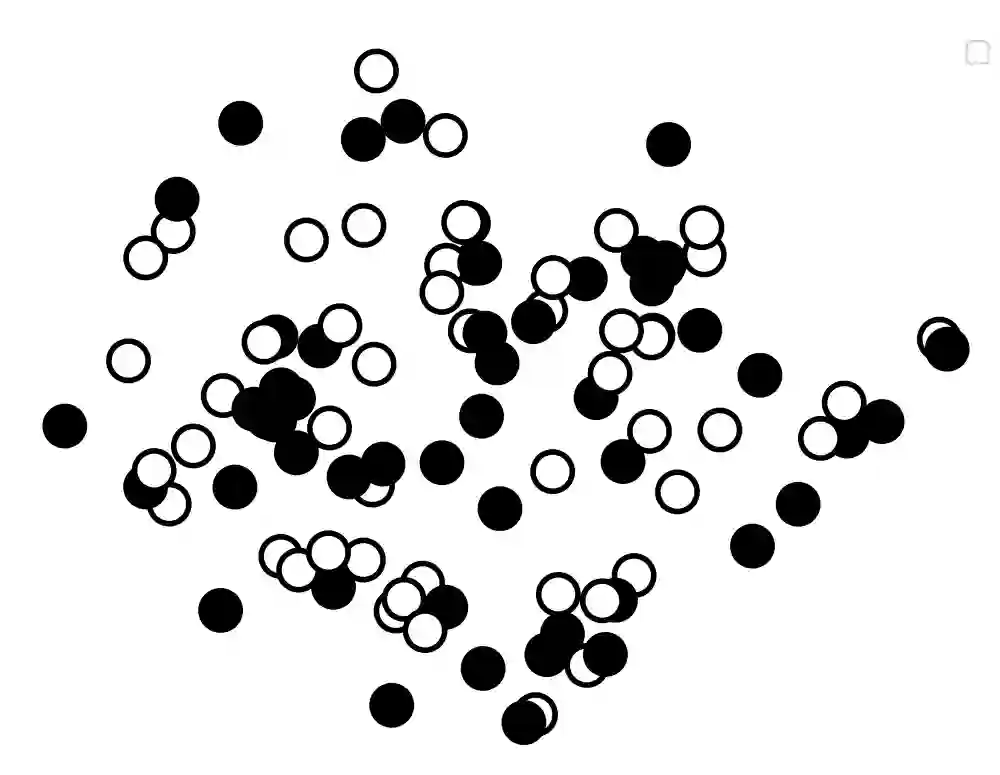

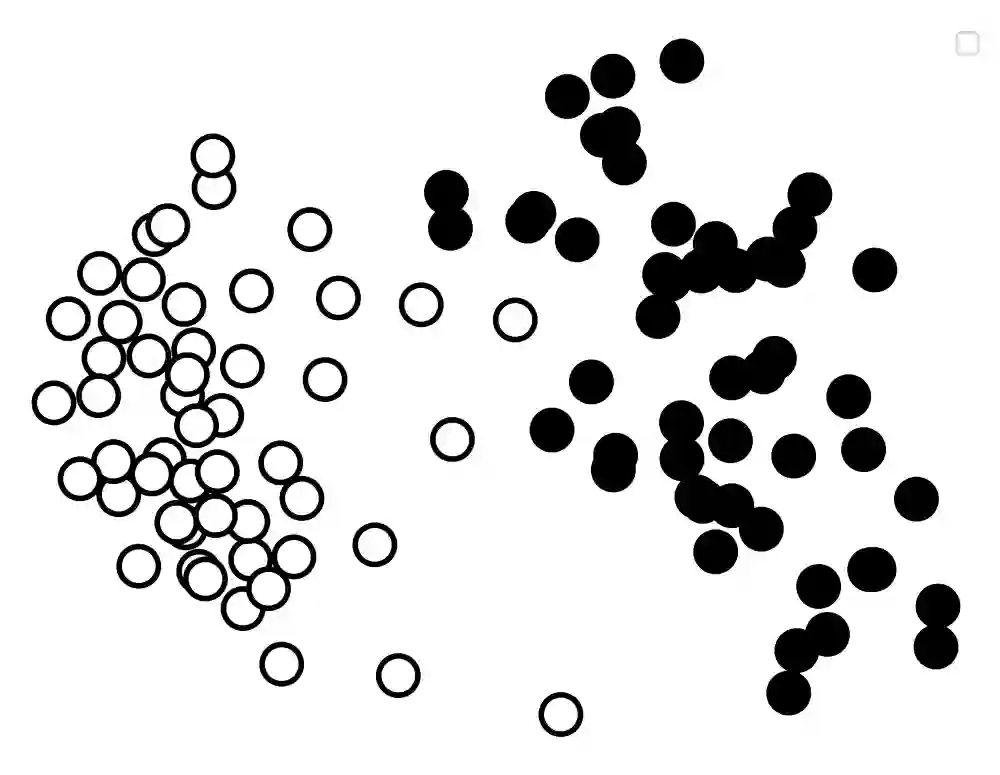

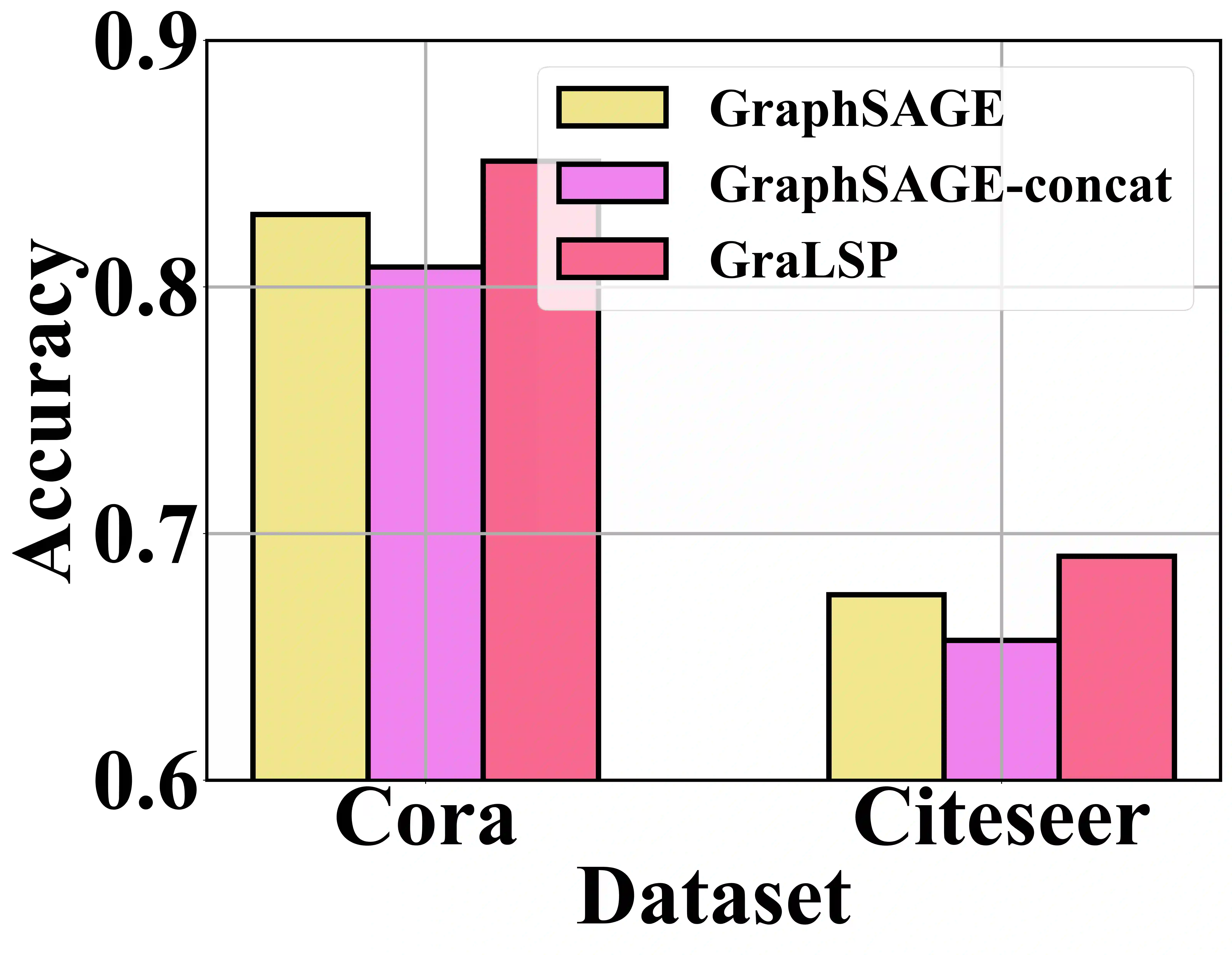

It is not until recently that graph neural networks (GNNs) are adopted to perform graph representation learning, among which, those based on the aggregation of features within the neighborhood of a node achieved great success. However, despite such achievements, GNNs illustrate defects in identifying some common structural patterns which, unfortunately, play significant roles in various network phenomena. In this paper, we propose GraLSP, a GNN framework which explicitly incorporates local structural patterns into the neighborhood aggregation through random anonymous walks. Specifically, we capture local graph structures via random anonymous walks, powerful and flexible tools that represent structural patterns. The walks are then fed into the feature aggregation, where we design various mechanisms to address the impact of structural features, including adaptive receptive radius, attention and amplification. In addition, we design objectives that capture similarities between structures and are optimized jointly with node proximity objectives. With the adequate leverage of structural patterns, our model is able to outperform competitive counterparts in various prediction tasks in multiple datasets.

翻译:直至最近,才开始采用图形神经网络来进行图形表达学习,其中,那些基于集合一个节点周围的特征的图示学习取得了巨大成功;然而,尽管取得了这些成就,但全球神经网络在确定一些共同的结构模式方面显示出缺陷,这些共同的结构模式不幸地在各种网络现象中起着重要作用;在本文件中,我们提议GRALSP,这是一个GRALSP框架,它通过随机匿名散步将地方结构模式明确纳入周边集合。具体地说,我们通过随机匿名散步、强力和灵活的代表结构模式的工具来捕捉地方图形结构。然后,将散步输入到特征汇总中,我们设计各种机制来处理结构特征的影响,包括适应性可接受的半径、注意力和增殖。此外,我们设计的目标能够捕捉各种结构之间的相似之处,并且以不偏近的目标来优化。由于结构模式的恰当杠杆作用,我们的模型能够在多个数据集的各种预测任务中超越竞争对手。