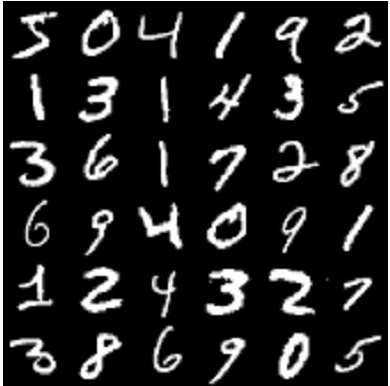

This paper is concerned with image classification based on deep convolutional neural networks (CNNs). The focus is centered around the following question: given a set of candidate CNN models, how to select the right one that has the best generalization property for the current task? Present model selection methods require access to a batch of labeled data for defining a performance metric, such as the cross-entropy loss, the classification error rate, the negative log-likelihood, and so on. In many practical cases, however, labeled data are not available in time as labeling itself is a time-consuming and expensive task. To this end, this paper presents an approach to CNN model selection using only unlabeled data. This method is developed based on a principle termed consistent relative confidence (CRC). The effectiveness and efficiency of the presented method are demonstrated by extensive experimental studies based on datasets MNIST and FasionMNIST.

翻译:本文涉及基于深层进化神经网络(CNNs)的图像分类。 焦点集中在以下问题:鉴于一组有线电视新闻网候选模型,如何选择对当前任务具有最佳一般属性的正确模型?目前的模型选择方法要求获得一组贴标签的数据,以确定性能指标,如跨物种损失、分类误差率、负日志相似度等等。然而,在许多实际情况下,标签数据无法及时提供,因为贴标签本身是一项耗时和昂贵的任务。为此,本文只用未贴标签的数据来介绍有线电视新闻网模型的选择方法。这一方法是根据一个称为一致相对信任(CRC)的原则制定的。基于数据集MNIST和FasionMNIST的广泛实验研究证明了所呈现的方法的有效性和效率。