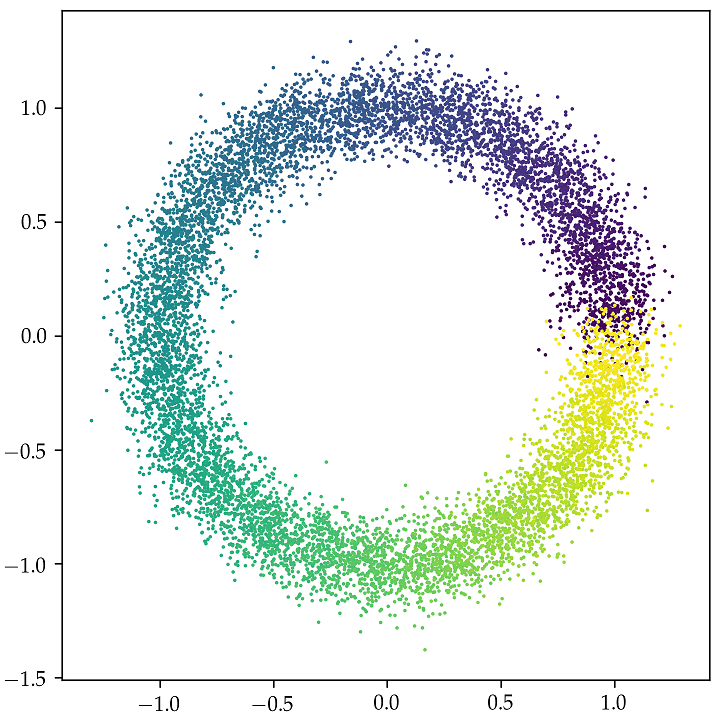

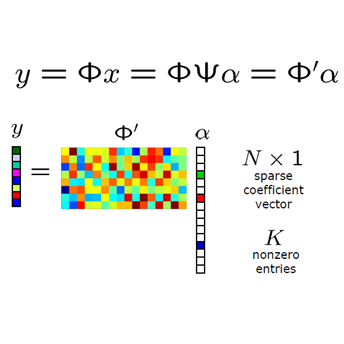

Sparse manifold learning algorithms combine techniques in manifold learning and sparse optimization to learn features that could be utilized for downstream tasks. The standard setting of compressive sensing can not be immediately applied to this setup. Due to the intrinsic geometric structure of data, dictionary atoms might be redundant and do not satisfy the restricted isometry property or coherence condition. In addition, manifold learning emphasizes learning local geometry which is not reflected in a standard $\ell_1$ minimization problem. We propose weighted $\ell_0$ and weighted $\ell_1$ metrics that encourage representation via neighborhood atoms suited for dictionary based manifold learning. Assuming that the data is generated from Delaunay triangulation, we show the equivalence of weighted $\ell_1$ and weighted $\ell_0$. We discuss an optimization program that learns the dictionaries and sparse coefficients and demonstrate the utility of our regularization on synthetic and real datasets.

翻译:粗化的多元学习算法结合了多种学习和稀有优化技术,以学习可用于下游任务的特点。 压缩感测的标准设置无法立即适用于这个设置。 由于数据固有的几何结构, 字典原子可能是多余的, 并且不符合限制的等量属性或一致性条件。 此外, 多重学习强调学习本地几何, 这没有反映在标准的 $@ ell_ 1$ 最小化问题中。 我们提议加权 $_ 0$ 和加权 $\ ell_ 1$ 公尺, 以鼓励通过适合以字典为基础的多元学习的邻里原子进行表达。 假设数据来自Delaunay 三角, 我们显示加权 $\ ell_ 1$ 和加权 $\ ell_ 0$ 的等值。 我们讨论一个最优化方案, 学习字典和稀薄系数, 并展示我们在合成和真实数据集上的正规化作用 。