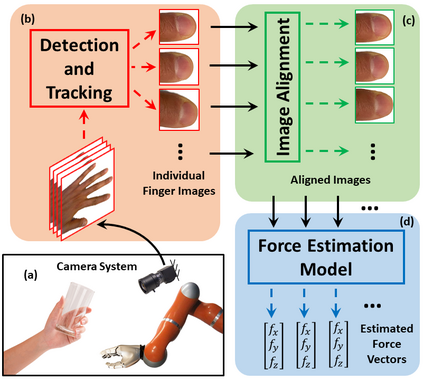

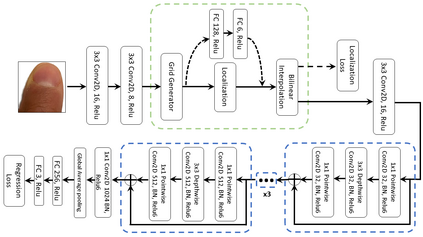

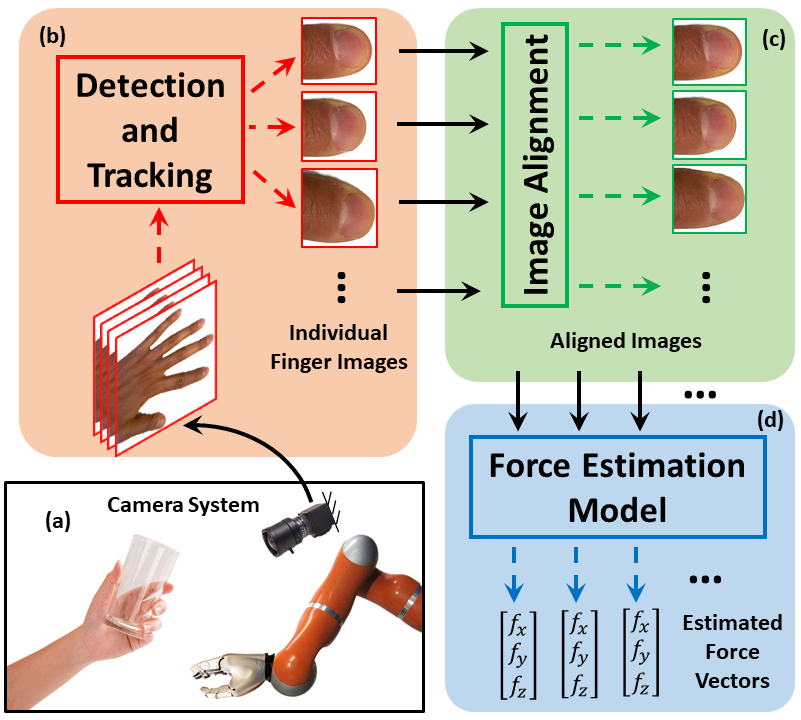

This paper has introduced a novel approach for the real-time estimation of 3D tactile forces exerted by human fingertips via vision only. The introduced approach is entirely monocular vision-based and does not require any physical force sensor. Therefore, it is scalable, non-intrusive, and easily fused with other perception systems such as body pose estimation, making it ideal for HRI applications where force sensing is necessary. The introduced approach consists of three main modules: finger tracking for detection and tracking of each individual finger, image alignment for preserving the spatial information in the images, and the force model for estimating the 3D forces from coloration patterns in the images. The model has been implemented experimentally, and the results have shown a maximum RMS error of 8.4% (for the entire range of force levels) along all three directions. The estimation accuracy is comparable to the offline models in the literature, such as EigneNail, while, this model is capable of performing force estimation at 30 frames per second.

翻译:本文引入了一种新颖的方法,用于实时估计人体手指通过视觉产生的三维触动力。 引入的方法完全以单镜视觉为基础,不需要任何物理力传感器。 因此,它可以伸缩、不侵入,并且很容易地与其他感知系统(如身体姿势估测)结合,使它在需要强制感测的情况下对HRI应用进行理想化。 引入的方法由三个主要模块组成:用于检测和跟踪每个手指的手指的手指追踪、用于保存图像空间信息的图像校正以及用于根据图像色化模式估算三维力量的力模型。 该模型已经实验实施,其结果显示在所有三个方向上都出现了8.4%的最大射线误差(整个力级范围)。 估算准确性可以与文献中的离线模型(如EigneNail)相比,而该模型能够以每秒30个框架进行武力估测。