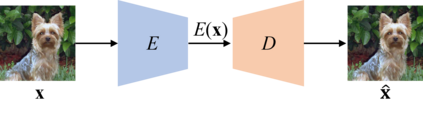

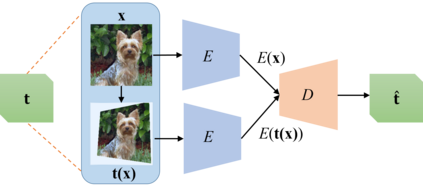

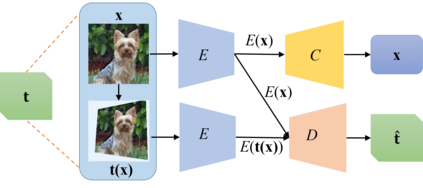

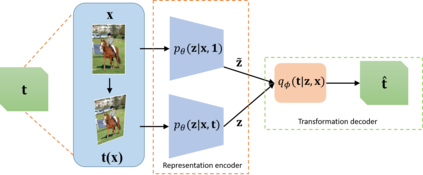

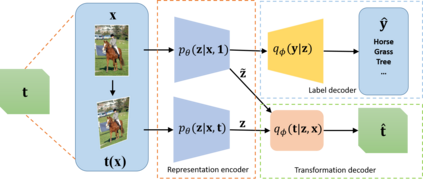

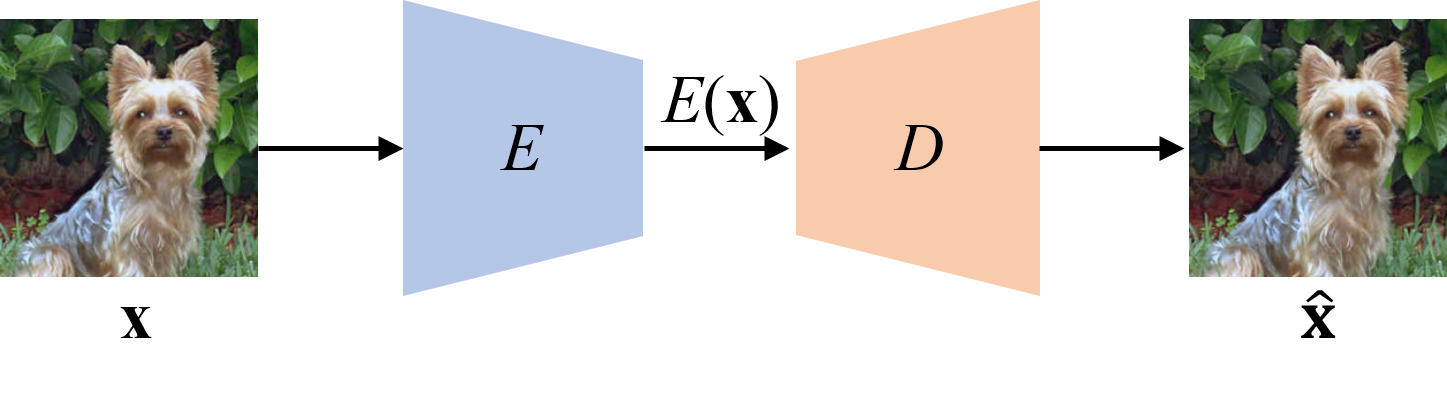

Learning Transformation Equivariant Representations (TERs) seeks to capture the intrinsic visual structures of images through the representations that equivary to the applied transformations. It assumes that a transformation should be decoded from expressive representations of images before and after transformations. It greatly expands the scope of {\em translation} equivariance pinpointing the success of the Convolutional Neural Networks (CNNs) to develop a generic class of {\em transformation} equivariant representations. Unlike group equivariant convolutions that are limited to discrete transformations or linear transformation equivariance, we present a more flexible and tractable AutoEncoding Transformation (AET) model that can handle various types of transformations. Both deterministic AET and probabilistic Autoencoding Variational Transformations (AVT) models are presented. While the former trains transformation equivariant representations by directly reconstructing applied transformations, the latter is trained by maximizing the joint mutual information between the representations and the transformations. It leads to the Generalized TERs (GTERs) that could equivary against transformations in a more general manner by enabling them to capture more complex patterns of transformed visual structures beyond the linear TERs of a transformation group. We will further show that the presented approach can be extended to (semi-)supervised models by jointly maximizing the mutual information in the learned representations about the input labels and transformations. Experiment results following the standard evaluation protocols demonstrate the superior performances of the proposed models to the existing state-of-the-art unsupervised and (semi-)supervised approaches in literature.

翻译:学习变异表示法( TERs) 试图通过应用变异的表达式来捕捉图像的内在视觉结构。 它假定变异应当从变异前后图像的表达式解码。 它大大扩大了确定性 AET 和 稳定性自动变异模型的范围。 前者通过直接重建应用变异,将变异表达法的变异表达法归为通用类别, 而后者则通过尽量扩大国家变异和变异之间的联合信息来培训。 它导致通用变异( GTERs) 遵循通用变异( GTERs) 的变异( AET) 模型,可以处理各种变异的变异的表达法。 确定性变异变和稳定性自动变异变模式都大大扩大范围。 我们通过更高级变异性变法的变异模式,可以进一步展示当前变异性变现的变异变现模式。 我们通过更高级化的变异性变异性变异性变异性变异的变异模式,可以进一步展示在常规变异性变异性变现模式中(GTER( GTER ) ) 的变变变变变现模式中,我们可以变变现的变异性变现的变现的变异性变异变现模式可以进一步变异性变现的变现模式,以更变异性变异性变现的变现的变现的变现,在常规变现的变现的变现的变现的变现的变现模式可以进一步变现,在的变现的变现的变现。