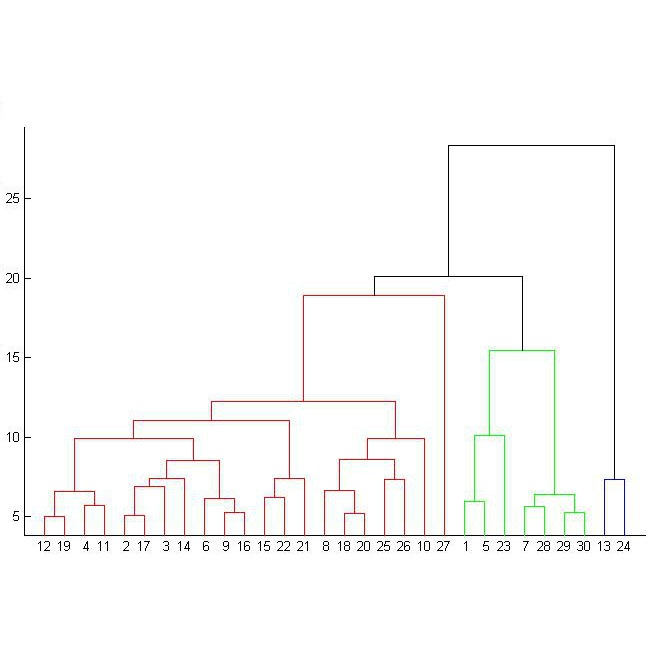

This paper describes the ByteDance speaker diarization system for the fourth track of the VoxCeleb Speaker Recognition Challenge 2021 (VoxSRC-21). The VoxSRC-21 provides both the dev set and test set of VoxConverse for use in validation and a standalone test set for evaluation. We first collect the duration and signal-to-noise ratio (SNR) of all audio and find that the distribution of the VoxConverse's test set and the VoxSRC-21's test set is more closer. Our system consists of voice active detection (VAD), speaker embedding extraction, spectral clustering followed by a re-clustering step based on agglomerative hierarchical clustering (AHC) and overlapped speech detection and handling. Finally, we integrate systems with different time scales using DOVER-Lap. Our best system achieves 5.15\% of the diarization error rate (DER) on evaluation set, ranking the second at the diarization track of the challenge.

翻译:本文描述VoxCeleb 发言人识别挑战 2021 (VoxSRC-21) 第四轨第四轨的位调喇叭扩音器分解系统。 VoxSRC-21 提供了用于验证和独立评价的VoxConvers 的代谢和测试套件。我们首先收集所有音频的长度和信号对音比,发现VoxConvers 测试集和VoxSRC-21 测试集的分布更加接近。我们的系统包括语音主动检测(VAD)、语音嵌入提取、光谱集集,然后是基于聚居式等级集群的再集群步骤以及重叠语音检测和处理。最后,我们利用DOVER-Lap将不同时间尺度的系统整合。我们的最佳系统在评价集上实现了5.15 ⁇ 分辨误差率(DER)的分布,在挑战的分解轨道上排第二位。