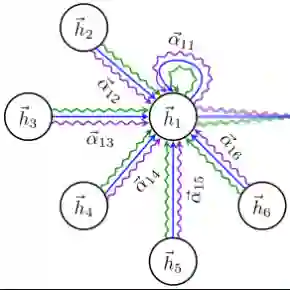

Fact Verification requires fine-grained natural language inference capability that finds subtle clues to identify the syntactical and semantically correct but not well-supported claims. This paper presents Kernel Graph Attention Network (KGAT), which conducts more fine-grained fact verification with kernel-based attentions. Given a claim and a set of potential evidence sentences that form an evidence graph, KGAT introduces node kernels, which better measure the importance of the evidence node, and edge kernels, which conduct fine-grained evidence propagation in the graph, into Graph Attention Networks for more accurate fact verification. KGAT achieves a 70.38% FEVER score and significantly outperforms existing fact verification models on FEVER, a large-scale benchmark for fact verification. Our analyses illustrate that, compared to dot-product attentions, the kernel-based attention concentrates more on relevant evidence sentences and meaningful clues in the evidence graph, which is the main source of KGAT's effectiveness.

翻译:事实核查需要细微的自然语言推断能力,以找到微妙的线索来辨别混凝土和精度正确但无确凿证据的索赔。本文展示了Kernel Graph Connect Network(KGAT),它以内核为主,对事实进行更精细的精确核实。考虑到一项主张和一系列形成证据图的潜在证据句子,KGAT引入了节点,更好地衡量证据节点和边缘内核的重要性,后者在图表中进行精度辨别的证据传播,进入图形注意网络,以进行更准确的事实核查。KGAT取得了70.38%的FEWE值,大大优于FEW上现有的事实核查模型,这是用于事实核实的大规模基准。我们的分析表明,与点关注相比,以内核为主的注意更多地集中于相关证据句子和证据图中有意义的线索,而证据图是KGAT有效性的主要来源。