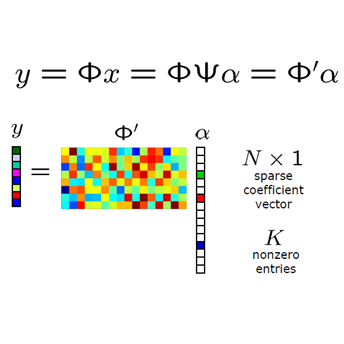

We consider the problem of recovering a structured signal $\mathbf{x} \in \mathbb{R}^{n}$ from noisy linear observations $\mathbf{y} =\mathbf{M} \mathbf{x}+\mathbf{w}$. The measurement matrix is modeled as $\mathbf{M} = \mathbf{B}\mathbf{A}$, where $\mathbf{B} \in \mathbb{R}^{l \times m}$ is arbitrary and $\mathbf{A} \in \mathbb{R}^{m \times n}$ has independent sub-gaussian rows. By varying $\mathbf{B}$, and the sub-gaussian distribution of $\mathbf{A}$, this gives a family of measurement matrices which may have heavy tails, dependent rows and columns, and singular values with a large dynamic range. When the structure is given as a possibly non-convex cone $T \subset \mathbb{R}^{n}$, an approximate empirical risk minimizer is proven to be a robust estimator if the effective number of measurements is sufficient, even in the presence of a model mismatch. In classical compressed sensing with independent (sub-)gaussian measurements, one asks how many measurements are needed to recover $\mathbf{x}$? In our setting, however, the effective number of measurements depends on the properties of $\mathbf{B}$. We show that the effective rank of $\mathbf{B}$ may be used as a surrogate for the number of measurements, and if this exceeds the squared Gaussian mean width of $(T-T) \cap \mathbb{S}^{n-1}$, then accurate recovery is guaranteed. Furthermore, we examine the special case of generative priors in detail, that is when $\mathbf{x}$ lies close to $T = \mathrm{ran}(G)$ and $G: \mathbb{R}^k \rightarrow \mathbb{R}^n$ is a Generative Neural Network (GNN) with ReLU activation functions. Our work relies on a recent result in random matrix theory by Jeong, Li, Plan, and Yilmaz arXiv:2001.10631. .

翻译:我们考虑恢复一个结构化的信号 $\ mathbf{x} 问题, 其中$\ mathb{ 直径{ {r} 直径{ mathb{ R}} 美元来自噪音线性观测 $\ mthbf{ m}\ m}\ mathbf{x\\ mathf{w} 美元。测量矩阵的模型是 $\ mathb{ b{ a} 美元, 其中 $\ mathb{ 直径{ b} 在 mathb{ R} 里, 美元是任意的, 美元=x的测量= 美元 美元 = 美元 = = mab} n} 美元。 测量矩阵以 $\ mathf{M} 美元为模型的模型 == 美元= a} 美元, 它的测量矩阵可能是重的尾巴、 直径和直径的 美元 值, 当之前的直径直径显示一个不具有风险的直径的直径直径。