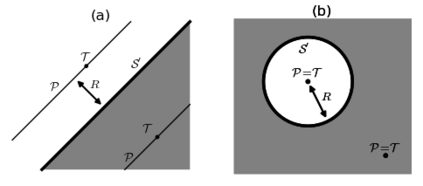

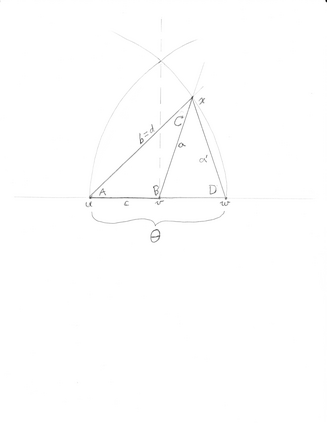

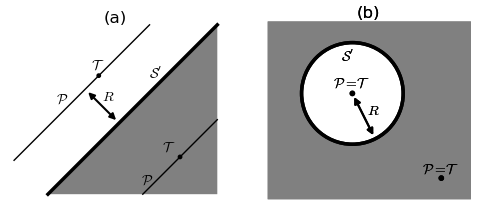

Statistical data by their very nature are indeterminate in the sense that if one repeated the process of collecting the data the new data set would be somewhat different from the original. Therefore, a statistical method, a map $\Phi$ taking a data set $x$ to a point in some space F, should be stable at $x$: Small perturbations in $x$ should result in a small change in $\Phi(x)$. Otherwise, $\Phi$ is useless at $x$ or -- and this is important -- near $x$. So one doesn't want $\Phi$ to have "singularities," data sets $x$ such that the the limit of $\Phi(y)$ as $y$ approaches $x$ doesn't exist. (Yes, the same issue arises elsewhere in applied math.) However, broad classes of statistical methods have topological obstructions of continuity: They must have singularities. We show why and give lower bounds on the Hausdorff dimension, even Hausdorff measure, of the set of singularities of such data maps. There seem to be numerous examples. We apply mainly topological methods to study the (topological) singularities of functions defined (on dense subsets of) "data spaces" and taking values in spaces with nontrivial homology. At least in this book, data spaces are usually compact manifolds. The purpose is to gain insight into the numerical conditioning of statistical description, data summarization, and inference and learning methods. We prove general results that can often be used to bound below the dimension of the singular set. We apply our topological results to develop lower bounds on Hausdorff measure of the singular set. We apply these methods to the study of plane fitting and measuring location of data on spheres. This is not a "final" version, merely another attempt.

翻译:以美元计的统计数据本身性质是不确定的, 也就是说, 如果重复收集数据的过程, 新的数据集就会与原始数据略有不同。 因此, 一种统计方法, 地图$\ Phi$, 将数据集x$x$( 美元) 提高到某些空间F 的点, 应该稳定在x$ 上: 美元的小扰动应该导致美元=Phi(x) 的轻微变化。 否则, $\ Phi$ (Phi$) 是没有用的, 这一点很重要 -- 接近x美元 。 所以, 所以, 人们不希望 $\ Phi$ 的描述与原始数据略有不同。 因此, 将美元= Phi$x$( y) 的上限值限制为$=Phix$( 美元) 在一个空间的顶端值值中, 通常会用一个固定的数位数 。 然而, 广泛的统计方法具有连续性的表层障碍 : 它们必须具有奇特性 。 我们在Hausdorf 维 维 上显示原因, 并给出更低的底处的底线, 度测量方法, 。 在这些数据的直径直观中, 我们的直径直观中, 通常会测量值中, 的直径值中, 的直径值中, 将数据值的直径值的直径值应用于此直径值中, 的直径值的直径值计算结果的直径值计算结果 。