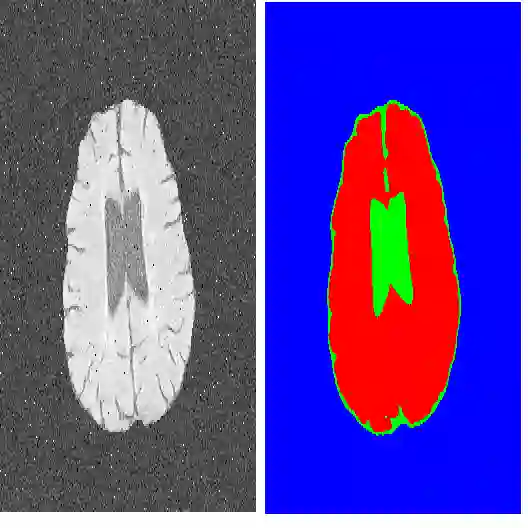

Efficiently utilizing discriminative features is crucial for convolutional neural networks to achieve remarkable performance in medical image segmentation and is also important for model generalization across multiple domains, where letting model recognize domain-specific and domain-invariant information among multi-site datasets is a reasonable strategy for domain generalization. Unfortunately, most of the recent disentangle networks are not directly adaptable to unseen-domain datasets because of the limitations of offered data distribution. To tackle this deficiency, we propose Contrastive Domain Disentangle (CDD) network for generalizable medical image segmentation. We first introduce a disentangle network to decompose medical images into an anatomical representation factor and a modality representation factor. Then, a style contrastive loss is proposed to encourage the modality representations from the same domain to distribute as close as possible while different domains are estranged from each other. Finally, we propose a domain augmentation strategy that can randomly generate new domains for model generalization training. Experimental results on multi-site fundus image datasets for optic cup and disc segmentation show that the CDD has good model generalization. Our proposed CDD outperforms several state-of-the-art methods in domain generalizable segmentation.

翻译:有效地利用歧视性特征对于进化神经网络在医学图像分割方面实现显著表现至关重要,对于在医学图像分割方面实现显著表现也非常重要,对于在多个领域进行典型的概括化也很重要,让模型识别多站数据集之间的特定域和域异性信息是一个合理的广化战略。不幸的是,由于提供的数据分布的局限性,最近大部分分解的网络无法直接适应无形的域数据集。为了解决这一缺陷,我们提议了可通用医学图像分割的相悖多域分解(CDD)网络。我们首先引入了将医学图像分解为解解解解解解成解剖成解剖代表系数和模式代表系数的分解网络。然后,提出了典型对比性损失,鼓励同一区域的模式代表尽可能接近分布,同时将不同的区域相互分隔开来。最后,我们建议了一种可随机生成模型一般化培训新域的域扩增战略。光学杯和盘片分解多功能基金图像集的实验结果显示,CDD具有良好的模型化通用分解法。我们提议的CD-D系统在域域内拟议的光学区划法超越了多个区块。