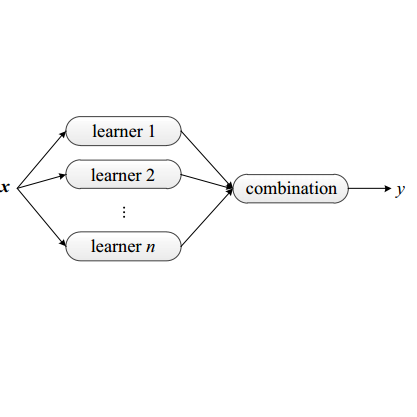

Due to the dominant position of deep learning (mostly deep neural networks) in various artificial intelligence applications, recently, ensemble learning based on deep neural networks (ensemble deep learning) has shown significant performances in improving the generalization of learning system. However, since modern deep neural networks usually have millions to billions of parameters, the time and space overheads for training multiple base deep learners and testing with the ensemble deep learner are far greater than that of traditional ensemble learning. Though several algorithms of fast ensemble deep learning have been proposed to promote the deployment of ensemble deep learning in some applications, further advances still need to be made for many applications in specific fields, where the developing time and computing resources are usually restricted or the data to be processed is of large dimensionality. An urgent problem needs to be solved is how to take the significant advantages of ensemble deep learning while reduce the required time and space overheads so that many more applications in specific fields can benefit from it. For the alleviation of this problem, it is essential to know about how ensemble learning has developed under the era of deep learning. Thus, in this article, we present discussion focusing on data analyses of published works, the methodology, recent works and unattainability of traditional ensemble learning, and recent developments of ensemble deep learning. We hope this article will be helpful to realize the technical challenges faced by future developments of ensemble learning under the era of deep learning.

翻译:由于在各种人工智能应用中的深层次学习(主要是深层神经网络)的主导地位,最近,基于深层神经网络的混合学习(整体深层学习)显示出在改进学习系统一般化方面的显著表现,然而,由于现代深层神经网络通常有数百万至数十亿参数,培训多基深层学习者和与共同深层学习者进行测试的时间和空间间接费用远远大于传统共同学习的优势。虽然已提出一些快速混合深层学习的算法,以促进在一些应用中部署共同深层学习,但在特定领域的许多应用中,仍然需要取得进一步进展,因为在那里,开发的时间和计算资源通常受到限制,或处理的数据具有很大的多维度。一个紧迫的问题需要解决的是,如何利用堆积深学习的巨大优势,同时减少所需的时间和空间管理费用,从而在具体领域的更多应用将从中受益。为了缓解这一问题,我们必须了解在深刻的深度应用中如何丰富地学习,我们在深层次的学习过程中如何发展,在最新的可理解的时代中,我们必须了解当前深层次的学习的学习,在当前的可实现的学习方法中,因此,在当前的学习的学习过程中,必须了解最近的可实现的学习工作。