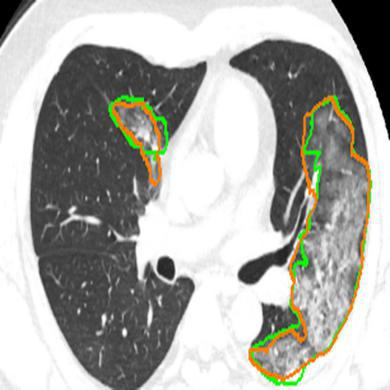

The novel coronavirus disease 2019 (COVID-19) characterized by atypical pneumonia has caused millions of deaths worldwide. Automatically segmenting lesions from chest Computed Tomography (CT) is a promising way to assist doctors in COVID-19 screening, treatment planning, and follow-up monitoring. However, voxel-wise annotations are extremely expert-demanding and scarce, especially when it comes to novel diseases, while an abundance of unlabeled data could be available. To tackle the challenge of limited annotations, in this paper, we propose an uncertainty-guided dual-consistency learning network (UDC-Net) for semi-supervised COVID-19 lesion segmentation from CT images. Specifically, we present a dual-consistency learning scheme that simultaneously imposes image transformation equivalence and feature perturbation invariance to effectively harness the knowledge from unlabeled data. We then quantify the segmentation uncertainty in two forms and employ them together to guide the consistency regularization for more reliable unsupervised learning. Extensive experiments showed that our proposed UDC-Net improves the fully supervised method by 6.3% in Dice and outperforms other competitive semi-supervised approaches by significant margins, demonstrating high potential in real-world clinical practice.

翻译:以非典型肺炎为特征的2019年新科洛纳病毒疾病(COVID-19)(COVID-19)(COVID-19)为特征的新型冠状病毒病(COVID-19-19(COVID-19))在全世界造成了数百万人死亡,自动分割胸部成形的胸腔成形成形(CT)是协助医生进行COVID-19筛查、治疗规划和后续监测的一个很有希望的方法,然而,从毒理学角度作出的说明非常需要专家,而且非常稀少,特别是在新出现疾病的情况下,而大量未贴标签的数据可以提供。为了应对有限说明的挑战,我们在本文件中提议为半受监督的COVID-19损伤成形(CT)自动分割成形(UDC-Net)的半受监督的COVID-19分离(CT)研究网络(UDC-Net)是一个双一致的学习计划,它既要求图像转换等同,又具有易变异性特征,以便有效地利用未贴标签数据的知识。我们然后用两种形式量化分解的不确定性,并使用它们一起指导一致性的规范,以便更可靠地进行不超超的学习。广泛的实验表明我们拟议的UDC-Net-Net-Net-res演示6.63%中的重要方法。