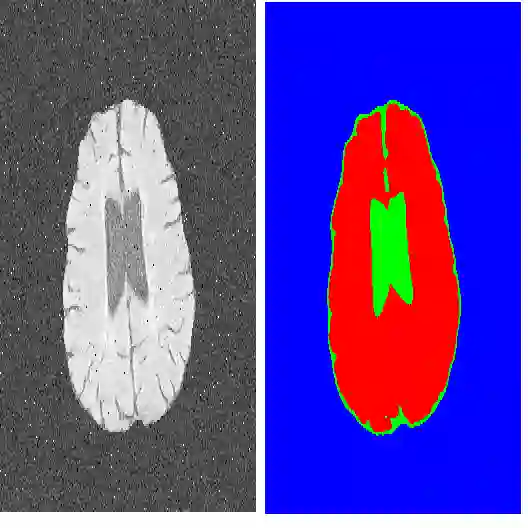

It is common in anthropology and paleontology to address questions about extant and extinct species through the quantification of osteological features observable in micro-computed tomographic (micro-CT) scans. In cases where remains were buried, the grey values present in these scans may be classified as belonging to air, dirt, or bone. While various intensity-based methods have been proposed to segment scans into these classes, it is often the case that intensity values for dirt and bone are nearly indistinguishable. In these instances, scientists resort to laborious manual segmentation, which does not scale well in practice when a large number of scans are to be analyzed. Here we present a new domain-enriched network for three-class image segmentation, which utilizes the domain knowledge of experts familiar with manually segmenting bone and dirt structures. More precisely, our novel structure consists of two components: 1) a representation network trained on special samples based on newly designed custom loss terms, which extracts discriminative bone and dirt features, 2) and a segmentation network that leverages these extracted discriminative features. These two parts are jointly trained in order to optimize the segmentation performance. A comparison of our network to that of the current state-of-the-art U-NETs demonstrates the benefits of our proposal, particularly when the number of labeled training images are limited, which is invariably the case for micro-CT segmentation.

翻译:在人类学和古生物学中,常见的做法是通过对微雕刻成像仪(Mic-CT)扫描中观察到的地质特征进行量化,解决关于现存物种和灭绝物种的问题。在遗骸被埋葬的情况下,这些扫描中的灰色值可能归类为属于空气、泥土或骨头。虽然提出了将扫描分为这些类别的各种基于强度的方法,但经常出现的情况是,土和骨头的强度值几乎无法区分。在这些情况下,科学家们诉诸于劳动性的人工分割,而当大量扫描需要分析时,这种分割在实际中并不十分广泛。在这里,我们为三层图像分割提出了一个新的领域丰富网络,利用熟悉手动分解骨和土结构的专家的域知识。更确切地说,我们的新结构包括两个组成部分:(1) 一种根据新设计的习惯损失条件对特殊样本进行训练的展示网络,其中提取有歧视性的骨头和泥土特征,(2) 以及一种利用这些提取出的歧视特征的分解网络。这里的这两个部分是经过共同培训的域浓缩的网络,目的是将我们目前的分解图案的优点与最佳化。