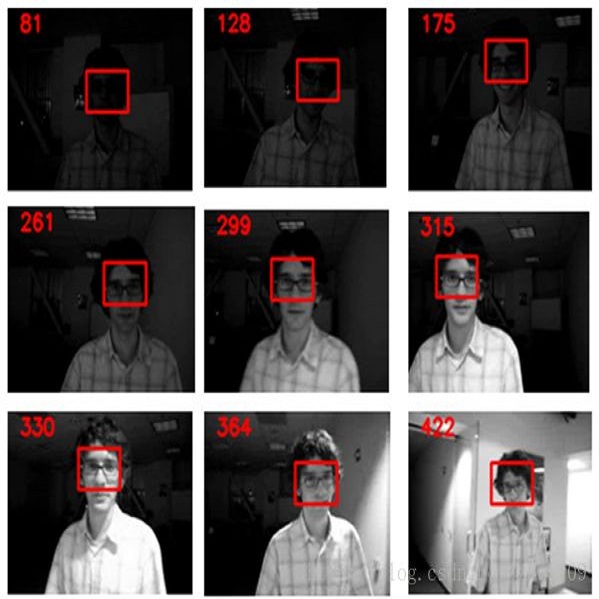

Motion blur caused by the moving of the object or camera during the exposure can be a key challenge for visual object tracking, affecting tracking accuracy significantly. In this work, we explore the robustness of visual object trackers against motion blur from a new angle, i.e., adversarial blur attack (ABA). Our main objective is to online transfer input frames to their natural motion-blurred counterparts while misleading the state-of-the-art trackers during the tracking process. To this end, we first design the motion blur synthesizing method for visual tracking based on the generation principle of motion blur, considering the motion information and the light accumulation process. With this synthetic method, we propose optimization-based ABA (OP-ABA) by iteratively optimizing an adversarial objective function against the tracking w.r.t. the motion and light accumulation parameters. The OP-ABA is able to produce natural adversarial examples but the iteration can cause heavy time cost, making it unsuitable for attacking real-time trackers. To alleviate this issue, we further propose one-step ABA (OS-ABA) where we design and train a joint adversarial motion and accumulation predictive network (JAMANet) with the guidance of OP-ABA, which is able to efficiently estimate the adversarial motion and accumulation parameters in a one-step way. The experiments on four popular datasets (e.g., OTB100, VOT2018, UAV123, and LaSOT) demonstrate that our methods are able to cause significant accuracy drops on four state-of-the-art trackers with high transferability. Please find the source code at \href{https://github.com/tsingqguo/ABA}{https://github.com/tsingqguo/ABA}

翻译:在这项工作中,我们探索视觉物体跟踪器的稳健性,防止从一个新角度(即对抗性模糊攻击(ABA))运动模糊。我们的主要目标是在跟踪过程中将输入框在线传输到自然运动勃发的对等方,同时误导最先进的对等方。为此,我们首先根据运动的生成原则,考虑到运动的准确性和光累积过程,设计运动的模糊合成视觉跟踪方法,从而对视觉物体进行跟踪跟踪。在这项工作中,我们探索视觉物体跟踪器跟踪器跟踪器的稳健性。我们利用这一合成方法,提出以优化为基础的ABA(OP-ABA)(OP-ABA)(OP-ABA)(O-ABA)(O-AB)(O-AB) (O) (OBA(O) (OS-AB) (O) (OBA(O) (O-BA(O) (OBA) (O) (ODA(O) (ODA) (ODA-OD) (ODA(OD) (OL) (OL) (ODA(OD) (OD) (ODA) (OD) (OD) (OD) (OLI) (OD) (OD) (OL) (OL) (O) (OD) (OD) (OD) (OD) (OD) (OD) (OD) (OD) (O) (O) (O) (O) (O) (OD) (OD) (OD) (OD(O) (O) (O) (O) (O) (O) (O) (O) (O) (O) (O) (O) (O) (O) (O(O) (O) (O) (O) (O) (O) (O) (O) (O) (O) (OD) (O) (OD) (O) (O) (O) (O) (O) (O) (O) (O) (OD) (O) (O) (O) (O) (O) (O) (OD) (O) (O) (O) (O) (OD) (OD) (