题目: Quantum Adversarial Machine Learning

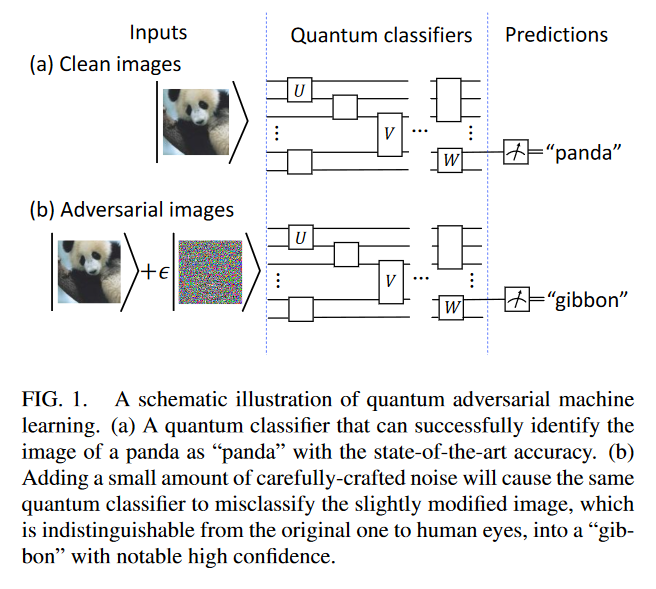

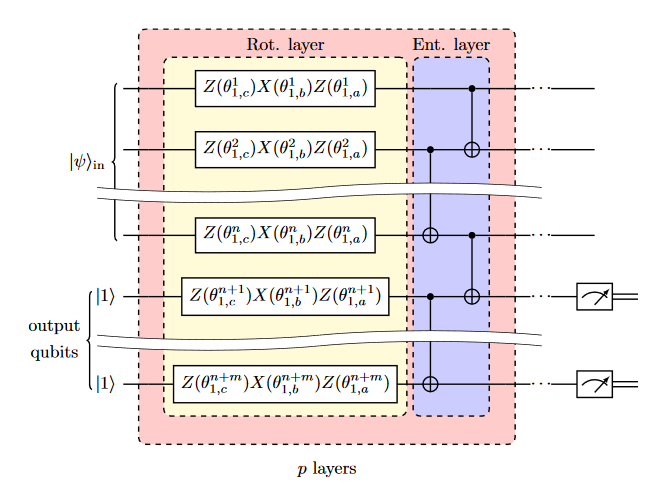

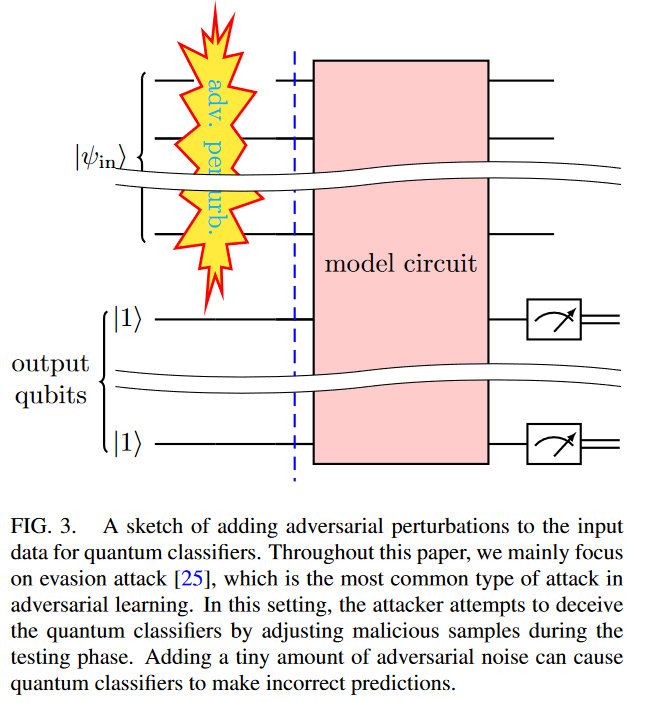

摘要: 对抗性机器学习是一个新兴的研究领域,主要研究机器学习方法在对抗性环境中的脆弱性,并开发相应的技术,使学习对对抗性操作具有鲁棒性。它在各种机器学习应用中起着至关重要的作用,近年来引起了不同社区的极大关注。本文探讨了量子机器学习中不同的对抗情境。我们发现,与基于经典神经网络的传统分类器类似,量子学习系统同样容易受到精心设计的对抗性示例的攻击,而与输入数据是经典的还是量子的无关。特别是,我们发现,通过对原始合法样本添加不可察觉的扰动而获得的对抗性示例,可以最终欺骗达到接近最新精度的量子分类器。这在不同场景下的量子对抗学习中得到了明确的证明,包括对现实生活中的图像(如数据集MNIST中的手写数字图像)进行分类,对物质的学习阶段(如铁磁/顺磁有序和对称保护拓扑相)进行分类,以及对量子数据进行分类。此外,我们还指出,根据手头的对抗性例子的信息,可以设计出实用的防御策略来对抗多种不同的攻击。我们的研究结果揭示了量子机器学习系统对各种扰动的显著脆弱性,这不仅从理论上揭示了机器学习与量子物理学之间的联系,而且为基于近期和未来量子技术的量子分类器的实际应用提供了有价值的指导。

成为VIP会员查看完整内容

相关内容

专知会员服务

51+阅读 · 2020年3月31日

专知会员服务

36+阅读 · 2020年3月12日

专知会员服务

46+阅读 · 2020年1月25日

专知会员服务

29+阅读 · 2019年11月18日

专知会员服务

25+阅读 · 2019年8月12日

Arxiv

14+阅读 · 2019年1月17日