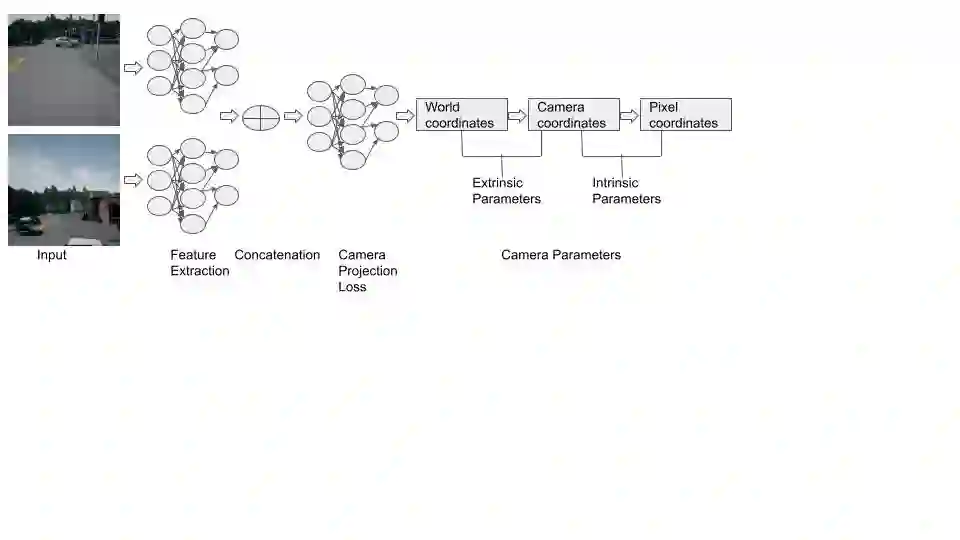

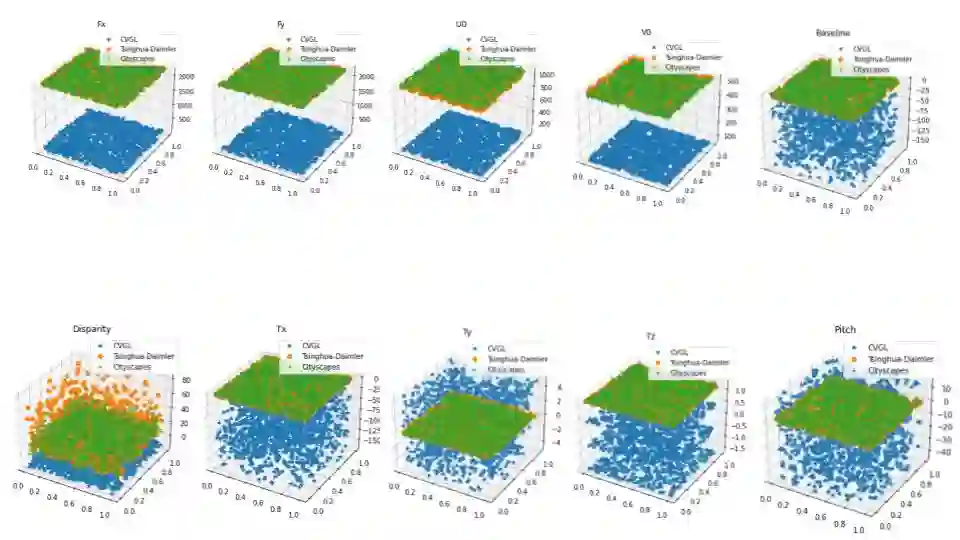

For a number of tasks, such as 3D reconstruction, robotic interface, autonomous driving, etc., camera calibration is essential. In this study, we present a unique method for predicting intrinsic (principal point offset and focal length) and extrinsic (baseline, pitch, and translation) properties from a pair of images. We suggested a novel method where camera model equations are represented as a neural network in a multi-task learning framework, in contrast to existing methods, which build a comprehensive solution. By reconstructing the 3D points using a camera model neural network and then using the loss in reconstruction to obtain the camera specifications, this innovative camera projection loss (CPL) method allows us that the desired parameters should be estimated. As far as we are aware, our approach is the first one that uses an approach to multi-task learning that includes mathematical formulas in a framework for learning to estimate camera parameters to predict both the extrinsic and intrinsic parameters jointly. Additionally, we provided a new dataset named as CVGL Camera Calibration Dataset [1] which has been collected using the CARLA Simulator [2]. Actually, we show that our suggested strategy out performs both conventional methods and methods based on deep learning on 6 out of 10 parameters that were assessed using both real and synthetic data. Our code and generated dataset are available at https://github.com/thanif/Camera-Calibration-through-Camera-Projection-Loss.

翻译:对于一系列任务,例如 3D 重建、 机器人界面、 自动驾驶等, 相机校准等, 至关重要。 在此研究中, 我们提出了一个独特的方法, 用于从一对图像中预测内在属性( 主要点抵消和焦距) 和外部属性( 基线、 音道和翻译) 。 我们建议了一种新颖的方法, 将相机模型方程式作为神经网络在多任务学习框架中作为神经网络, 与现有的方法形成全面解决方案。 通过使用相机模型神经网络重建 3D 点, 然后在重建中利用损失来获取相机规格, 这种创新的相机预测损失( CPL) 方法使我们得以估算所需的参数。 就我们所知, 我们的方法是使用多任务学习方法, 包括数学公式, 以估算相机参数, 以共同预测外部和内在参数。 此外, 我们提供了一套新的数据集, 名为CVGL C C C 校校校校校校校校校 数据[ 2], 我们用 CAR 模拟 C 模拟 C 模拟 C 模拟/ 模拟 和 模拟数据生成的常规方法, 显示我们 的常规方法, 和 模拟 模拟 模拟 模拟 模拟 模拟 模拟 的系统 的系统, 和模拟 的系统, 我们用 和模拟数据 模拟 模拟 模拟 的 模拟 的 校验算 以 10- 校对的校对的校对的校对的校对 的校对的校对的校对的校对的校对 的校对 的校对, 的校对,, 我们的校对 的校对的校对的校对的校对的校对的校对的校对的校对的校对 。