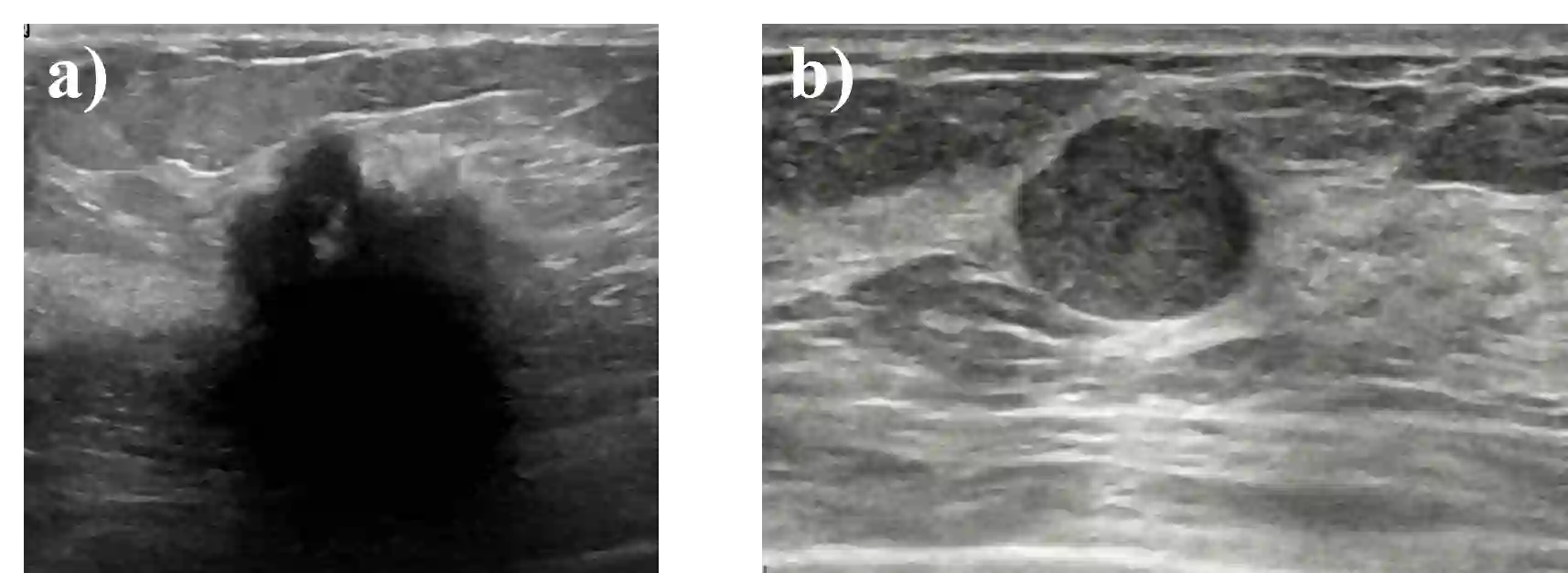

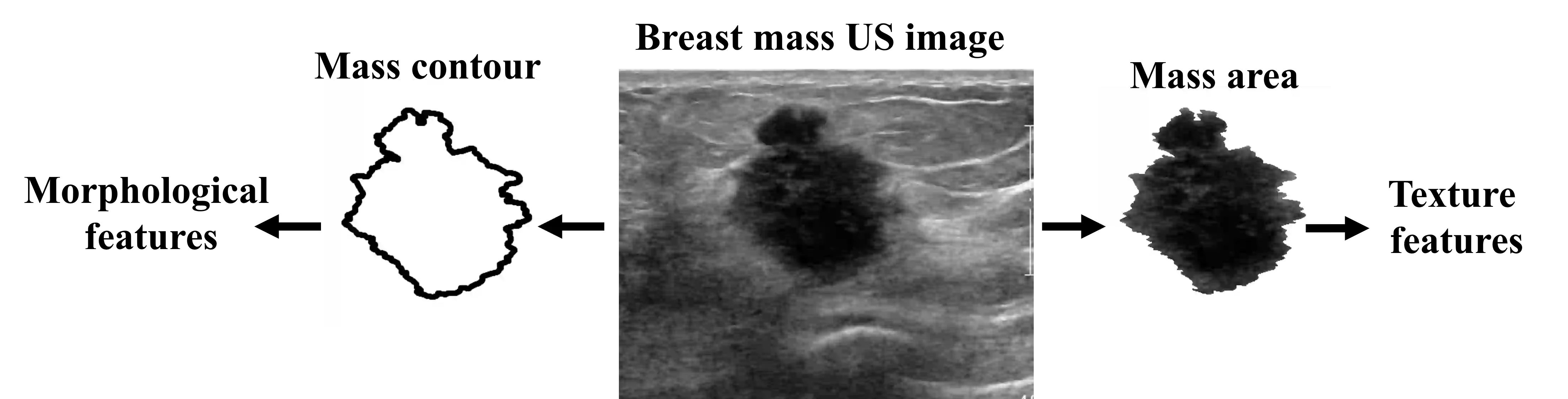

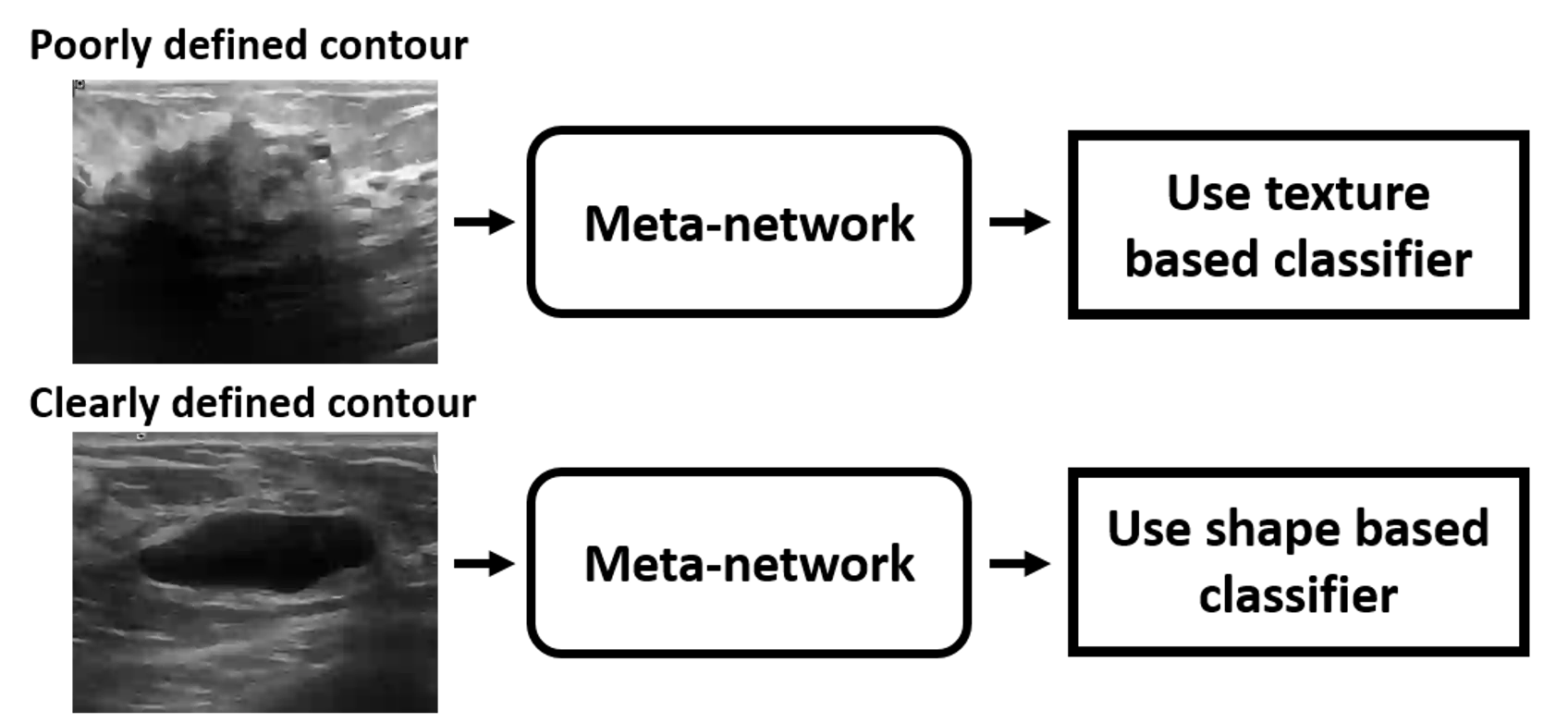

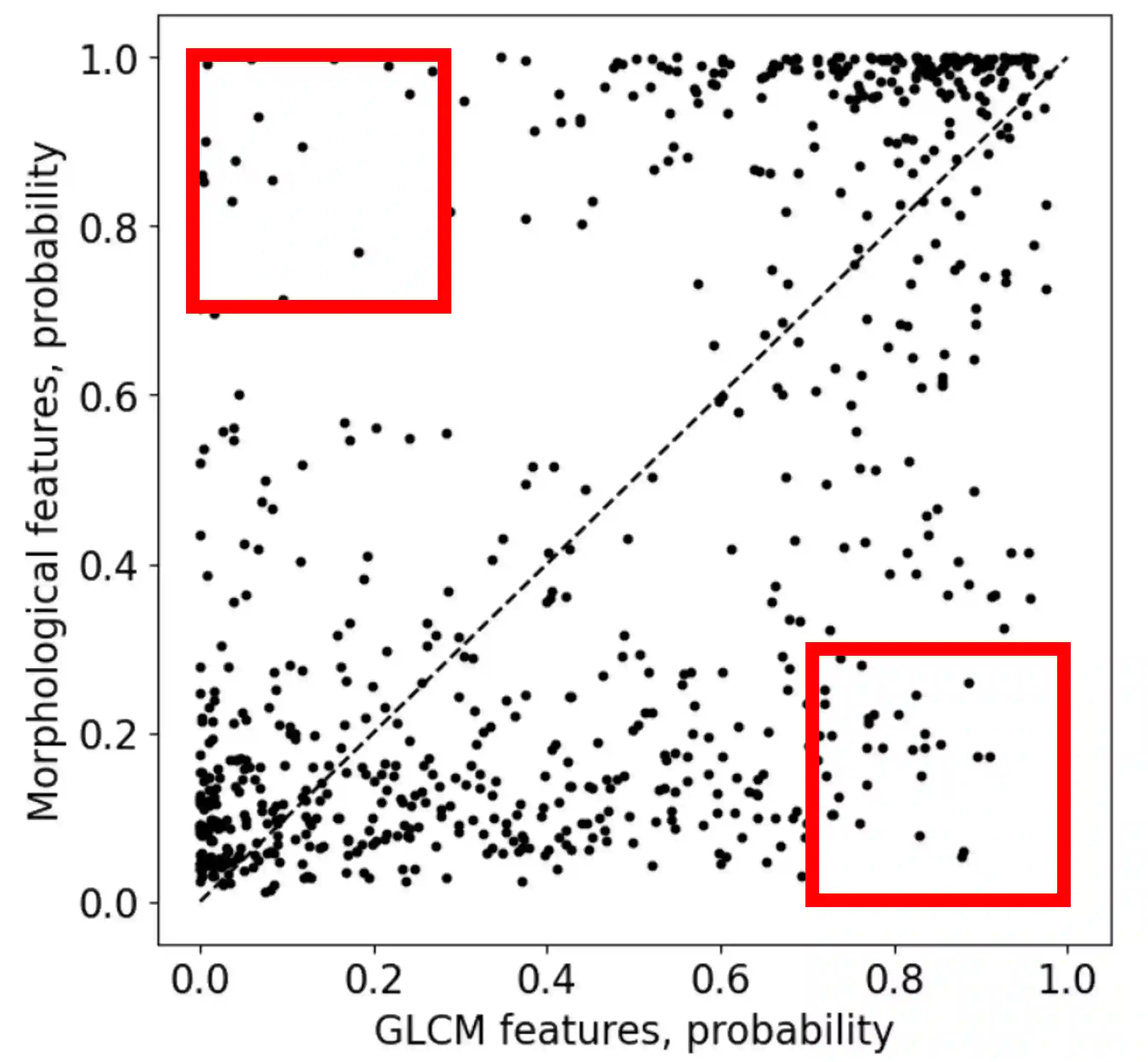

Standard classification methods based on handcrafted morphological and texture features have achieved good performance in breast mass differentiation in ultrasound (US). In comparison to deep neural networks, commonly perceived as "black-box" models, classical techniques are based on features that have well-understood medical and physical interpretation. However, classifiers based on morphological features commonly underperform in the presence of the shadowing artifact and ill-defined mass borders, while texture based classifiers may fail when the US image is too noisy. Therefore, in practice it would be beneficial to select the classification method based on the appearance of the particular US image. In this work, we develop a deep meta-network that can automatically process input breast mass US images and recommend whether to apply the shape or texture based classifier for the breast mass differentiation. Our preliminary results demonstrate that meta-learning techniques can be used to improve the performance of the standard classifiers based on handcrafted features. With the proposed meta-learning based approach, we achieved the area under the receiver operating characteristic curve of 0.95 and accuracy of 0.91.

翻译:在超声波(美国)中,基于手工制作形态和纹理特征的标准分类方法在乳房质量差异方面表现良好。 与深层神经网络(通常被视为“黑盒”模型)相比,古典技术基于有很好理解的医学和物理解释的特征。然而,基于在影子文物和定义不清质量边界存在时通常表现不佳的形态特征的分类方法,而基于纹理的分类方法在美国图像过于吵闹时可能失败。因此,在实践中,根据特定美国图像的外观选择分类方法将是有益的。在这项工作中,我们开发了一个能够自动输入乳房质量美国图像的深层元网络,并建议是否应用基于乳房质量差异的形状或纹理分类方法。我们的初步结果显示,可以利用元学习技术来改进基于手工艺的标准分类方法的性能。通过拟议的以元学习为基础的方法,我们在接收器运行0.95的特征曲线和0.91的准确度下实现了区域。