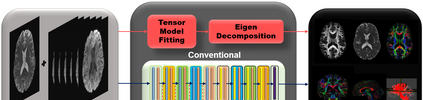

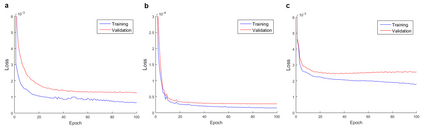

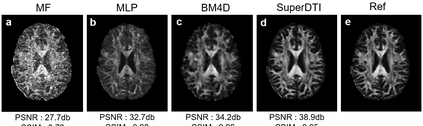

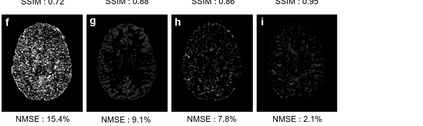

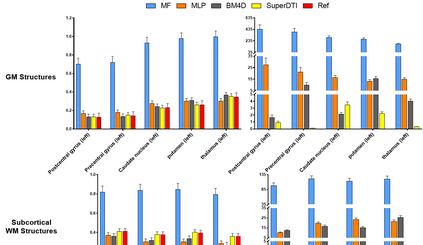

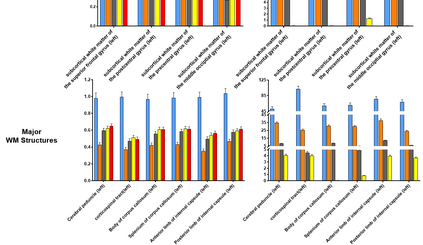

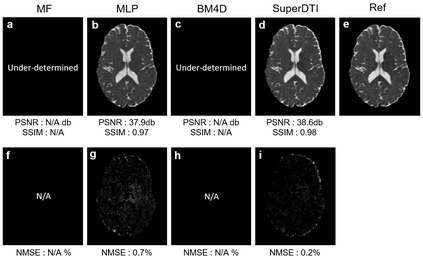

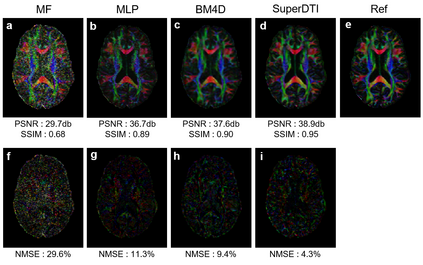

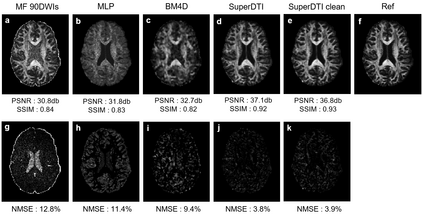

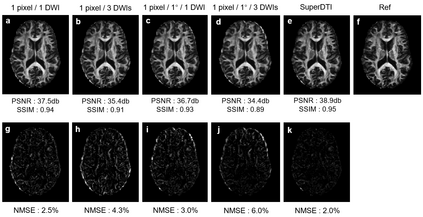

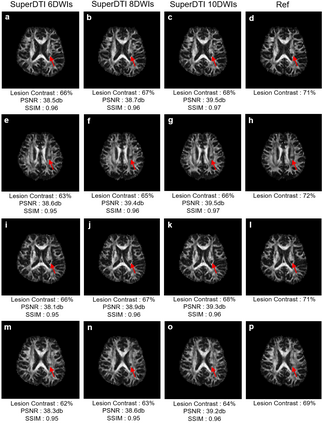

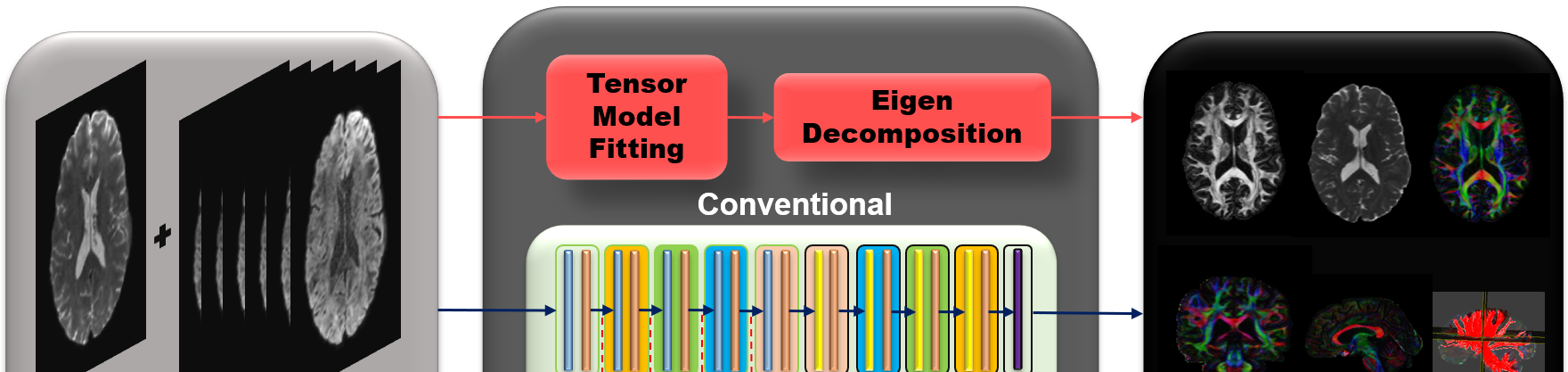

Purpose: To propose a deep learning-based reconstruction framework for ultrafast and robust diffusion tensor imaging and fiber tractography. Methods: We propose SuperDTI to learn the nonlinear relationship between diffusion-weighted images (DWIs) and the corresponding tensor-derived quantitative maps as well as the fiber tractography. Super DTI bypasses the tensor fitting procedure, which is well known to be highly susceptible to noise and motion in DWIs. The network is trained and tested using datasets from Human Connectome Project and patients with ischemic stroke. SuperDTI is compared against the state-of-the-art methods for diffusion map reconstruction and fiber tracking. Results: Using training and testing data both from the same protocol and scanner, SuperDTI is shown to generate fractional anisotropy and mean diffusivity maps, as well as fiber tractography, from as few as six raw DWIs. The method achieves a quantification error of less than 5% in all regions of interest in white matter and gray matter structures. We also demonstrate that the trained neural network is robust to noise and motion in the testing data, and the network trained using healthy volunteer data can be directly applied to stroke patient data without compromising the lesion detectability. Conclusion: This paper demonstrates the feasibility of superfast diffusion tensor imaging and fiber tractography using deep learning with as few as six DWIs directly, bypassing tensor fitting. Such a significant reduction in scan time may allow the inclusion of DTI into the clinical routine for many potential applications.

翻译:方法:我们建议超级DTI 学习扩散加权图像(DWIs)和相应的高压定量地图以及纤维地形学之间的非线性关系。超级DTI 绕过高压安装程序,众所周知该程序极易在DWIS中受到噪音和运动的影响。该方法在人类连接项目和无化学中风病人的数据集下接受培训和测试。超DTI 与最先进的传播地图重建和纤维跟踪应用方法相比较。结果:利用来自同一协议和扫描仪的培训和测试数据,超DTI 显示生成分偏偏偏偏偏偏偏偏偏偏偏偏偏偏偏差和平均偏差图,以及光直径偏移的光谱扫描程序。该方法在对白物质和灰质结构感兴趣的所有地区都实现不到5%的量化错误。我们还表明,经过培训的神经网络在测试数据、平移和纤维追踪应用中,在测试数据的测试中可以稳固的周期中,并且通过对网络进行直接培训,利用健康的直径直流数据,从而将快速的分辨率学习。