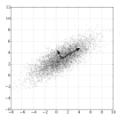

Neural networks-based learning of the distribution of non-dispatchable renewable electricity generation from sources such as photovoltaics (PV) and wind as well as load demands has recently gained attention. Normalizing flow density models are particularly well suited for this task due to the training through direct log-likelihood maximization. However, research from the field of image generation has shown that standard normalizing flows can only learn smeared-out versions of manifold distributions. Previous works on normalizing flow-based scenario generation do not address this issue, and the smeared-out distributions result in the sampling of noisy time series. In this paper, we propose reducing the dimensionality through principal component analysis (PCA), which sets up the normalizing flow in a lower-dimensional space while maintaining the direct and computationally efficient likelihood maximization. We train the resulting principal component flow (PCF) on data of PV and wind power generation as well as load demand in Germany in the years 2013 to 2015. The results of this investigation show that the PCF preserves critical features of the original distributions, such as the probability density and frequency behavior of the time series. The application of the PCF is, however, not limited to renewable power generation but rather extends to any data set, time series, or otherwise, which can be efficiently reduced using PCA.

翻译:以神经网络为基础,从光伏和风以及负荷需求等来源对不可分配可再生发电的分布进行神经网络学习,最近引起了人们的注意。由于直接对日志进行最大化培训,正常流密度模型对于这项任务特别适合。然而,图像生成领域的研究表明,标准化流流的正常化只能从多种分布中学习被抹掉的版本。以往关于正常流基情景生成的工作没有解决这个问题,被抹掉的分布导致对噪音时间序列的抽样。在本文件中,我们提议通过主要组成部分分析(PCA)减少维度,该分析在保持直接和计算效率的概率最大化的同时,在较低空间建立正常流,从而在较低空间建立正常流。我们在图像生成领域进行的研究表明,标准化流流只能从光电和风能生成数据以及德国在2013-2015年的负载需求中学习。这次调查的结果显示,PCFF维护原始分布的关键特征,如时间序列的概率密度和频率行为。我们提议通过主要组成部分分析(PCA)减少其维度,否则,使用可再生能源的生成时间序列不会扩大。