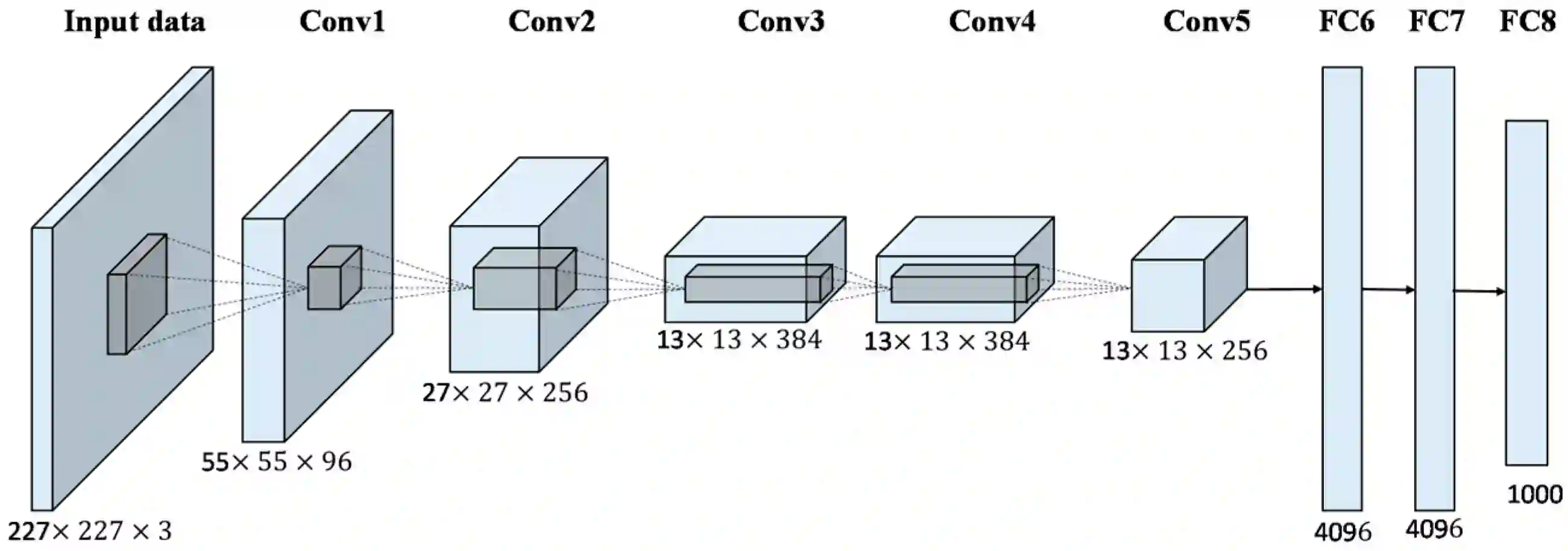

Various methods of measuring unit selectivity have been developed with the aim of better understanding how neural networks work. But the different measures provide divergent estimates of selectivity, and this has led to different conclusions regarding the conditions in which selective object representations are learned and the functional relevance of these representations. In an attempt to better characterize object selectivity, we undertake a comparison of various selectivity measures on a large set of units in AlexNet, including localist selectivity, precision, class-conditional mean activity selectivity (CCMAS), network dissection,the human interpretation of activation maximization (AM) images, and standard signal-detection measures. We find that the different measures provide different estimates of object selectivity, with precision and CCMAS measures providing misleadingly high estimates. Indeed, the most selective units had a poor hit-rate or a high false-alarm rate (or both) in object classification, making them poor object detectors. We fail to find any units that are even remotely as selective as the 'grandmother cell' units reported in recurrent neural networks. In order to generalize these results, we compared selectivity measures on units in VGG-16 and GoogLeNet trained on the ImageNet or Places-365 datasets that have been described as 'object detectors'. Again, we find poor hit-rates and high false-alarm rates for object classification. We conclude that signal-detection measures provide a better assessment of single-unit selectivity compared to common alternative approaches, and that deep convolutional networks of image classification do not learn object detectors in their hidden layers.

翻译:为了更好地了解神经网络如何运作,制定了各种单位选择性衡量方法。但不同的措施提供了不同的选择性估计,从而得出了不同的结论,对选择性物体表示方式的学习条件和这些表示方式的功能相关性提出了不同的结论。为了更好地定性目标选择性,我们比较了亚历克斯网一大批单位的各种选择性措施,包括地方主义选择性、精确度、等级条件平均活动选择性(CCMAS)、网络解剖、对激活最大化图像(AM)的人类解释以及标准的信号检测措施。我们发现,不同的措施提供了不同的对象选择性估计,精确度和CCMAS措施提供了误导性高的估计。事实上,最有选择性的单位在目标分类中,打击率低或高的虚假武器率(或两者),使它们的物体探测器差。我们没有发现任何单位甚至像经常的神经网络中报告的“表层细胞”单位那样具有远程选择性。为了概括这些结果,我们比较了VGG-16和GoogLeNet各单元的选择性措施,而没有精确度和CCMAS措施提供了误导性高的估计。事实上,在图像网络或3-365号的精确度标准中,我们得出了一种更精确的精确的精确的精确度数据等级评估。