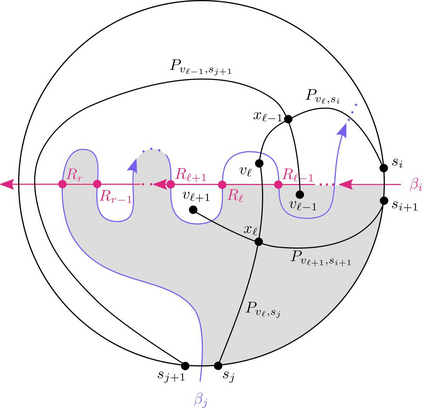

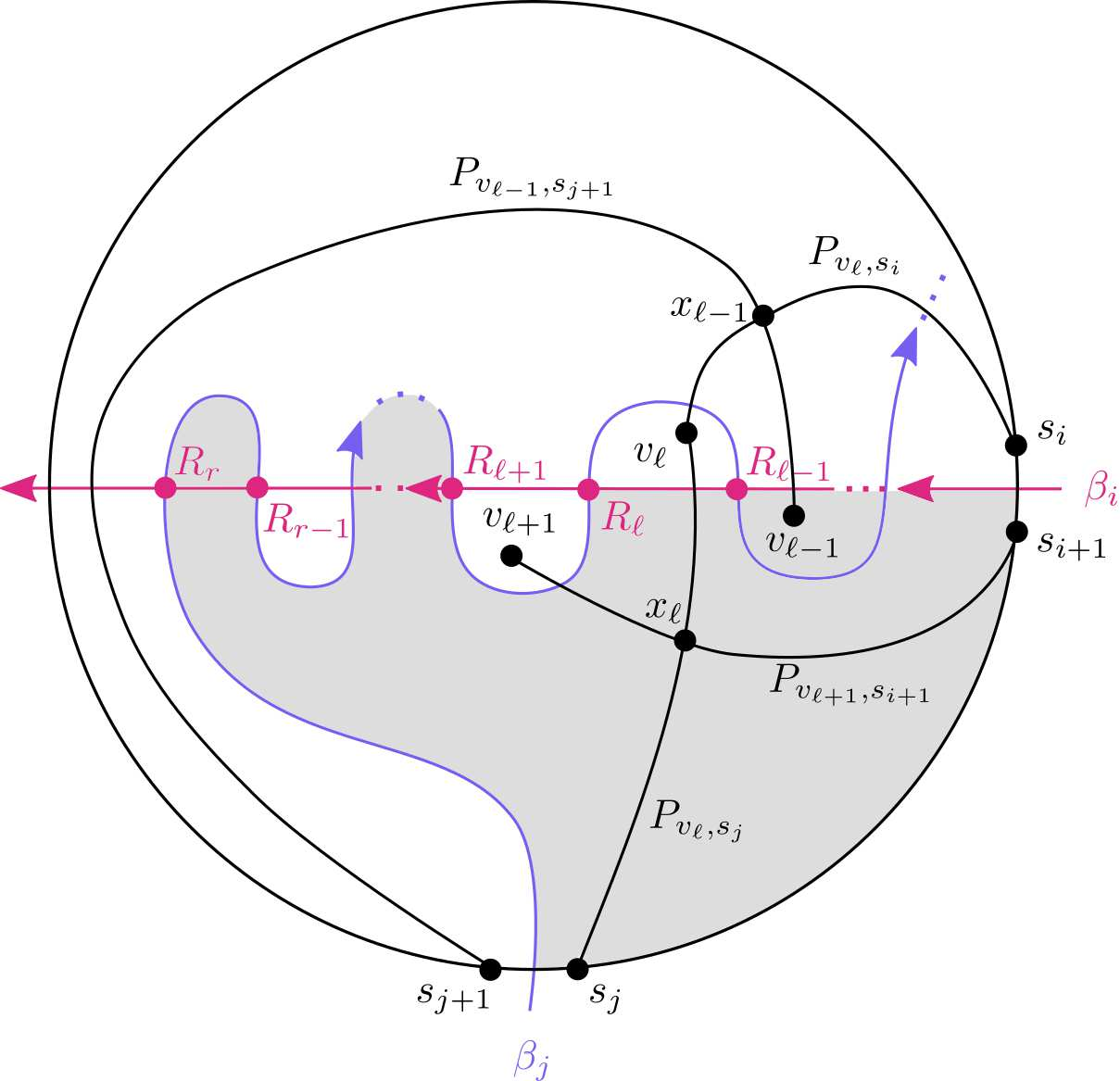

Let $G=(V,E)$ be an undirected unweighted planar graph. Consider a vector storing the distances from an arbitrary vertex $v$ to all vertices $S = \{ s_1 , s_2 , \ldots , s_k \}$ of a single face in their cyclic order. The pattern of $v$ is obtained by taking the difference between every pair of consecutive values of this vector. In STOC'19, Li and Parter used a VC-dimension argument to show that in planar graphs, the number of distinct patterns, denoted $x$, is only $O(k^3)$. This resulted in a simple compression scheme requiring $\tilde O(\min \{ k^4+|T|, k\cdot |T|\})$ space to encode the distances between $S$ and a subset of terminal vertices $T \subseteq V$. This is known as the Okamura-Seymour metric compression problem. We give an alternative proof of the $x=O(k^3)$ bound that exploits planarity beyond the VC-dimension argument. Namely, our proof relies on cut-cycle duality, as well as on the fact that distances among vertices of $S$ are bounded by $k$. Our method implies the following: (1) An $\tilde{O}(x+k+|T|)$ space compression of the Okamura-Seymour metric, thus improving the compression of Li and Parter to $\tilde O(\min \{k^3+|T|,k \cdot |T| \})$. (2) An optimal $\tilde{O}(k+|T|)$ space compression of the Okamura-Seymour metric, in the case where the vertices of $T$ induce a connected component in $G$. (3) A tight bound of $x = \Theta(k^2)$ for the family of Halin graphs, whereas the VC-dimension argument is limited to showing $x=O(k^3)$.

翻译:Lets G= (V, E) $ 是一个未调整的平面图。 在 STOC' 19, Li 和 Parter 使用 VC dimenion 参数来显示在平面图中, 不同模式的数量, 表示的美元, 仅是 $S = _ 1, s_ 2, rdots, s_k = 美元, 单面的 美元在其周期顺序中。 $V的模式是通过将美元和端端端值之间的距离进行编码而得到的。 在 STOC' 19, Li 和 Parter 使用 VC dimental 参数来显示, 在平面图中, 不同的模式的数量, 表示的美元 美元 美元 美元 。 在平面图中, 我们用另一种方法 = Ox 的平面图解 。