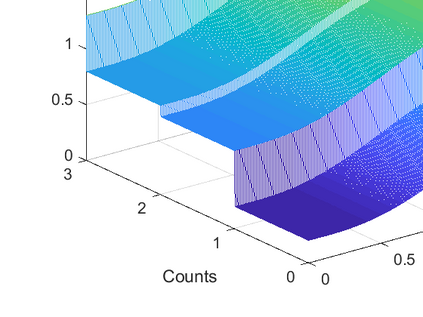

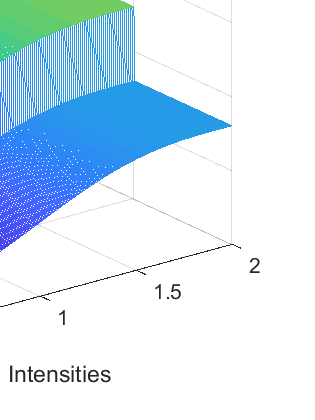

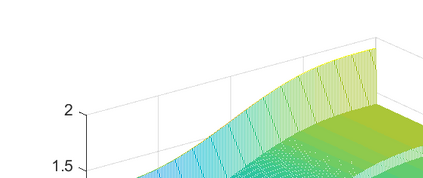

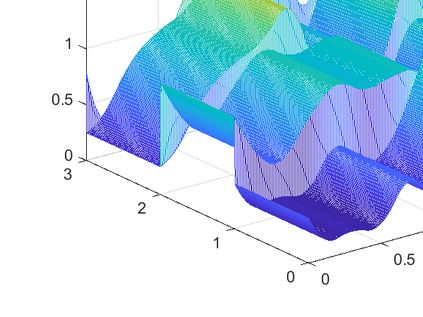

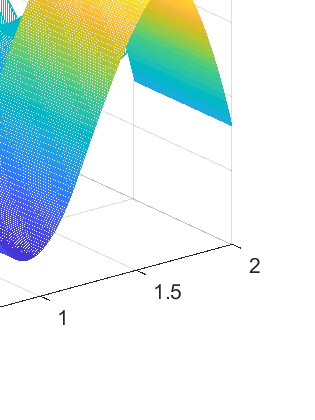

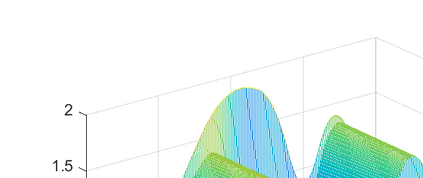

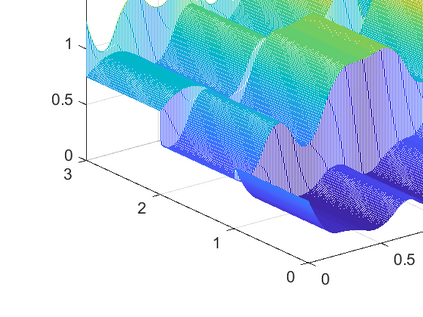

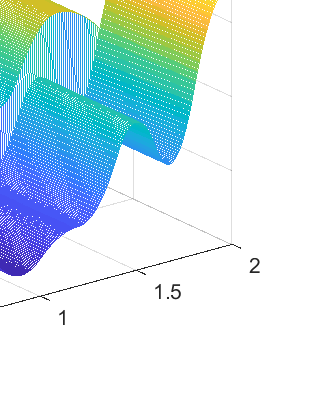

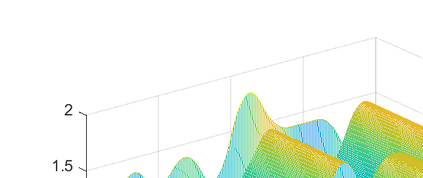

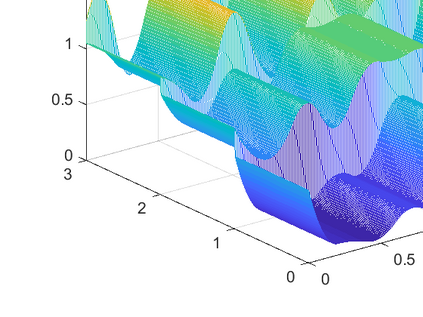

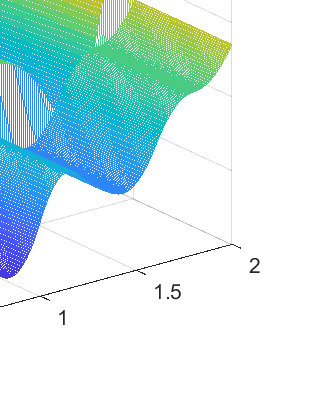

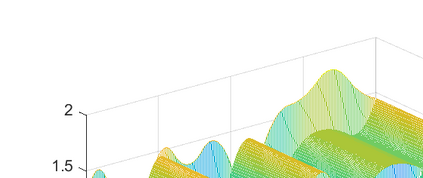

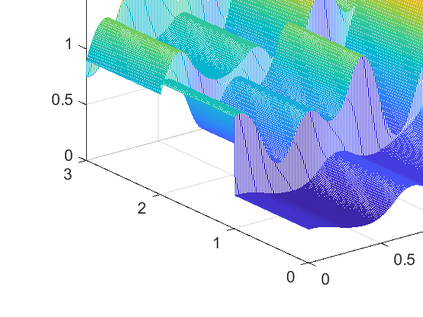

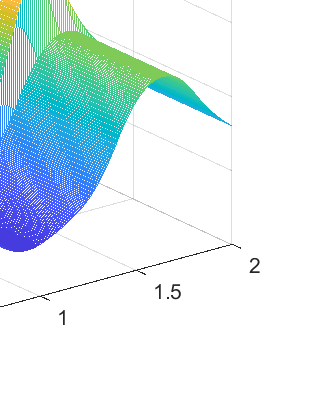

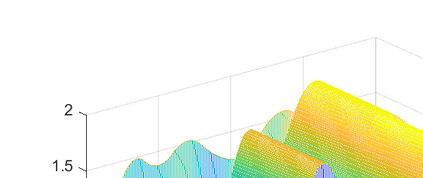

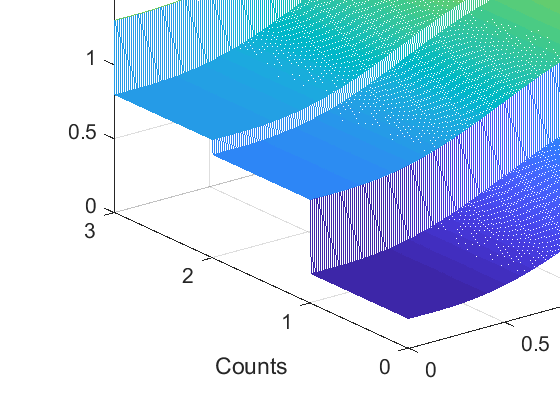

We consider a nonparametric version of the integer-valued GARCH(1,1) model for time series of counts. The link function in the recursion for the variances is not specified by finite-dimensional parameters, but we impose nonparametric smoothness conditions. We propose a least squares estimator for this function and show that it is consistent with a rate that we conjecture to be nearly optimal.

翻译:我们考虑的是用于时间序列的整数值GRCH(1,1,1)模型的非参数版本。 差异重现中的链接函数不是由有限维参数指定, 而是我们设置了非参数平滑条件。 我们为此函数建议一个最小方形估计符, 并显示它符合我们推测的接近最佳的速率 。

相关内容

专知会员服务

20+阅读 · 2020年4月25日

专知会员服务

46+阅读 · 2019年8月10日

Combining Parametric and Nonparametric Models to Estimate Treatment Effects in Observational Studies

Arxiv

0+阅读 · 2021年10月21日

Arxiv

0+阅读 · 2021年10月20日