【泡泡一分钟】预测未来更深层次的语义分割 (ICCV2017-63)

每天一分钟,带你读遍机器人顶级会议文章

标题:Predicting Deeper into the Future of Semantic Segmentation

作者:Pauline Luc, Natalia Neverova, Camille Couprie, Jakob Verbeek, Yann LeCun

来源:ICCV 2017 ( IEEE International Conference on Computer Vision )

播音员:Suzanne

编译:张鲁,周平(68)

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

预测和预知是所谓智能的重要属性。它们在实时系统中也是极为重要的,例如在机器人或者自动驾驶这种需要基于视觉场景理解来进行行为决策的领域中。虽然对未来视频帧中的原始RGB像素值的预测已有相关的研究,我们会在这里介绍预测未来帧语义分割的新任务。

给定一个视频帧序列,我们的目标是预测在将来一秒或更远时间的尚未观察到的视频帧的分割图。我们开发了一个自回归卷积神经网络,学习迭代生成多个帧。我们在Cityscapes数据集上的测试结果表明直接预测未来帧的语义分割的效果会优于先预测RGB帧再进行语义分割的方法。未来半秒的预测结果视觉上看起来是非常可信的,并且精度大幅度优于使用光流辅助语义分割之类的基准方法。

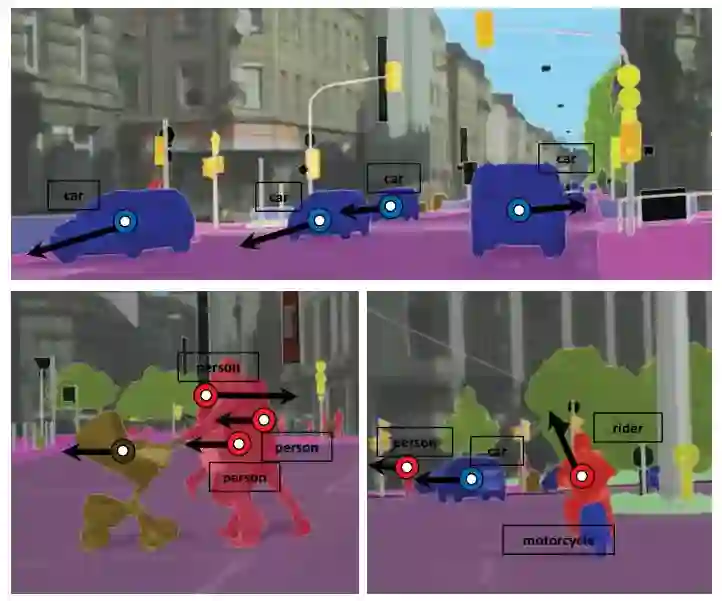

图1. 我们的模型可以学习语义级别的场景中的动态信息,从而可以通过若干过去的图像帧来预测未被观测到的将来的图像帧的语义分割结果。

图2. S2S模型的多尺度结构,该模型可以在给定N_I个视频帧后预测出下一时刻视频帧的语义分割结果。

Abstract

The ability to predict and therefore to anticipate the future is an important attribute of intelligence. It is also of utmost importance in real-time systems, e.g. in robotics or autonomous driving, which depend on visual scene understanding for decision making. While prediction of the raw RGB pixel values in future video frames has been studied in previous work, here we introduce the novel task of predicting semantic segmentations of future frames. Given a sequence of video frames, our goal is to predict segmentation maps of not yet observed video frames that lie up to a second or further in the future. We develop an autoregressive convolutional neural network that learns to iteratively generate multiple frames. Our results on the Cityscapes dataset show that directly predicting future segmentations is substantially better than predicting and then segmenting future RGB frames. Prediction results up to half a second in the future are visually convincing and are much more accurate than those of a baseline based on warping semantic segmentations using optical flow.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com