【论文笔记】用图卷积网络( GCN)来做语义角色标注

【导读】这篇文章提出了一种基于图卷积网络(GCNs)的方法,来做语义角色标注,使用 GCN来编码句法依存树,从而产生该句子中单词的潜在特征表示。

【EMNLP 2017论文】

Encoding Sentences with Graph Convolutional Networks for Semantic Role Labeling

论文链接:https://arxiv.org/abs/1703.04826

语义角色标注(Semantic Role Labeling,SRL)是实现浅层语义分析的一种方式。它以句子的谓词为中心,只分析句子中各成分与谓词之间的关系,即句子的谓词(Predicate)- 论元(Argument)结构,并用语义角色来描述这些结构关系,是许多自然语言理解任务(如信息抽取,篇章分析,深度问答等)的一个重要中间步骤。

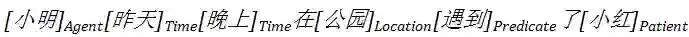

一个常见的例子是:

其中, “遇到” 是谓词(Predicate),“小明”是施事者(Agent),“小红”是受事者(Patient),“昨天” 是事件发生的时间(Time),“公园”是事情发生的地点(Location)。

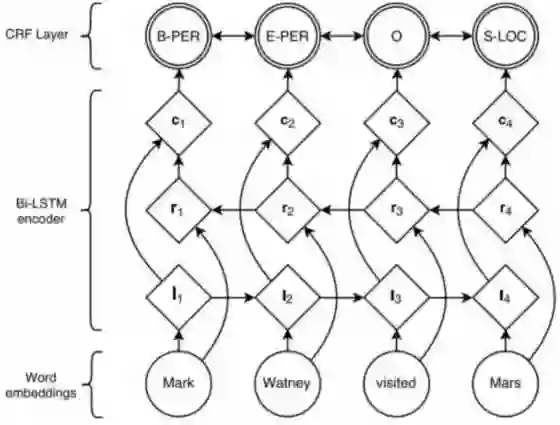

这个问题, 如果在给定谓词(predicate) 的情况下, 可以转化为,给一个句子打标签, 即序列标注模型。而 Bi-LSTM在序列标注模型中,可谓是如日中天,目前的 state-of-the-arts 基本都是基于这个。但测报的使用序列标注模型, 比如经典的下图结构:

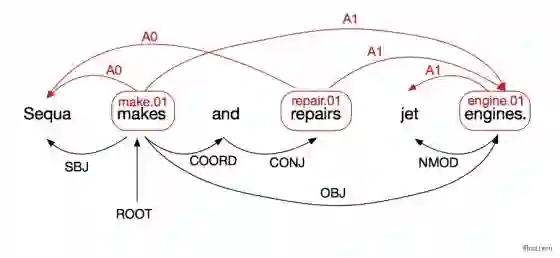

但是这种粗暴的直接上的方式,总是令人摸不着头脑,貌似上述模型,只利用了句子中的信息,实际上有更多的信息可以使用,比如传统的句法分析,观察句法分析的结果和实际的语义角色标注的结果,如果你说他们之间没有联系,显然是不可能的。

如上图所示,句法分析的结果和语义角色标注的结果,大部分都是镜像的。

基于上述观察,Deigo 等人提出了一种基于图卷积网络(GCNs)的方法,来做语义角色标注,使用 GCN来编码句法依存树,从而产生该句子中单词的潜在特征表示。文章观察到GCN层与LSTM层是互补的:当GCN层和LSTM层叠加时,他们的性能获得了最新的 state-of-the-art。

本研究的主要贡献:

• 第一次将 GCN 运用在 NLP领域,并证明 GCN对于 NLP是有用的

• 使用 GCN在词的层面上去刻画语法信息

• 证明了 GCN和 LSTM可以互补,从而能够获得更好的性能

• 在语义角色标注任务,获得了最新的 state-of-the-art

本文提出的方法

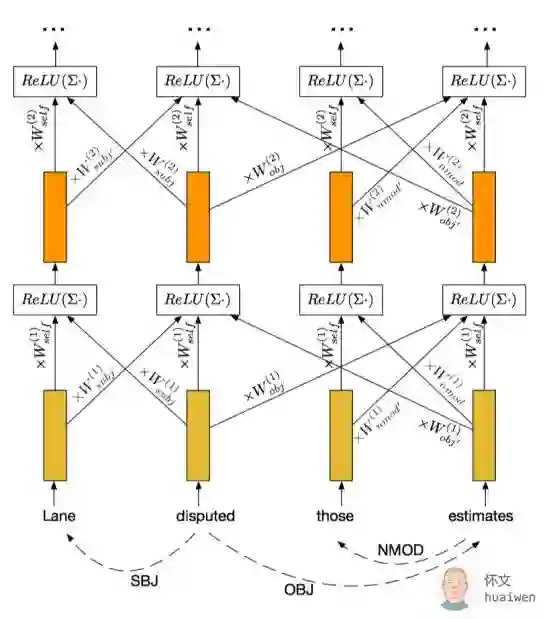

文章将 GCN进行了改进,从而能够使用 GCN来刻画一个句子的依存分析树

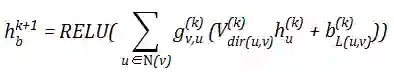

提出了边级别的门的概念Edge-wise gating(类似 Attention),在 GCN的计算过程中,对某些边提权,对某些边降权,最终的GCN计算方法如下:

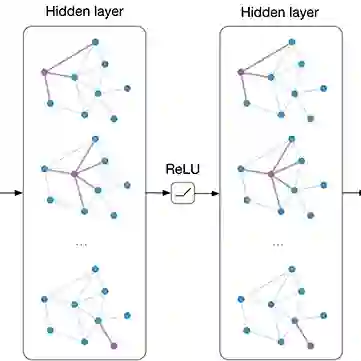

将 GCN接在 LSTM后面,作为句子的语法结构的编码器:

实验

作者在 CoNLLL-2009数据集上进行了实验。

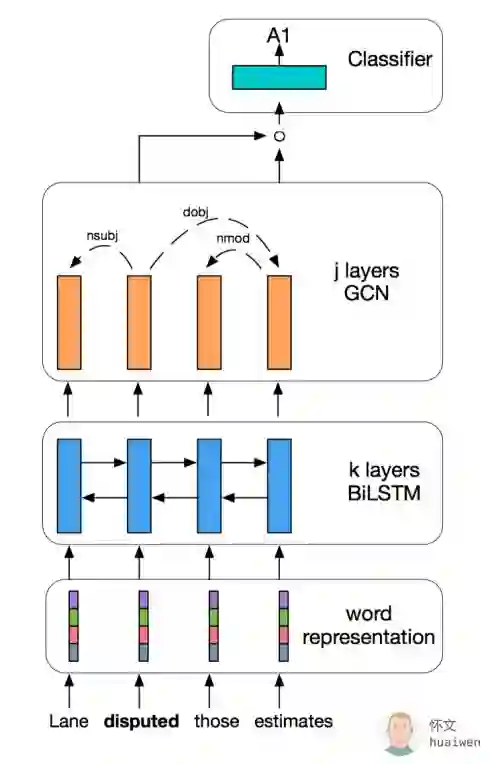

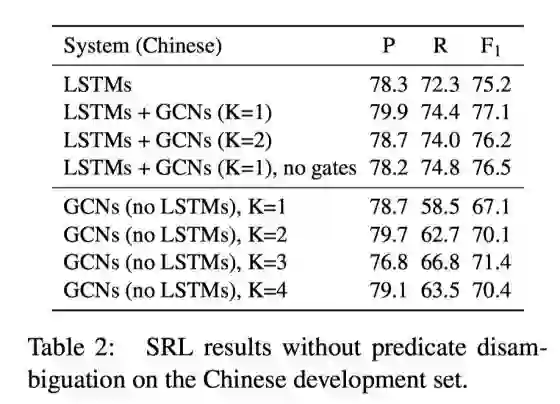

表1和表2, 分别是在没有谓语消岐的情况下,调整 GCN的层数 k(k-hop),对中英文实验预料的结果产生的影响,此外,也对Edge-wise gating对结果产生的影响做了分析。

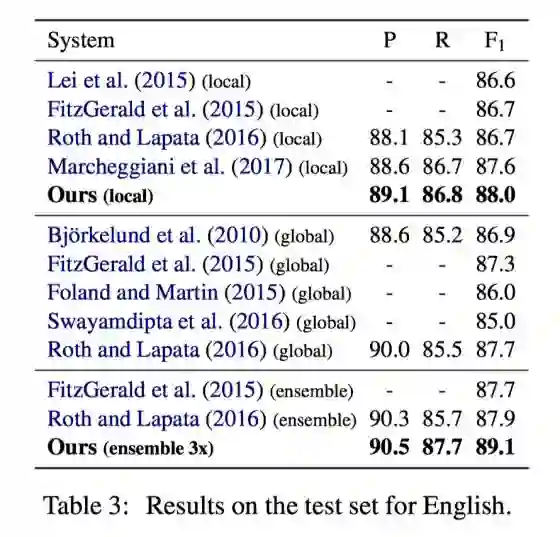

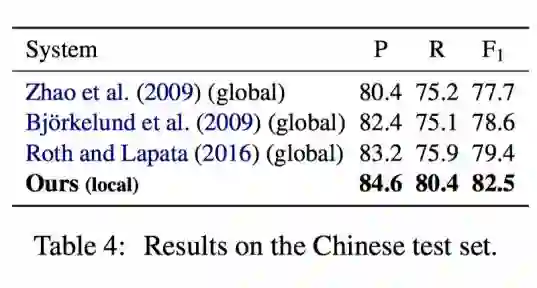

表3和表4分别是作者获得的本文的最优模型与其他系列文章模型的对比,无论是在 Precision,Recall 还是 F1,本文的 GCNs-based SRL 全面取胜。

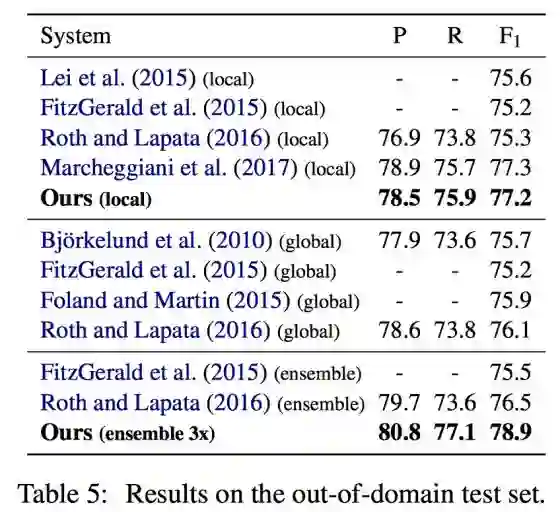

此外,作者做了语料外情况的测试,仍然是 GCNs-based SRL 最优,所有情况都取得了最新的 state-of-the-art, 表明使用 GCN刻画句子的语法结构以及 GCN与 LSTM之间的能力互补所表现的优势。

原文链接:

https://arxiv.org/abs/1703.04826

更多教程资料请访问:专知AI会员计划

-END-

专 · 知

人工智能领域主题知识资料查看与加入专知人工智能服务群:

【专知AI服务计划】专知AI知识技术服务会员群加入与人工智能领域26个主题知识资料全集获取。欢迎微信扫一扫加入专知人工智能知识星球群,获取专业知识教程视频资料和与专家交流咨询!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请加专知小助手微信(扫一扫如下二维码添加),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

请关注专知公众号,获取人工智能的专业知识!

点击“阅读原文”,使用专知