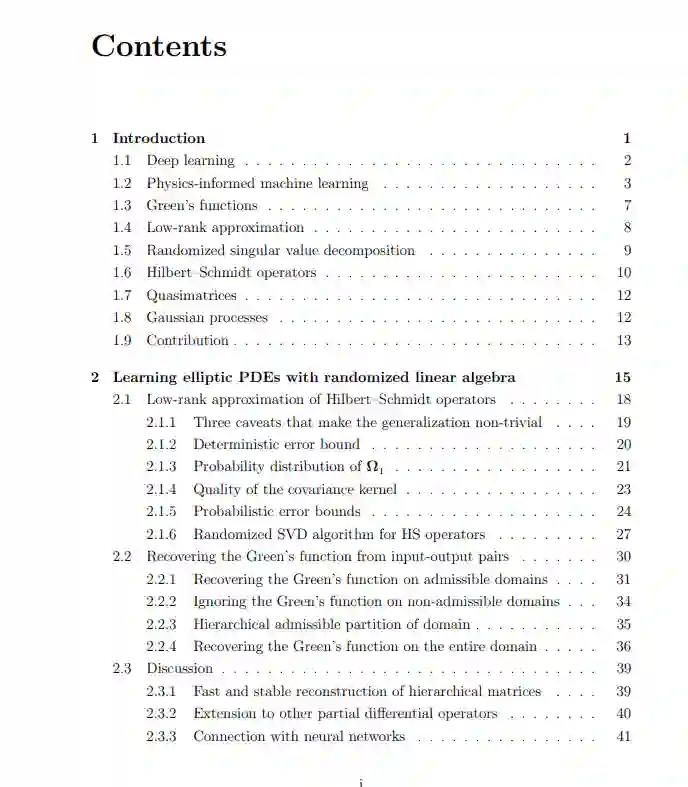

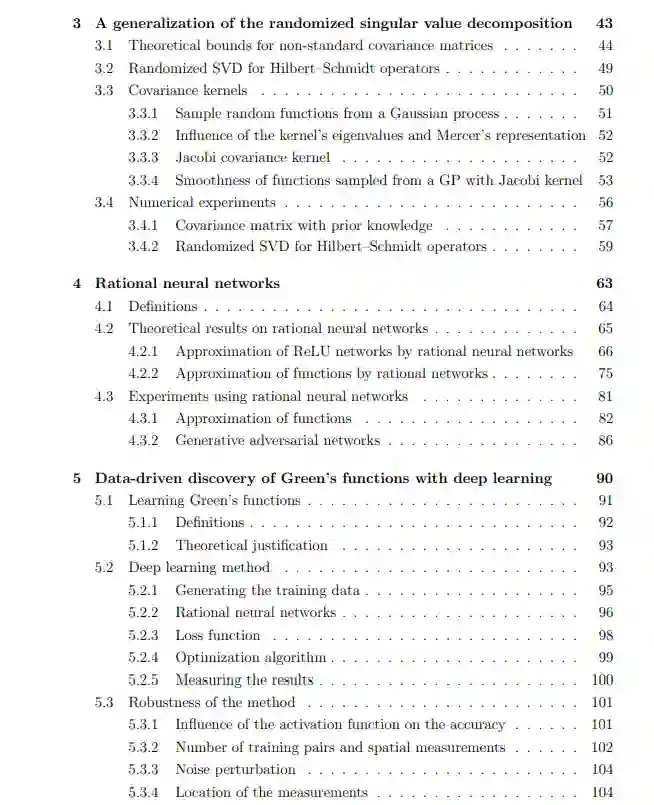

【牛津大学博士论文】深度学习数据驱动发现偏微分方程,160页pdf

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“E160” 就可以获取《 【牛津大学博士论文】深度学习数据驱动发现偏微分方程,160页pdf》专知下载链接

登录查看更多

相关内容

Arxiv

16+阅读 · 2019年4月3日