DALL·E这波超进化,画质艺术感双飞升,还学会了无痕P图

鱼羊 发自 凹非寺

量子位 | 公众号 QbitAI

把椅子上的萌犬P成猫猫,需要几步?

第一步,圈出狗狗。第二步,告诉AI你的需求。鼠标一点,齐活。

这位AI P图大师,其实是位老朋友——OpenAI风靡全球的那位DALL·E。

现在,它刚刚完成了“2.0超进化”。不仅新学了一手出神入化的P图绝技,创作质量也有了飞跃式的提升。

话不多说,直接看作品感受一下~

这是DALL·E 2在“星云爆炸状柯基头”这一提示下的创作出来的画作:

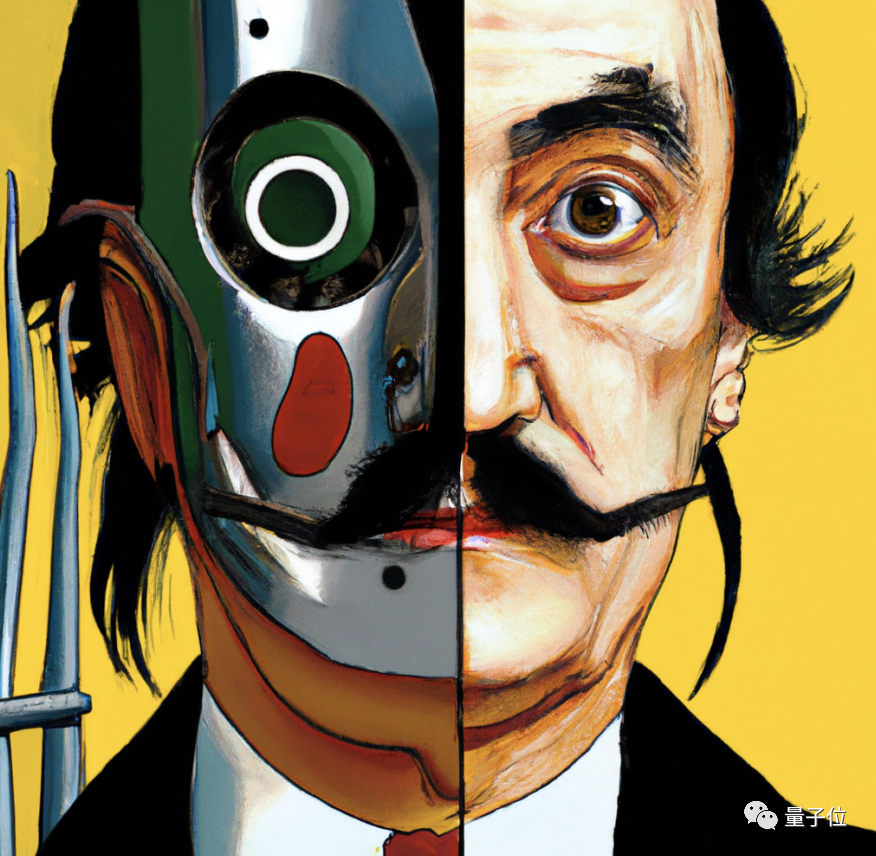

这幅萨尔瓦多·达利的画像,是不是有点萨尔瓦多·达利内味儿了?

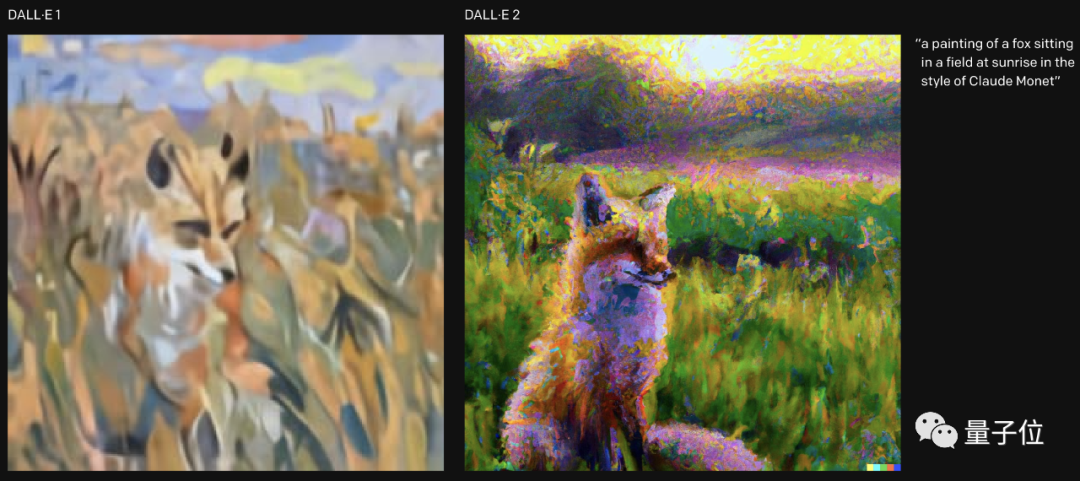

跟初代DALL·E比起来,着实是画质与艺术感双双飞升了。

△“日出时分安坐在田野里的狐狸,莫奈风格”

所以,研究人员具体如何点亮了DALL·E的新技能点?

CLIP+扩散模型

DALL·E此番进化,简单来说就是分辨率更高了,延迟更低了。

此外,还有更新2大新功能:

首先,在更细粒度上实现文本→图像功能。

也就是说,DALL·E 2可以根据自然语言提示进行P图。在P图的过程中,还会考虑阴影、反射、纹理等元素的变化。

比如在左图标“2”的位置P一个火烈鸟泳圈,DALL-E 2会把水面倒影这种细节也处理到位。

其次,是可以在保留原作核心元素的基础之上,赋予原作船新的风格。

并且生成画面的画质是DALL·E 1的4倍,即从256×256提升到了1024×1024。

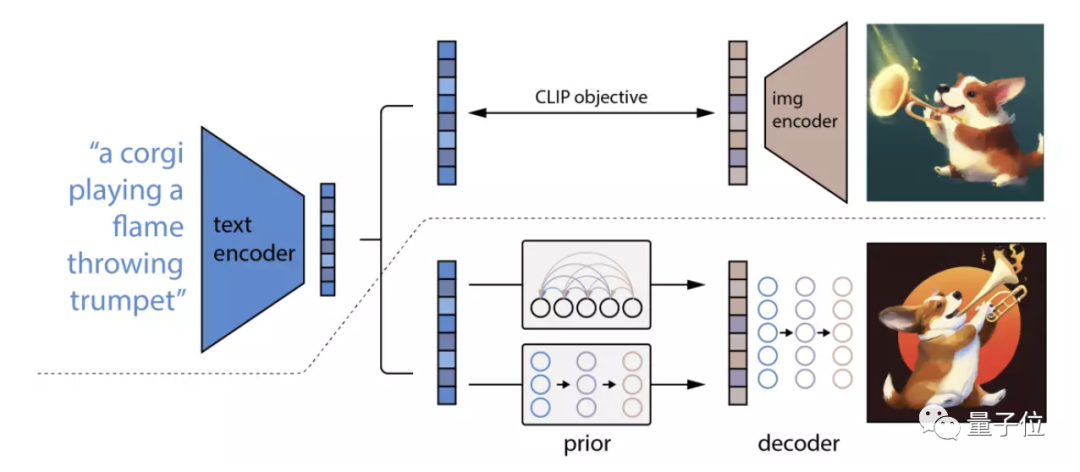

具体的实现方法,用OpenAI官方的话来说,就是结合了CLIP和扩散模型两种技术的优点。

CLIP是原版DALL·E功能实现的基础,是一个负责给图像重排序的模型,其零样本学习能力已经在各种视觉和语言任务上大放异彩。

而扩散模型的特点在于,在牺牲多样性的前提下,能大大提升生成图像的逼真度。

于是,OpenAI的研究人员设计了这样一种方案:

在这个名为unCLIP的架构中,CLIP文本嵌入首先会被喂给自回归或扩散先验,以产生一个图像嵌入。

而后,这个嵌入会被用来调节扩散编码器,以生成最终的图像。

OpenAI解释称,DALL·E能够get图像和用于描述画面的文本之间的关系。其图像的生成是在“扩散”过程中完成的,可以理解为是从“一堆点”出发,用越来越多的细节去把图像填充完整。

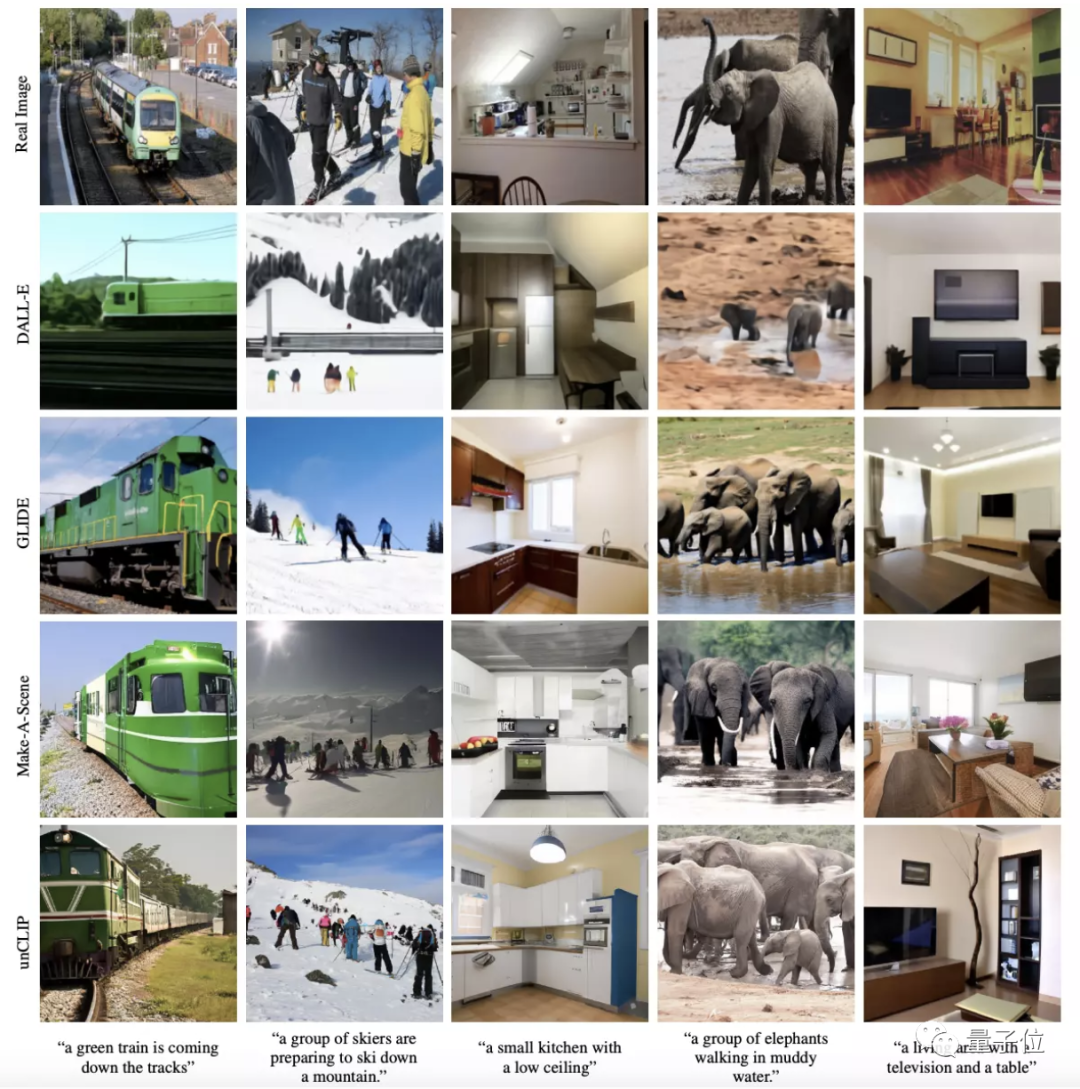

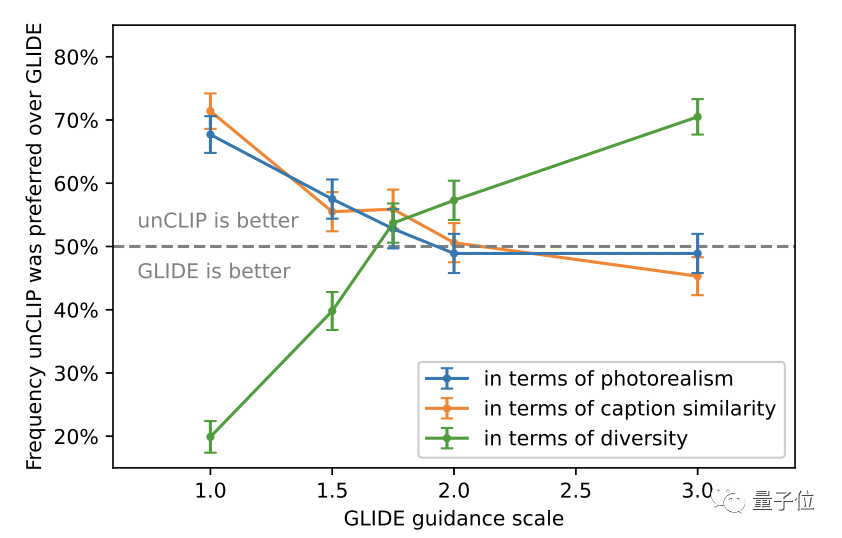

研究人员将DALL·E 2与DALL·E、GLIDE等模型进行了对比。

实验结果显示,DALL·E 2的图像生成质量与GLIDE相当,但DALL·E的生成结果更具多样性。

目前,DALL·E 2并未对公众开放,不过如果你感兴趣,可以在线注册申请一发~

项目地址:

https://openai.com/dall-e-2/#demos

— 完 —

「人工智能」、「智能汽车」微信社群邀你加入!

欢迎关注人工智能、智能汽车的小伙伴们加入我们,与AI从业者交流、切磋,不错过最新行业发展&技术进展。

ps.加好友请务必备注您的姓名-公司-职位哦~

点这里👇关注我,记得标星哦~

一键三连「分享」、「点赞」和「在看」

科技前沿进展日日相见~