强的离谱,Transformer杀疯了!

前段时间 Transformer已席卷计算机视觉领域,并获得大量好评,如『基于Swin-Transformer』、『美团提出具有「位置编码」的Transformer,性能优于ViT和DeiT』、『Lifting Transformer』、『TimeSformer』等等

Transformer为什么这么有实力?

因为它在分类、检测等任务上展现了极其强劲的性能。而且骨干网络上的发展也推动了下游任务的发展,Swin Transformer 更是成了屠榜般的存在,在工业界具有广阔的应用前景。所以引起了人工智能研究生的强烈兴趣。

但要想啃透 CV Transformer 难度不小:一方面,Transformer 本是应用于 NLP的论文,其中很多内容都形成了共识,在论文中并不会去详细介绍这些共识内容,例如 QKV是什么,embedding 是什么等,对于其他方向的人看到这些就很难理解。

尽管已经引起了极大的关注,但将其应用于其他领域时仍面临许多挑战,包括从方法论的合理性到实际商业业务表现。

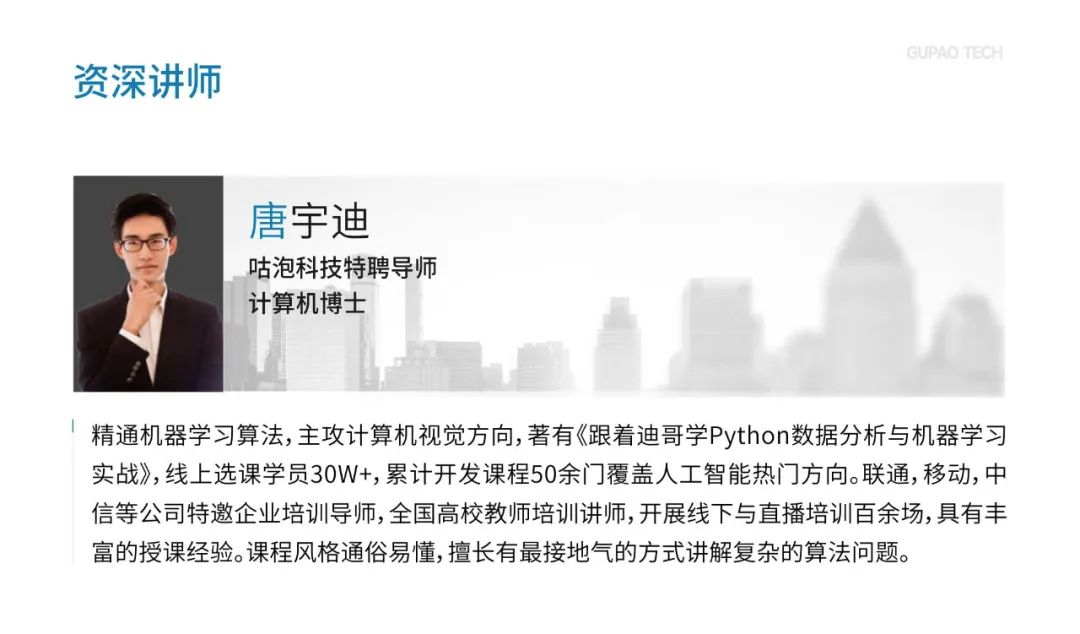

咕泡科技很荣幸的邀请到了在人工智能、计算机视觉领域有着丰富的一线实战经验的唐宇迪博士,利用2天的时间,为大家系统地梳理Transformer技术。

直播时间 :8月24日-8月25日,20:00-22:30

Day1:深度学习CNN卷积神经网络算法精讲

-

神经网络模型知识点分析

-

神经网络模型整体架构解读

-

卷积神经网络整体架构及参数设计

Day2:AI领域最火模块Transformer实例解读

-

2022AI领域大杀器--Transformer架构思想分析 -

论文刷点创新必备模块--注意力机制解读 -

2022各大厂项目如何与Transformer结合与落地 -

Transformer前沿研究方向分析与探索

对Transformer技术感兴趣的同学,扫下方二维码,预约直播。

原价199

扫描下方二维码

0.02元报名 !

福利较大,限前100名

讲师带练,伴随式编程环境

同时还有@唐宇迪老师将会分享 , 一线热门技术和行业经验,众多学员亲测有效的一套技术提升方案,帮你摆脱迷茫,明确成长方向!

三位一体跟踪服务,项目实战驱动 , 深刻理解原理

完课礼包

注意:已整理到网盘 , 添加助理 , 报名课程后免费领取!

福利较大,限前100名

Q&A

登录查看更多

相关内容

Transformer是谷歌发表的论文《Attention Is All You Need》提出一种完全基于Attention的翻译架构

专知会员服务

45+阅读 · 2022年3月1日