前沿 | 谷歌AI脑神经元绘制法登上Nature子刊:速度提升一个数量级

选自Google.AI

作者:Viren Jain、Michal Januszewski

机器之心编译

参与:李泽南、张倩、王淑婷

人类对于生物大脑的探索是永无止境的,模仿生物的人工智能是否可以帮助我们进行研究?最近,来自谷歌的研究人员提出了一种新的循环神经网络,它可以快速构建生物大脑的 3D 神经模型。谷歌称,新的方法可以「将连接组学提升一个数量级」。目前,该研究的论文已经发表在 Nature 子刊《Nature Methods》上。

连接组学旨在综合描绘在神经系统中发现的神经网络结构,以更好地理解大脑的运作模式。这一过程需要对大脑组织进行纳米级的 3D 成像(通常使用电子显微镜),然后分析成像数据结果以追踪大脑的神经突触并识别单个突触连接。由于成像分辨率高,即使是一立方毫米的大脑组织也能产生 1000 多 TB 的数据!这些图像中的结构相当复杂、精细,因此大脑成像的主要瓶颈在于数据的自动解读,而非获取。

如今,谷歌与马克斯-普朗克神经生物学研究所的研究人员合作,在《Nature Methods》杂志上发表了一篇名为《High-Precision Automated Reconstruction of Neurons with Flood-Filling Networks》的论文。该论文介绍了一种新型的循环神经网络,该网络在自动解读连接组学数据的准确性方面比以往的深度学习技术提高了一个数量级。

论文获取链接:https://www.biorxiv.org/content/early/2017/10/09/200675.full.pdf+html

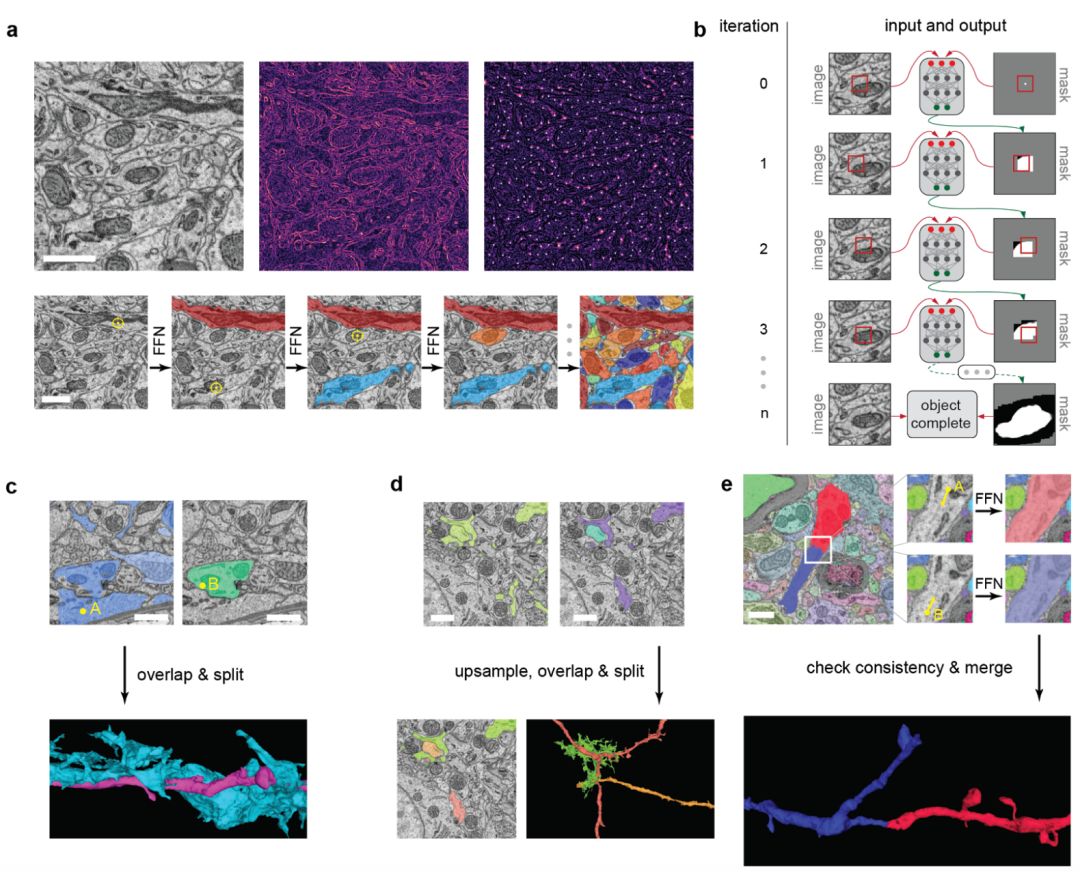

基于泛洪算法网络(Flood-Filling Network)的 3D 图像分割

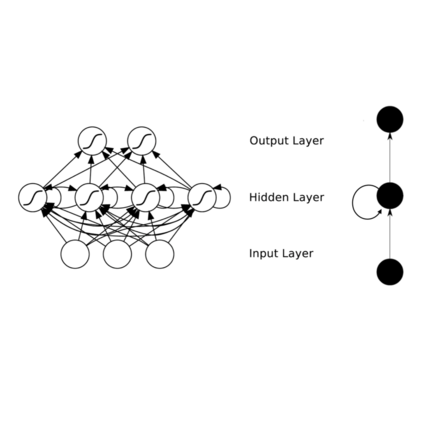

追踪大量电子显微镜数据中的神经突触是图像分割问题的一个实例。传统的算法将该过程至少分为两步:利用边缘检测器或机器学习分类器找到神经突触之间的边界,然后使用分水岭或图像分割等算法将未被边界分隔的图像像素组合在一起。2015 年,我们开始尝试一种基于循环神经网络的替代方法,将这两个步骤统一起来。该算法被嵌在特定的像素位置,然后使用循环卷积神经网络迭代地「填充」某一区域,该循环卷积神经网络用来预测哪些像素属于与种子相同的对象。自 2015 年以来,我们一直致力于将这种新方法应用于大规模的连接组学数据集,并严格量化其准确率。

在 2D 图像中分割物体的泛洪算法网络。黄点是当前焦点区域的中心;该算法在迭代检查更多图像区域的同时扩展分割区域(蓝色)。

通过预期运行长度测量准确率

我们与马克思·普朗克研究所的研究人员合作,设计了一种被称之为「预期运行长度」(ERL)的度量标准,它测量以下内容:给定大脑 3D 图像中随机神经元内的随机点,在出错前,我们能追踪神经元多远?这是一个典型的「平均故障间隔时间」问题,只不过在这里我们测量的是故障间隔的空间量而不是时间量。对于工程师来说,ERL 的吸引力在于它将线性物理路径长度与算法产生的个别错误的频率关联起来,并且可以直接计算。对于生物学家来说,吸引力在于 ERL 的特定数值与生物相关的量相关,例如神经系统不同部分中神经元的平均路径长度。

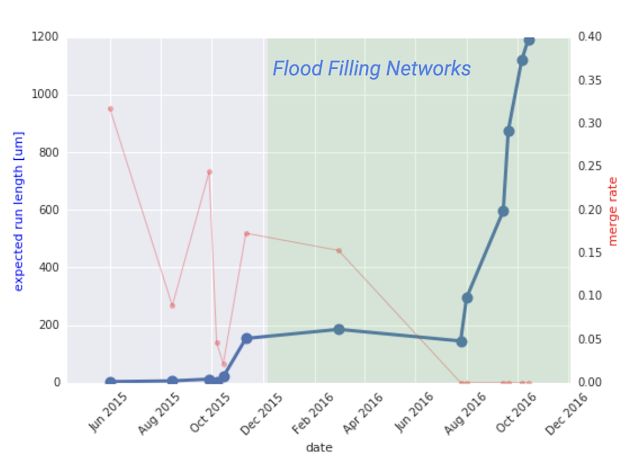

预期运行长度(蓝线)的进展带来了今天在《Nature Methods》上共享的结果。红线表示「合并率」的进展,合并率测量两个分离的神经突被错误地追踪为单个目标的频率;达到非常低的合并率对于实现手动识别和校正重建中剩余误差的有效策略至关重要。

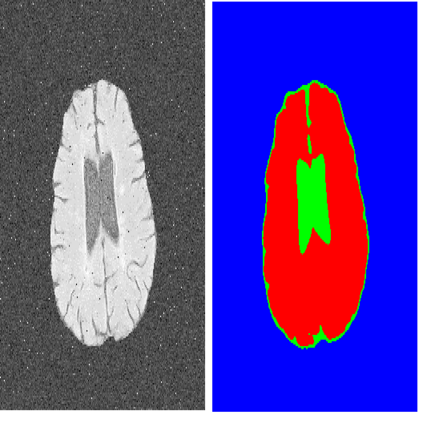

图像分割过程

鸣禽连接组学

我们用 ERL 测量了一百万立方微米斑胸草雀大脑中一组基本真实神经元的进展,斑胸草雀大脑通过我们的合作伙伴使用肖特基场发射扫描电子显微镜而成像。实验结果发现我们的方法优于之前应用于同一数据集的其他深度学习方法。

谷歌提出的算法在鸣禽大脑中追踪单个神经突的 3D 过程。

研究人员使用新的泛洪网络算法对斑胸草雀大脑一小部分的每个神经元进行了分割绘图,如下视频所示:

重建斑胸草雀大脑的一部分。在图像分割中,不同颜色对应不同对象,这些都是由泛洪网络自动生成的。金色球是使用以前发布的方法自动识别突出位置。

谷歌研究人员正和马克思·普朗克研究所的同僚们通过这种自动化方法,辅以少量人力协助以解决一些疑难问题。他们现在正致力于研究鸣禽连接组以寻求新理解,如研究斑胸草雀如何唱歌,以及它们如何学会唱歌。

展望

谷歌研究人员表示,他们在未来将继续改进连接组重构技术,目标是实现突触级分辨率连接组的全自动化,并为马克思·普朗克研究所及其他机构的连接组项目作出贡献。为了帮助支持更大的研究团队开发连接组技术,他们开源了泛洪算法网络方法的 TensorFlow 代码(https://github.com/google/ffn/)以及用于 3D 数据集的 WebGL 可视化软件,以帮助人们理解和改进目前的方法。

论文:High-precision automated reconstruction of neurons with flood-filling networks

论文链接:https://www.nature.com/articles/s41592-018-0049-4

摘要:从大量的电子显微镜数据中重建神经回路需要追踪完整的细胞,包括其所有的神经突触。虽然人们已开发出自动化方法用于跟踪,但此方法错误率高,如果没有人工检查就无法产生可靠的连接图。在此背景下,我们提出了一种自动分割方法——泛洪算法网络,该方法与之前大多数研究类似,使用的是卷积神经网络,但还包含一个允许迭代优化和单个神经元拓展的循环路径。我们使用泛洪网络跟踪数据集中的神经元,数据是使用肖特基场发射扫描电子显微镜观察斑胸草雀大脑获得。通过该方法我们实现了 1.1 毫米的平均无误差神经突触路径长度,并且在路径长度为 97 毫米的测试集中仅观察到四个合并。尽管计算成本大幅增加,但泛洪网络的性能比以往用于该数据集的方法提高了一个数量级。

原文链接:https://ai.googleblog.com/2018/07/improving-connectomics-by-order-of.html

本文为机器之心编译,转载请联系本公众号获得授权。

✄------------------------------------------------

加入机器之心(全职记者 / 实习生):hr@jiqizhixin.com

投稿或寻求报道:content@jiqizhixin.com

广告 & 商务合作:bd@jiqizhixin.com