走近3D ToF摄像头,揭秘ToF传感器工作原理

在争夺智能手机和汽车市场的战争中,出现了三种领先的3D成像技术。这三种技术分别是双目立体成像、结构光和飞行时间(ToF)。通过这些技术生成的3D数据可实现行人探测、人脸识别、手部运动检测以及提供SLAM(simultaneous localization and mapping,即时定位与地图构建)功能。

目前该领域领先的两家公司分别是ams(艾迈斯半导体)和Infineon(英飞凌)。

飞行时间原理和框图

本文将以pmdtechnologies(以下简称pmd)与英飞凌合作的3D摄像头开发套件“pico flexx”为例,重点介绍ToF传感器背后的技术。

Pico flexx为英飞凌和pmd共同开发的ToF图像传感器REAL3构建的。

从pmd官网下载的一只手的伪彩色3D图像,根据ToF传感器到手的距离将颜色映射到每个像素(红色表示距离近,蓝色表示距离远)

什么是ToF传感器?

ToF传感器测量光在某介质中行进一段距离所需的时间。通常,这是对脉冲发射光到达物体并反射回到ToF传感器所用时间的测量。ToF摄像头则利用ToF测量原理(ToF图像传感器)来确定摄像头与物体或周围环境之间距离,并通过测量的点生成深度图像或3D图像。

ToF摄像头的应用包括基于激光的非扫描激光雷达成像系统、运动传感和追踪、运用于机器视觉和自动驾驶的物体检测以及地形测绘等。

但如何实现上述应用领域的深度测量?

下面,介绍三种通过测量飞行时间来确定距离的方法。

上图顶部表达了第一种方法,发射脉冲光并测量它们经反射后返回的时间间隔。

上图中间表达了第二种方法,调制光源的振幅并记录反射光波的相移。

上图底部表达了第三种方法,发射占空比为50%的方波,并记录在特定间隔内到达的返回光量。

毫米级精度ToF摄像头

光波和无线电波以接近300,000,000,000mm/s的速度传播,相当于传播1mm的距离需要大约3.3ps(同时还需要3.3ps返回时间)。这意味着,如果你想要能对你所在房间的所有物体成像并且想要达到1mm分辨率的设备,计时电子器件需要达到皮秒级的分辨率,也就是相当于数百GHz的时钟频率。

设计在GHz级别频率下工作的电子电路既不容易,也不经济,因此,如果设计者希望消费者能够负担得起这些器件,他们就必须想出一种在较低频率下工作的方法。

在合理的sub-GHz频率下工作时,有两种常见的方法可以实现毫米级精度:

• 将正弦调制波的相移与距离相关联

• 使用占空比为50%方波的相移和差分电压来确定距离

在下面的章节中,我们将更详细地讨论这两种方法。

通过幅度调制波的相移确定距离

假设你正在绘制一间最大长度为15米的小型办公室或大型起居室。为了确定测量该长度的适宜工作频率,使用公式c=λ⋅ƒ,其中c是光速(c=3x10⁸m/s),λ是波长(λ=15m),ƒ是频率。在此示例中,ƒ=20MHz是一个相对经常使用的频率。

当强光的输出经20MHz正弦信号调制时,测量旅程开启。光波最终会到达测量物体或墙壁,然后调转方向反射回来。原始光经过调制后将返回到接收器。除非物体正好是15m以外的整数倍,否则相位会略微偏移。

相移可以用来计算波传播的距离。

如果你能精确地测量相位角,你就能准确地确定反射物体与传感器/探测器之间的距离。

如何测量正弦波的相位角

那么,如何快速测量正弦波的相位角呢?这包括在四个等距点(例如90°或1/4λ的间隔)测量接收信号的幅度。

在此解释下测量值和相位角之间的关系。A1和A3的差值与A2和A4的差值的比等于相位角的正切值。ArcTan实际上是双变量反正切函数,可映射至适当的象限,当A2=A4并且A1>A3或A3>A1时,分别定义为0°或180°。

在上图中,图表的最左侧有两条垂直数字线,显示了A1和A3(表示为深黄色)以及A2和A4(表示为蓝色)的相减结果。测量值显示为中间的正弦曲线图中的垂直线

请注意,该图形没有考虑反射(反射会有效地将所有内容移动180°)。

如何确定给定距离下的工作频率

回到我们的例子,到目标物的距离由以下公式确定:

其中c是光速,φ是相位角(以弧度来度量),ƒ是调制频率。

测量一个光子的实际飞行时间需要频率为333GHz的电子设备。这种方法最大需要四倍的调制频率,也就是4 x 20MHz=80MHz。这显著减少了资源的使用。但相信你会更高兴,因为聪明的工程师们找到了进一步降低最大频率的方法。

通过带电电容器的差分电压测量确定相移

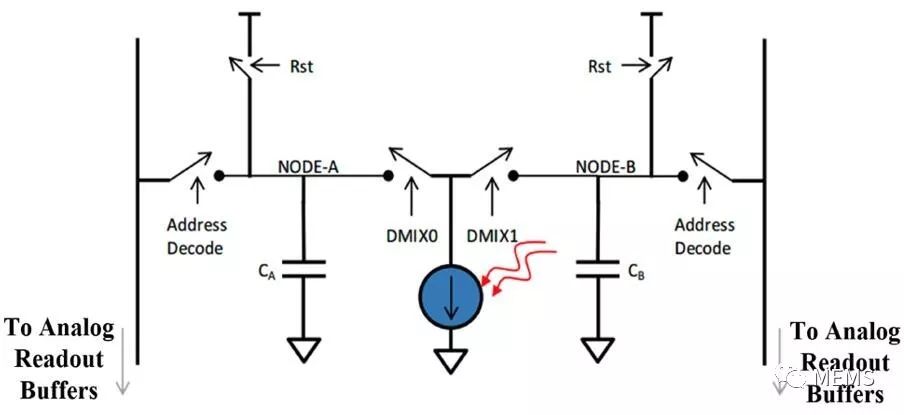

另一种测量方法含有频闪光源和每个像素中包括两个电容的CMOS图像传感器。

时钟源可产生占空比为50%的方波,该方波控制明亮的频闪光源以及与每个像素内电荷存储电容器的连接。

该测量方法的示例如下图所示:

上图显示了每个像素中包括两个电荷存储电容器的CMOS图像传感器,切换两个电荷存储电容器的连接以记录入射光

光子由光源发射,并从物体上反射回来,被图像传感器像素单元接收,此时光将作为电荷记录在上图所示的电容器CA或CB中。使用相同的时钟源,电容器能够以与照明源相同的频率交替连接至像素单元。

这种巧妙的设计意味着电容中的差分电荷与相位偏移直接相关。相位由波长和到目标的距离决定。

可以根据需要进行多次循环照明,以对电容充电。只要距离恒定,电荷比例将保持不变。

ToF传感器在发力

这种方法效果如何?比你想象的要好。

提供给AAC的传感器与所附软件相辅相成,能够记录高达45fps的数据。在较低的刷新率下,系统仍可以轻松地将衬衫上的褶皱成像。

上图描绘了通过pmd的pico flexx摄像头捕获的每个像素(x,y,z)顶点位置

纯深度数据本身很难可视化。因此,深度图像通常与图片相结合,或者使用伪彩色来显示,以便于场景的可视化。

低分辨率图像的伪彩色深度叠加使场景的展示更加容易,用pmd的Royal Viewer软件和CamBoard pico flexx 3D开发套件捕获的作者头像

ToF传感器可用于一系列消费、汽车和工业应用中,包括在将人工智能与3D成像相结合,实现各种智能传感与识别功能,以改变传统2D视觉的局限。

文章来源:麦姆斯咨询

https://mp.weixin.qq.com/s/ey316GEyaELRg1wSi-16jg

免责声明:未标注来源的内容均来源于互联网,我们对文中的观点保持中立,仅供参考、交流之目的。转载的稿件版权归原作者和机构所有,如有侵权,请联系我们删除或支付稿酬。

往期热文(点击文章标题即可直接阅读):