SIGIR2022 | 推荐算法之对比学习篇

SIGIR 2022已公布录用论文,投稿长文794篇/短文667篇,录用长文161篇/短文165篇,录用率长文20%/短文24.7%,完整录用论文列表见https://sigir.org/sigir2022/program/accepted/。

本文选择推荐系统对比学习方向的论文进行解读,包括5篇Long Paper,6篇Short Paper。

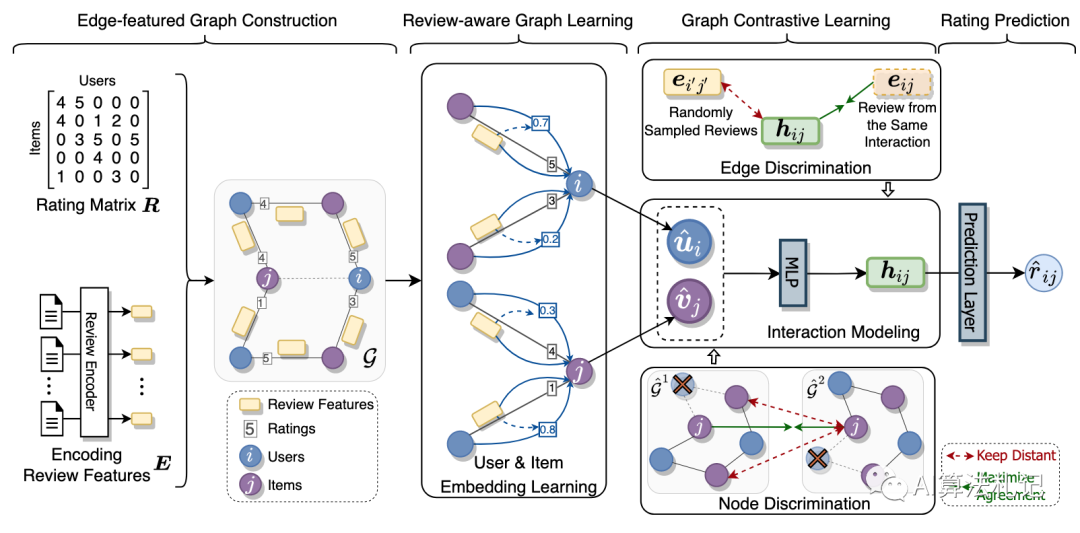

1. A Review-aware Graph Contrastive Learning Framework for Recommendation

论文链接: https://arxiv.org/abs/2204.12063

论文机构: 合工大、清华

论文分类: (图)对比学习、基于评论的推荐

论文总结: 推荐模型通常包括两个组件:用户/项目embedding的学习 和 用户-项目交互建模。基于评论的推荐模型可以更好地建模用户和商品的交互,然而,当前基于评论的推荐模型存在两个缺点:首先,基于评论的推荐可以自然地形成具有评论边特征的用户项目二部图,那么如何更好地利用这种独特的图结构进行推荐呢?其次,当前大多数模型都存在用户行为较少的问题,我们能否利用评论图中独特的自监督信号来更好地指导两个推荐组件?

为了充分利用具有评分和评论边特征的用户-项目二部图的独特结构,以及利用评论信息来增强用户/项目嵌入和用户-项目交互建模,我们提出了一种新颖的评论感知图对比学习框架 (Review-aware Graph Contrastive Learning,RGCL),用于用户偏好建模和评分预测。具体来说,首先构建一个评论感知的用户项目图,该图具有特征增强边,其中每个边特征都由用户项目评分和相应的评论语义组成。这个具有特征增强边的图可以帮助专注地学习每个邻居节点的权重,以更有效地将评论信息整合到用户和项目嵌入学习中。之后,设计了两个额外的对比学习任务(即节点增强和边增强)来约束 RGCL 以获得更好的节点嵌入和交互建模,并基于得到的交互特征来预测评分。最后,对五个基准数据集的广泛实验证明了RGCL与最先进基线相比的优越性。

2. Are Graph Augmentations Necessary? Simple Graph Contrastive Learning for Recommendation

论文链接: https://arxiv.org/abs/2112.08679

代码链接: https://github.com/Coder-Yu/QRec

论文机构: 昆士兰大学、山大、格里菲斯大学

论文分类: (图)对比学习

论文总结: 这篇博客SIGIR2022 | SimGCL: 面向推荐系统的极简图对比学习方法已经做了非常精彩的解读,感兴趣的朋友可以拜读一下。

该文首先通过实验揭示了在基于对比学习范式的推荐模型中,对比学习通过学习更统一的用户/项目表示来进行推荐,这可以隐式地缓解流行度偏差。同时,还揭示了过去被认为是必要的图增强操作在推荐领域只是起到了很小的作用。基于这一发现,该文提出了一种简单的对比学习方法,该方法丢弃了图增强机制,而是将均匀噪声添加到嵌入空间以创建对比视图。本文最大贡献在于通过实验证明了,面向推荐的图对比学习中,图增强不是必须的。而对比学习对于推荐效果的提升主要来自于学习到更均匀的表征分布。 https://zhuanlan.zhihu.com/p/527562510

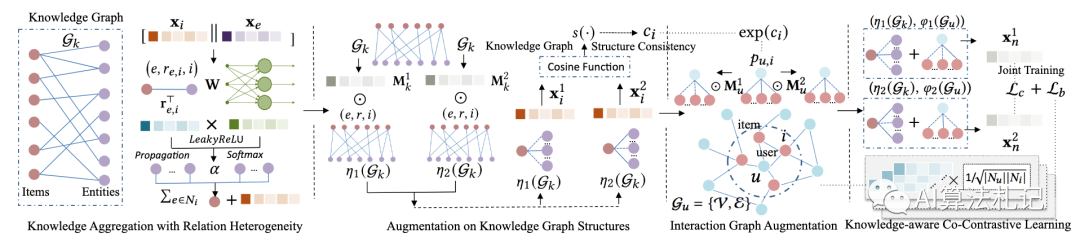

3. Knowledge Graph Contrastive Learning for Recommendation

论文链接: https://arxiv.org/abs/2205.00976

代码链接: https://github.com/yuh-yang/KGCL-SIGIR22

论文机构: 港大、武大

论文分类: (图)对比学习、知识图谱

论文总结: 知识图谱(Knowledge Graph,KG)通常包含丰富的事实和商品间内在的语义关系,已被用作有用的辅助信息来提高推荐质量。然而,此类方法的成功依赖于高质量的知识图谱,并且可能因为两个挑战无法学习高质量的表征:i)实体的长尾分布导致知识图谱增强商品表征的监督信号稀疏;ii) 现实世界的知识图谱通常存在噪声,并且包含商品和实体之间与主题无关的连接。这种知识图谱的稀疏性和噪声使得商品间的实体依赖关系无法反映它们的真实特征,这显著放大了噪声效应,阻碍了用户偏好的准确表示。为了填补这一研究空白,我们设计了一个通用的知识图谱对比学习框架(KGCL),以减轻基于知识图谱的推荐系统中的信息噪声。具体来说,我们提出了一种知识图谱增强范式来抑制信息聚合中的知识图谱噪声,并学习商品更强大的知识感知表示。此外,我们利用来自知识图谱增强过程的额外监督信号来指导跨视图对比学习范式,在梯度下降中为无偏的用户-商品交互提供更大的权重,并进一步抑制噪声。在三个公共数据集上进行的大量实验证明了我们的 KGCL 始终优于最先进的技术。KGCL 在具有稀疏用户-商品交互、长尾和嘈杂的知识图谱实体的推荐场景中也取得了强大的性能。

结构包括三部分:1)基于关系的知识聚合(Relation-aware Knowledge Aggregation),在商品及其连接实体之间建立了信息聚合机制,基于异构注意力聚合器 (heterogeneous attentive aggregator)生成知识感知的物品embedding;此外,为了进一步增强实体-商品依赖的多关系语义表示空间,在关系感知知识聚合器和 TransE 之间执行替代训练。2)知识图谱增强(Knowledge Graph Augmentation),在输入知识图谱上采用随机数据增强方案来生成两个相关的数据视图,通过实体自判别 (entity-wise self-discrimination)进行对比学习。3)知识引导的对比学习(Knowledge-Guided Contrastive Learning),将知识图增强模式与图对比学习范式相结合,旨在提高基于图的协同过滤在模型准确性和鲁棒性方面的表示能力。为了在用户偏好学习中有效地传递有用的商品外部知识,为用户-商品交互设计了两个对比表示空间。在这种对比学习框架中,可以利用去噪商品知识来指导用户和商品表示,并减轻监督信号的稀疏性。不太了解这个任务,看起来太复杂了,提升也不够明显,篇幅原因,更多细节可以参考[2]。

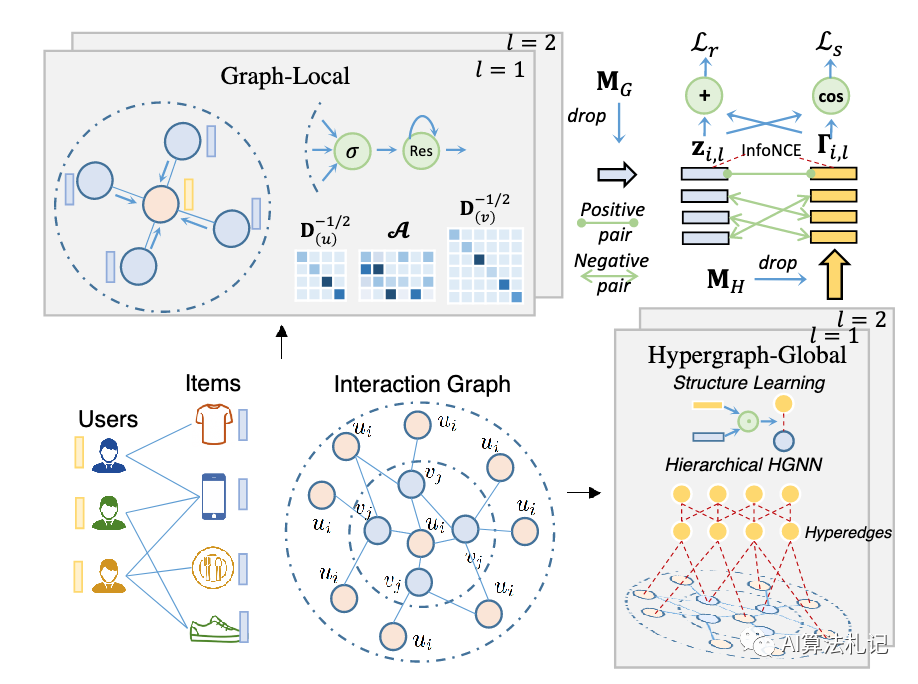

4. Self-Augmented Recommendation with Hypergraph Contrastive Collaborative Filtering

论文链接: https://arxiv.org/pdf/2204.12200

代码链接: https://github.com/akaxlh/HCCF

论文机构: 港大、华南理工、百度等

论文分类: (图)对比学习、协同过滤

论文总结: 协同过滤 (Collaborative Filtering, CF)已经成为将用户和商品参数化到潜在表示空间的基本范式,它们的相关模式来自交互数据。在各种协同过滤技术中,基于 GNN 的推荐系统 (例如 PinSage 和 LightGCN)的开发提供了最先进的性能。然而,现有解决方案中的两个关键挑战尚未得到很好的探索:i) 更深层次的基于图的协同过滤架构的过平滑效应可能导致无法区分的用户表示和推荐结果的退化;ii) 监督信号 (即用户-项目交互)在现实中通常是稀缺且偏置分布的,这限制了协同过滤范式的表示能力。

为了应对这些挑战,我们提出了一种新的自监督推荐框架 Hypergraph Contrastive Collaborative Filtering (HCCF),以通过超图增强的跨视图对比学习架构同时捕获本地和全局协同关系。特别是设计的超图结构学习增强了基于 GNN 的协同过滤范式的判别能力,从而全面捕捉用户之间复杂的高阶依赖关系。此外,我们的 HCCF 模型有效地将超图结构编码与自监督学习相结合,以增强推荐系统的表示质量。在三个基准数据集上进行的大量实验证明了我们的模型优于各种最先进的推荐方法,以及对稀疏用户交互数据的鲁棒性。

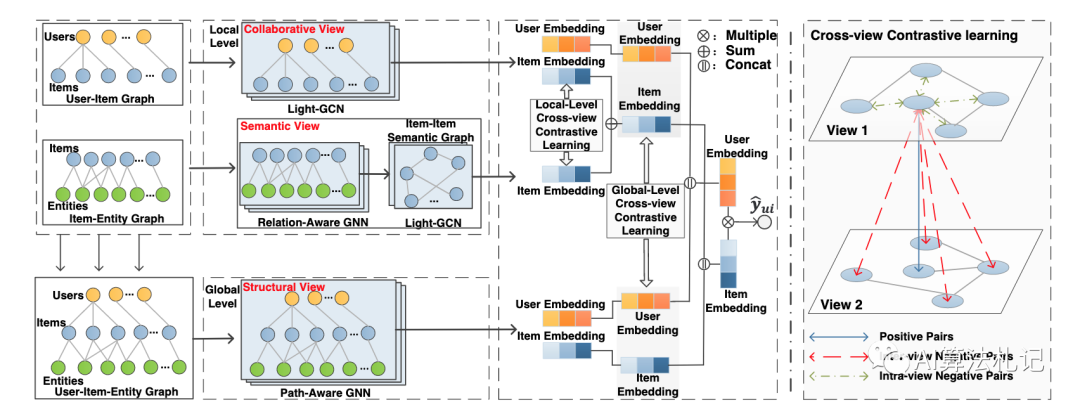

5. Multi-level Cross-view Contrastive Learning for Knowledge-aware Recommender System

论文链接: https://arxiv.org/pdf/2204.08807

代码链接: https://github.com/CCIIPLab/MCCLK

论文机构: 华科、北理工、阿里等

论文分类: 对比学习、图网络、知识图谱

论文总结: 知识图谱 (KG)在推荐系统中扮演着越来越重要的角色。最近,基于图神经网络 (GNNs)的模型逐渐成为知识感知推荐 (KGR)的主题。然而,基于GNN的KGR模型存在一个天然的缺陷,即监督信号稀疏问题,这可能会使其实际性能有所下降。

受最近对比学习成功从数据本身挖掘监督信号的启发,在本文中,我们专注于探索知识图谱感知推荐中的对比学习,并提出了一种新颖的多级跨视图对比学习机制,命名为MCCLK。与传统的对比学习方法通过统一的数据增强方案(例如损坏或丢弃)生成两个图视图不同,我们综合考虑了三种不同的图视图用于知识图谱感知推荐,包括全局级结构视图、局部级协同和语义视图。具体来说,我们将用户-商品图视为协同视图,将商品-实体图视为语义视图,将用户-商品-实体图视为结构视图。因此,MCCLK 在局部和全局级别的三个视图上执行对比学习,以自监督的方式挖掘全面的图特征和结构信息。此外,在语义方面,提出了一个𝑘-最近邻 (𝑘NN)商品-商品语义图构建模块,以捕获以前工作通常忽略的重要商品-商品语义关系。在三个基准数据集上进行的大量实验表明,我们提出的方法优于最先进的方法。

6. (Short Paper) Socially-aware Dual Contrastive Learning for Cold-Start Recommendation

论文链接:

https://dl.acm.org/doi/pdf/10.1145/3477495.3531780

论文机构: 新南威尔士大学、西工大

论文分类: 对比学习、冷启动

论文总结: 使用图神经网络 (GNN) 的社交推荐通过将用户-用户社交关系与用户-项目交互融合来学习表示冷启动用户,从而缓解与推荐系统相关的冷启动问题。尽管很好地适应了社交关系和用户-项目交互,但这些监督模型仍然容易受到流行度偏差的影响。对比学习通过识别区分正样本和负样本的属性来帮助解决这一难题,但是在其与推荐系统的组合中,未考虑此上下文中的社交关系和冷启动案例。此外,他们主要关注用户和物品之间的协作功能,而没有充分利用物品之间的相似性。在这项工作中,我们提出了用于冷启动推荐的社交感知双对比学习,其中冷启动用户可以以与热用户相同的方式建模。

为了充分利用社交关系,我们通过根据每个不同的查询项目以用户项目对的形式聚合来自不同邻居的信息,为每个用户创建动态节点嵌入。我们进一步设计了一个双分支自监督对比目标,以分别考虑用户-项目协作特征和项目-项目互信息。一方面,我们的框架在对比学习中通过适当的负采样消除了流行度偏差,而无需额外的真实监督。另一方面,我们扩展了以前的对比学习方法,为包含社交关系的冷启动问题提供解决方案。对两个真实世界社交推荐数据集的广泛实验证明了它的有效性。

7. (Short Paper) Improving Micro-video Recommendation via Contrastive Multiple Interests

论文链接:

https://dl.acm.org/doi/pdf/10.1145/3477495.3531861

论文机构: 国科大、新加坡MX Media

论文分类: 对比学习、多兴趣、微视频推荐

论文总结: 随着微视频创作者和观看者的快速增长,如何从大量的候选人中向观看者进行个性化推荐开始受到越来越多的关注。然而,现有的微视频推荐模型依赖于昂贵的多模态信息,并且学习了无法反映用户对微视频的多种兴趣的整体兴趣嵌入。最近,对比学习为改进现有推荐技术提供了新的机会。因此,在本文中,我们提出提取对比多兴趣并设计微视频推荐模型 CMI。具体来说,CMI 从每个用户的历史交互序列中学习多个兴趣嵌入,其中隐式正交微视频类别用于解耦多个用户兴趣。此外,它建立了对比多兴趣损失,以提高兴趣嵌入的鲁棒性和推荐的性能。在两个微视频数据集上的实验结果表明,CMI 在现有基线上实现了最佳性能。

8. (Short Paper) Multi-modal Graph Contrastive Learning for Micro-video Recommendation

论文链接:

https://dl.acm.org/doi/pdf/10.1145/3477495.3532027

论文机构: 格拉斯哥大学

论文分类: (图) 对比学习、多模态、微视频推荐

论文总结: 最近,微视频在 TikTok 和 Instagram 等社交媒体平台上变得越来越流行。事实上,这样的多媒体内容可以涉及多种模式,通常表示为推荐模型的视觉、听觉和文本特征。现有的微视频推荐工作倾向于统一多模态通道,从而将每个模态同等重视。然而,我们认为这些方法不足以对具有多种模态的项目表示进行编码,因为所使用的方法不能完全解耦用户对不同模态的喜好。为了解决这个问题,我们提出了一种新的学习方法,称为多模态图对比学习(Multi-Modal Graph Contrastive Learning,MMGCL),旨在以自监督学习的方式显式增强多模态表示学习。特别是,我们设计了两种增强技术来生成用户/项目的多个视图:模态边丢弃和模态掩码 (modality edge dropout and modality masking)。此外,我们引入了一种新颖的负采样技术,该技术允许学习模态之间的相关性并确保每种模态的有效贡献。在两个微视频数据集上进行的大量实验证明了我们提出的 MMGCL 方法在推荐性能和训练收敛速度方面优于现有的最先进方法。

9. (Short Paper) An MLP-based Algorithm for Efficient Contrastive Graph Recommendations

论文链接:

https://dl.acm.org/doi/pdf/10.1145/3477495.3531874

论文机构: 格拉斯哥大学

论文分类: 对比学习、图网络

论文总结: 基于图的推荐系统通过使用图神经网络 (GNN) 结合用户-项目二部图,取得了可喜的性能。在基于图的推荐系统中,来自每个用户和项目的多跳邻居的信息通过邻域聚合和消息传递在节点之间有效地传递。尽管有效,但现有的邻域信息聚合和传递函数通常在计算上很昂贵。受新兴对比学习技术的启发,我们设计了一种简单的邻域构建方法,结合对比目标函数来模拟 GNN 的邻域信息处理。此外,我们提出了一种基于多层感知机 (MLP) 的简单算法,用于学习具有额外非线性的用户和项目的表示,同时与多层 GNN 相比降低了计算负担。我们在三个公共数据集上进行的大量实证实验表明,我们提出的模型,即 MLPCGRec,可以将 GPU 内存消耗和训练时间分别减少高达 24.0% 和 33.1%,与竞争基线相比,推荐准确度不会显著下降。

10. (Short Paper) Towards Personalized Bundle Creative Generation with Contrastive Non-Autoregressive Decoding

论文链接:

https://dl.acm.org/doi/pdf/10.1145/3477495.3531909

论文机构: 阿里

论文分类: 对比学习、捆绑生成

论文总结: 当前的捆绑生成研究侧重于生成项目组合以改善用户体验。在现实世界的应用中,也非常需要制作由混合类型的对象(例如项目、标语和模板)组成的捆绑广告,以获得更好的推广效果。我们研究了一个名为捆绑创意生成的新问题:对于给定的用户,目标是生成用户会感兴趣的个性化捆绑创意。为了兼顾质量和效率,我们提出了一个对比非自回归模型来捕获用户 具有巧妙解码目标的偏好。在大规模真实世界数据集上的实验验证了我们提出的模型在创意质量和生成速度方面显示出显着优势。

11. (Short Paper) Dual Contrastive Network for Sequential Recommendation

论文链接:

https://dl.acm.org/doi/pdf/10.1145/3477495.3531918

论文机构: 清华

论文分类: 序列推荐、对比学习

论文总结: 序列推荐通过用户的历史项目序列预测给定用户的下一个交互项目。然而,序列推荐与大多数推荐系统一样存在数据稀疏问题。为了从数据中提取辅助信号,最近的一些工作利用自监督学习通过 dropout 策略生成增强数据,但这会导致序列数据稀疏和信号模糊。在本文中,我们提出了双对比网络 (Dual Contrastive Network,DCN)来提升序列推荐,从整合辅助用户序列的项目的新角度。具体来说,我们提出了两种对比学习: 第一个是双重表示对比学习,它最小化嵌入和用户/项目的序列表示之间的距离;第二种是双兴趣对比学习,旨在通过辅助训练对静态兴趣和下一个项目预测的动态兴趣进行自监督。我们还结合了为给定项目的历史用户序列预测下一个用户的辅助任务,它可以捕捉某些类型用户偏好的项目的趋势。在基准数据集上的实验验证了我们提出的方法的有效性,进一步的消融研究还说明了所提出的组件对不同序列模型的促进作用。

[1] SIGIR2022 | SimGCL: 面向推荐系统的极简图对比学习方法

[2] SIGIR 2022 | 港大、武大提出KGCL:基于知识图谱对比学习的推荐系统

欢迎干货投稿 \ 论文宣传 \ 合作交流

推荐阅读

由于公众号试行乱序推送,您可能不再准时收到机器学习与推荐算法的推送。为了第一时间收到本号的干货内容, 请将本号设为星标,以及常点文末右下角的“在看”。

由于公众号试行乱序推送,您可能不再准时收到机器学习与推荐算法的推送。为了第一时间收到本号的干货内容, 请将本号设为星标,以及常点文末右下角的“在看”。