因果推理是人类智能中至关重要的认知能力,它使我们能够将过去的学习经验推广到解决当前问题。不幸的是,尽管过去十年间机器学习通过在大量数据上训练强大的深度神经网络(DNN)获得了繁荣,但它仍然缺乏像我们人类一样的泛化能力。受到因果性在人类泛化中重要作用的启发,我们对机器泛化采取了一个因果视角。我们发现,训练数据中的假性相关是阻碍泛化的混淆因素,只有通过因果干预才能消除。在这篇论文中,我们研究了三种类别的因果干预,并为改善泛化贡献了实际的实现方法:1)后门调整;2)不变性学习;3)学习解耦表征。所提出的实际实现方法通过标准基准进行了广泛评估,并在小样本学习、无监督域适应、半监督学习、零样本学习、开集识别和无监督表征学习中展示了最先进的泛化性能。

因果推理是人类智能中的一个基本认知能力,它使我们能够将过去的学习经验推广到解决当前问题。遗憾的是,尽管过去十年中机器学习通过在大量数据上训练强大的深度神经网络(DNN)取得了长足发展,但它仍然缺乏像人类那样的泛化能力,在部署环境与训练环境不同时表现欠佳。

受到因果性在人类泛化中重要作用的启发,我们通过引入经典的因果表征学习概念,对机器泛化进行了因果视角的探讨:每个数据样本都是由其类别身份的因果特征 c 和类别不变的环境特征 e 生成的。然而,由于实际数据中普遍存在的偏见,训练数据中 c 和 e 之间的假性相关是不可避免的(例如,“鸟”c 通常在“天空”e 中)。这使得训练数据成为了一个混淆因素。因此,传统的最大似然目标(例如,交叉熵损失)引入了混淆效应,其中训练模型不加选择地利用这种相关性进行预测(例如,将任何在“天空”中的样本分类为“鸟”)。当在部署时这种相关性不再成立时,这种混淆的模型泛化性能较差。

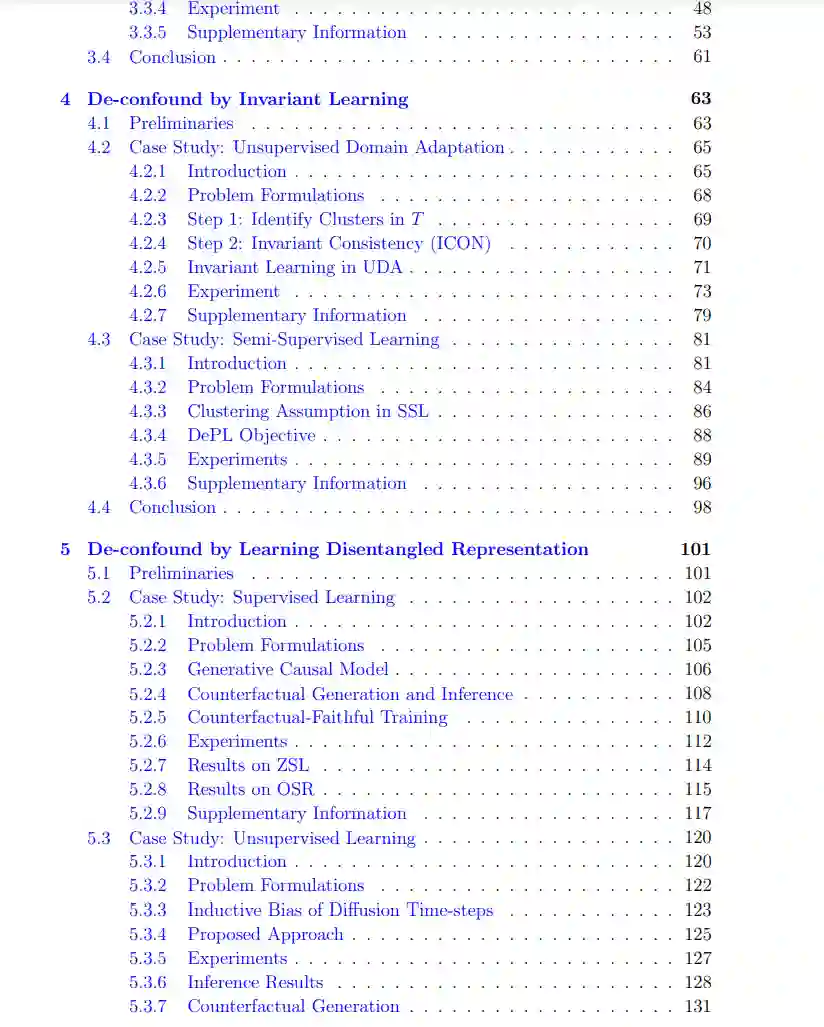

为了解决这个问题,理论上已经证明,只有通过因果干预才能消除混淆效应,这种干预追求的是从 c 到类别身份的因果效应。在这篇论文中,我们研究了三种类别的因果干预,并贡献了实际的实现方法以改善泛化能力:

后门调整假设我们可以观察并分层混淆因素,但在现实世界的机器学习任务中这是难以捉摸的。我们基于预训练DNN的两个固有属性:特征通道和预训练分类器,设计了一个混淆因素分层的近似方法,并在小样本学习设置中进行了案例研究。此外,我们提出了一种无监督方法,通过解耦独立的因果机制来识别混淆因素的层次,并成功地将其应用于无监督域适应(UDA)设置中。

不变性学习基于多个不相交的环境,其中 c 和 e 之间的假性相关性不同。通过这种方式,寻求一个在所有环境中都同时最优的不变分类器可证明地捕获因果效应。我们展示了在UDA和半监督学习中的标记数据和未标记数据自然形成了这样的环境。因此,我们学习了一个与标记数据一致且能够聚类未标记数据的不变分类器,消除了混淆偏见。

解耦表征。实现因果干预的另一种方法是将 c 和 e 学习为两个不相交的模块化特征(即,解耦表征),因此分类器可以仅使用 c 进行预测以捕获因果效应。首先,我们考虑了在零样本学习和开集识别中的监督特征解耦,其中 c 在训练数据中被标记,我们设计了一个逆向推理算法来利用解耦特征。然后,我们放宽了对标记 c 的需求,通过预训练的去噪扩散概率模型的归纳偏置,探索了无监督解耦。

所提出的实际实现方法通过标准基准进行了广泛评估,并在小样本学习、无监督域适应、半监督学习、零样本学习、开集识别和无监督表征学习中展示了最先进的泛化性能。