** ****新智元报道 **

编辑:编辑部**【新智元导读】万众瞩目的WWDC24上,苹果果然用AI把iPhone全部重塑。重磅登场的Apple Intelligence,让苹果全系产品有了史诗级升级。Siri被全面重塑,自由穿梭于系统中。AI大牛Karpathy对此狂赞,然而马斯克却彻底怒了,下令全员禁用苹果!**

苹果说到做到,一夜间,iPhone果然被AI重塑! 长达一个半小时的WWDC大会,主题就是AI、AI、AI—— 从iPhone、iPad到Mac,无不被生成式AI覆盖。横空出世的Apple Intelligence,让苹果全系产品有了史诗级升级。 现在的整个苹果全家桶,都会用上GPT-4o,Siri还能随时召唤ChatGPT。硅谷各家大科技公司的大模型发展得如火如荼,苹果能做什么?库克的这句话揭示了答案——「LLM等AI突破,让我们有机会把苹果产品的体验推向新的高度」。你们做模型,我们做产品,的确是苹果一贯擅长的赛道。

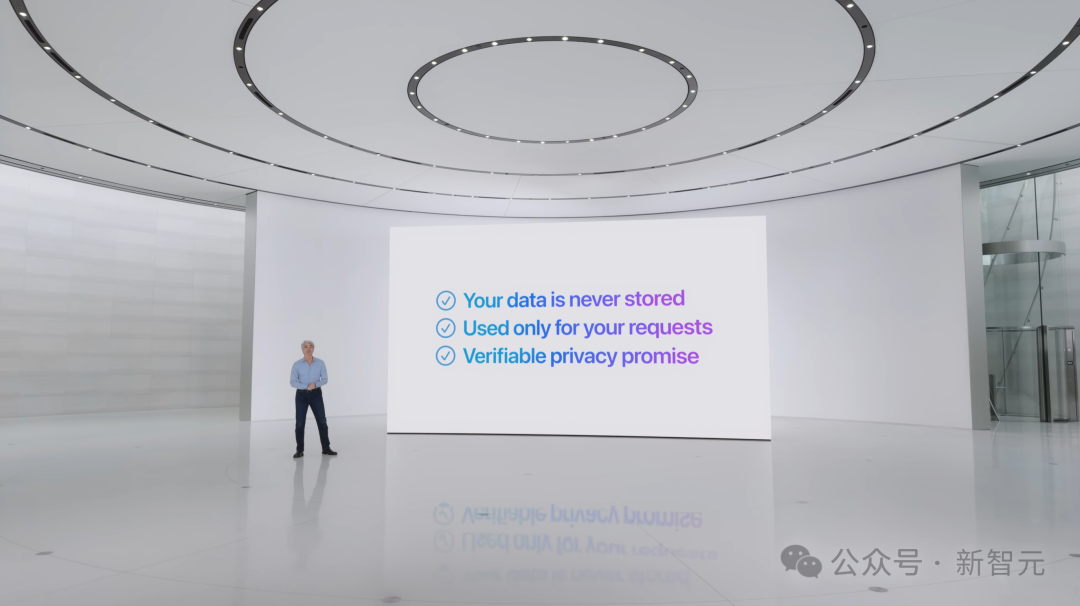

而且,对于大家普遍担忧的安全问题,苹果也有解:通过苹果强大的自研芯片,普通大模型在设备端运行,太大的大模型就放到云端。而苹果专门打造的私密云计算技术,也保障了我们的隐私和安全,我们的数据就连苹果都无法访问。被Apple Intelligence加持的Siri,也彻底改头换面,全面逼近苹果让它「自由穿梭于系统中,随时听我们调遣」的愿景。

此外,除了Vision OS的重大更新之外,库克的这个消息也让中国用户激动不已:Vision Pro将于6月28日登录中国市场,本周五开始接受预定,价格29999元起!

网友:苹果AI满足了我的所有想象

有中国网友评论说:太牛了,Apple Intelligence真的满足了自己对AI在设备上的所有想象,不愧是苹果。

以前是Artifical Intelligence,如今就是Apple Intelligence了。 对于iPadOS 18的数学笔记功能,很多人都表示这太狂野了!

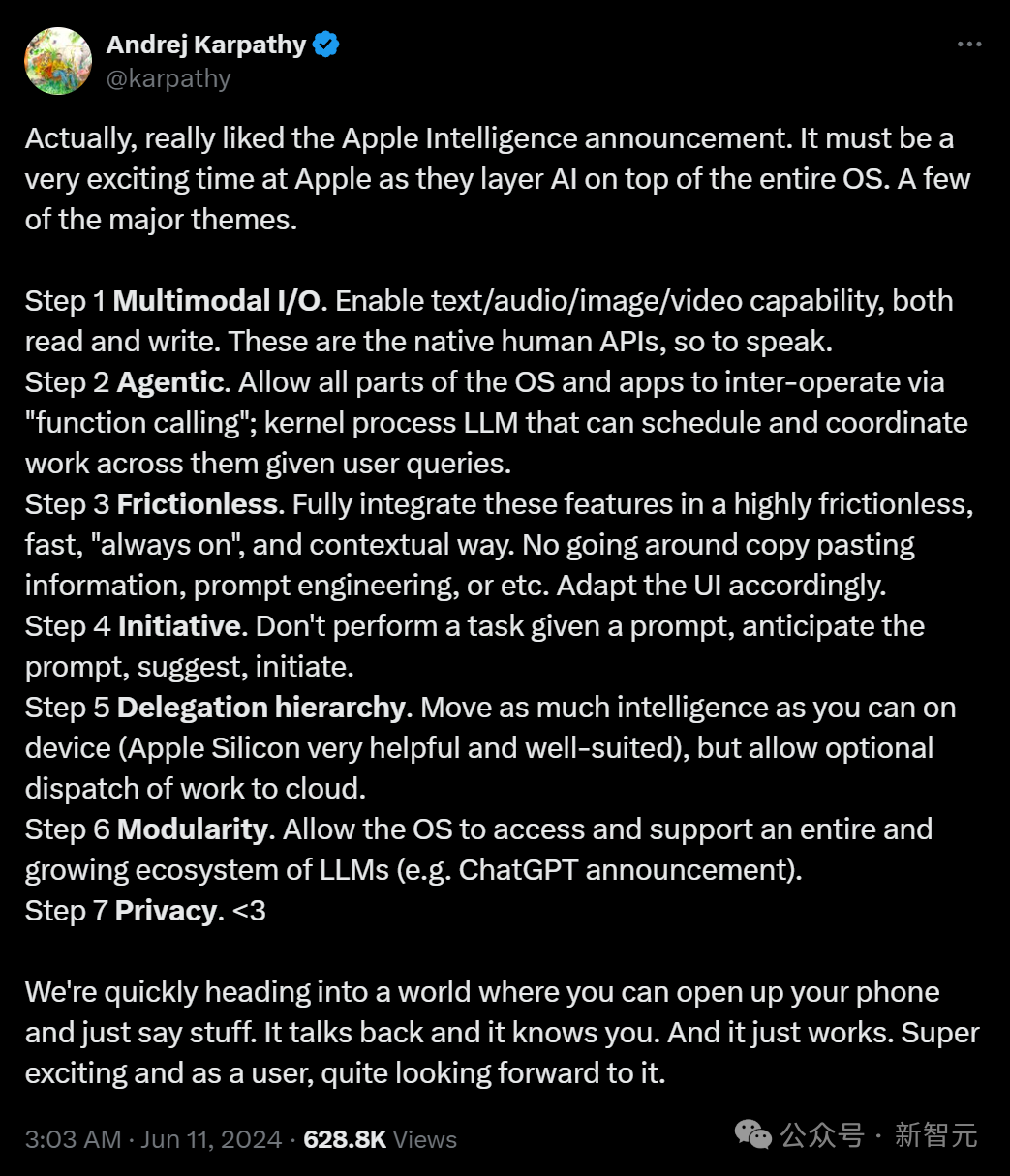

OpenAI创始成员,AI大牛Karpathy对于苹果的这次更新也称赞不已:「我们正在进入一个打开手机就可以说话的世界。它可以和你对话,而且它认识你。这实在太令人兴奋了!」

Apple Intelligence:不仅个人化,而且懂你

苹果的目标,就是为全球10亿用户构建强大的个人化产品。而近期生成式AI和LLM的发展,直接给苹果产品使用体验的全新升级带来了可能。苹果对于产品的核心原则是: 足够强大,在最要紧的事上都能帮到用户;直观易用;深度整合到产品的使用体验中;它必须足够「懂你」,以你的个人情境为基础;而且,还要注重保护隐私。如果这些原则都能满足,那它绝不仅仅是AI了,而是一种「个人化智能」。而符合全部这些条件的Apple Intelligence,就在昨晚闪亮登场了

能力

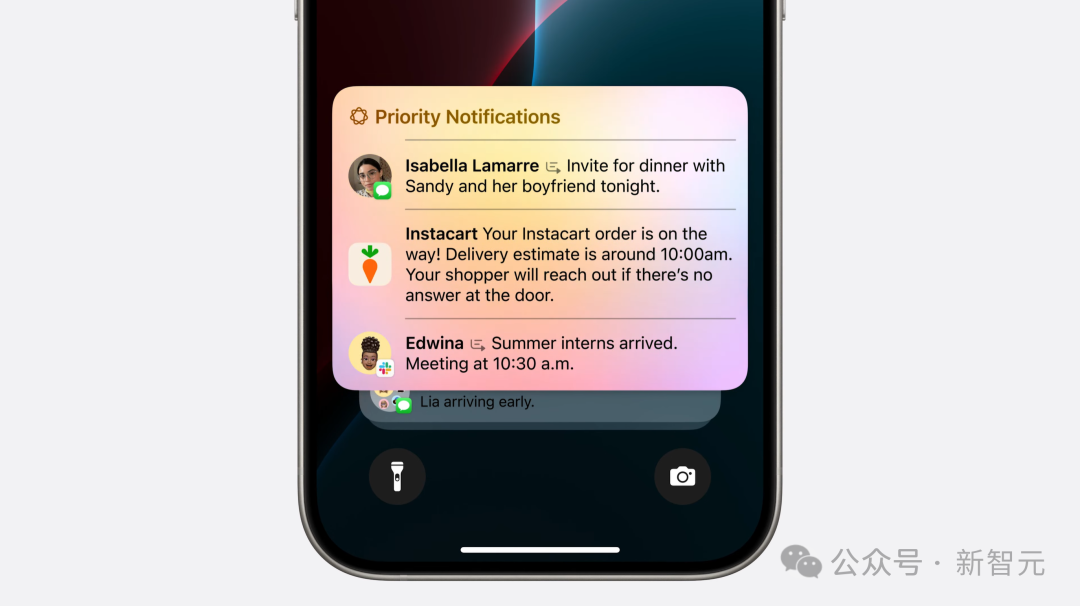

Apple Intelligence,可以让我们的iPhone、iPad和Mac理解、生成语言和图像,还能代替我们跨多个app交互,简化操作过程。它最亮眼的地方,就在于理解我们的「个人情境」。自然语言Apple Intelligence中内置的LLM,能深刻理解自然语言。比如,iPhone可以为通知设定优先次序,从而为我们减少不必要的干扰,同时又能不错过重要的信息。

更让人惊喜的是,这些功能在系统中所有app都可用,包括Notes,Freeform,Keynote,Pages等等。

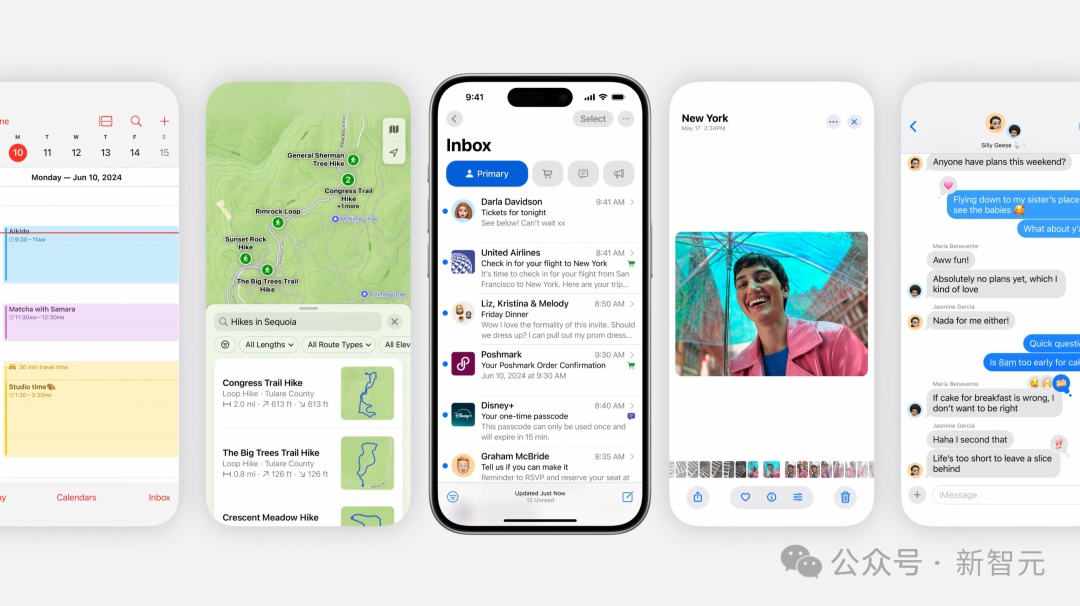

跨app操作Apple Intelligence的另一个特点,就是还能跨app操作,这无疑会带来深远的影响。它所需工具的各种资源,就在我们自己的口袋中——这些常用的app里。苹果设计的Apple Intelligence,能随时取用这些工具,代我们执行各种操作。

我们可以直接向它开口:「调出上周Joz发给我的文件」,或者「给我看看所有妈妈、Olivia和我的照片」「播放前几天我太太发给我的播客」等等。Apple Intelligence,会实现数百种此类操作。

架构

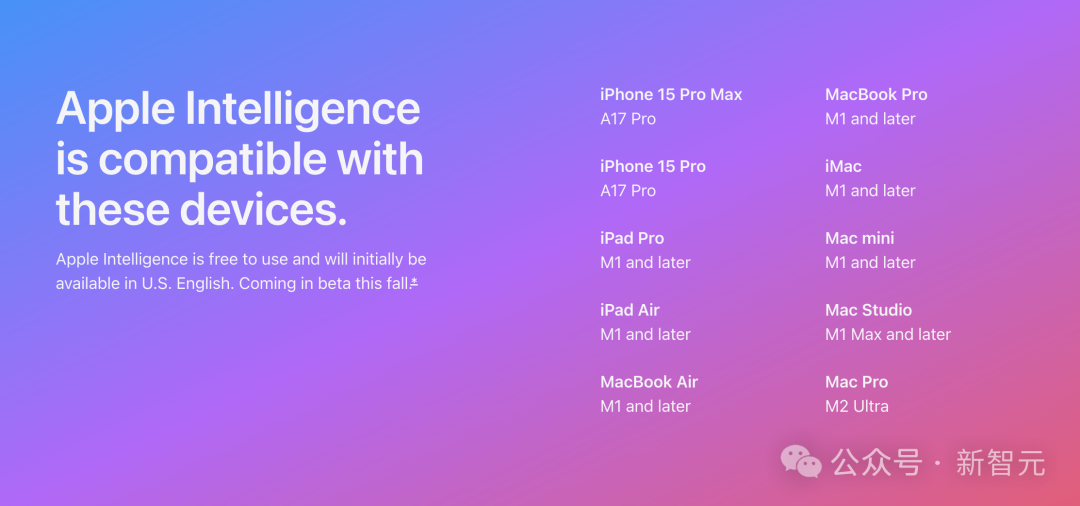

这个个人化智能系统的基石,就是设备端处理。要实现这项功能,就离不开苹果软硬件整合,以及强大的芯片。提供支持的芯片,包括A17 Pro,以及M系列芯片,它们为Apple Intelligence提供了坚实的算力基础。

体验

Apple Intelligence强大的语言理解功能将落地为写作助手(Writing Tool)。作为操作系统的内置AI,写作助手不仅可以用在手机自带的短信或邮件中,也同样支持所有需要输入的第三方应用。邮件中有了自带的校对功能,可以一键查看修改建议,并能直接看到所有词语的释义。写邮件时,再也不需要一遍遍复制粘贴到其他应用的界面了,苹果一夜之间就抢了Grammarly的看家生意。 不仅是文本校对,Writing Tool也同样提供多样化的改写功能。它可以同时在文中生成多个改写版本供你选择,也能随时回滚到原始版。

此外,用户还能和Writing Tool进行个性化交互,定制自己的改写需求,比如改变文体、文风、语气等等。想要发一封有文采的邀请函?Writing Tool可以瞬间帮你把现有的平常文字改写成一首诗。

Siri

13年前,Siri首次问世,作为曾经首屈一指的智能语音助手曾经掀起巨大热度。如今,繁忙的Siri每天需要处理15亿次语音请求。而它离苹果「自由穿梭于系统中,随时听我们调遣」的愿景,也更近了一步!在Apple Intelligence的加持下,Siri变得更自然、更贴合语境了,因此也变得更加贴合我们。如今当我们和Siri对话时,它和系统的整合会更深入。当它运行时,优雅的光晕会环绕着屏幕边缘。

即使我们在提问中停顿,思考一番,Siri依然能跟上我们。在对话中,Siri还能联系上下文。比如我们接着上面说「创建日历日程,明天上午9点去那里徒步」,它立马正确地理解「那里」指的是哪里,完成了指令。

如果我们不想跟Siri大声说话,现在可以直接给它打字了。只要在屏幕下方快速轻点两下,就能让Siri快速设好闹钟,整个过程悄无声息。跟Siri交流的过程中,我们可以在文字和语音中随时切换。而且,现在Siri掌握了大量关于功能和设置的信息,能回答数千个问题,关于如何在iPad或Mac上进行操作。

即使我们不知道某项功能的确切名称,只需要口头描述一番,Siri就能帮我们找到了!比如直接问它:「我想现在就写好信息,然后明天发送,该怎么做?」Siri完全明白我们说的是哪个功能,还提供了分步说明。

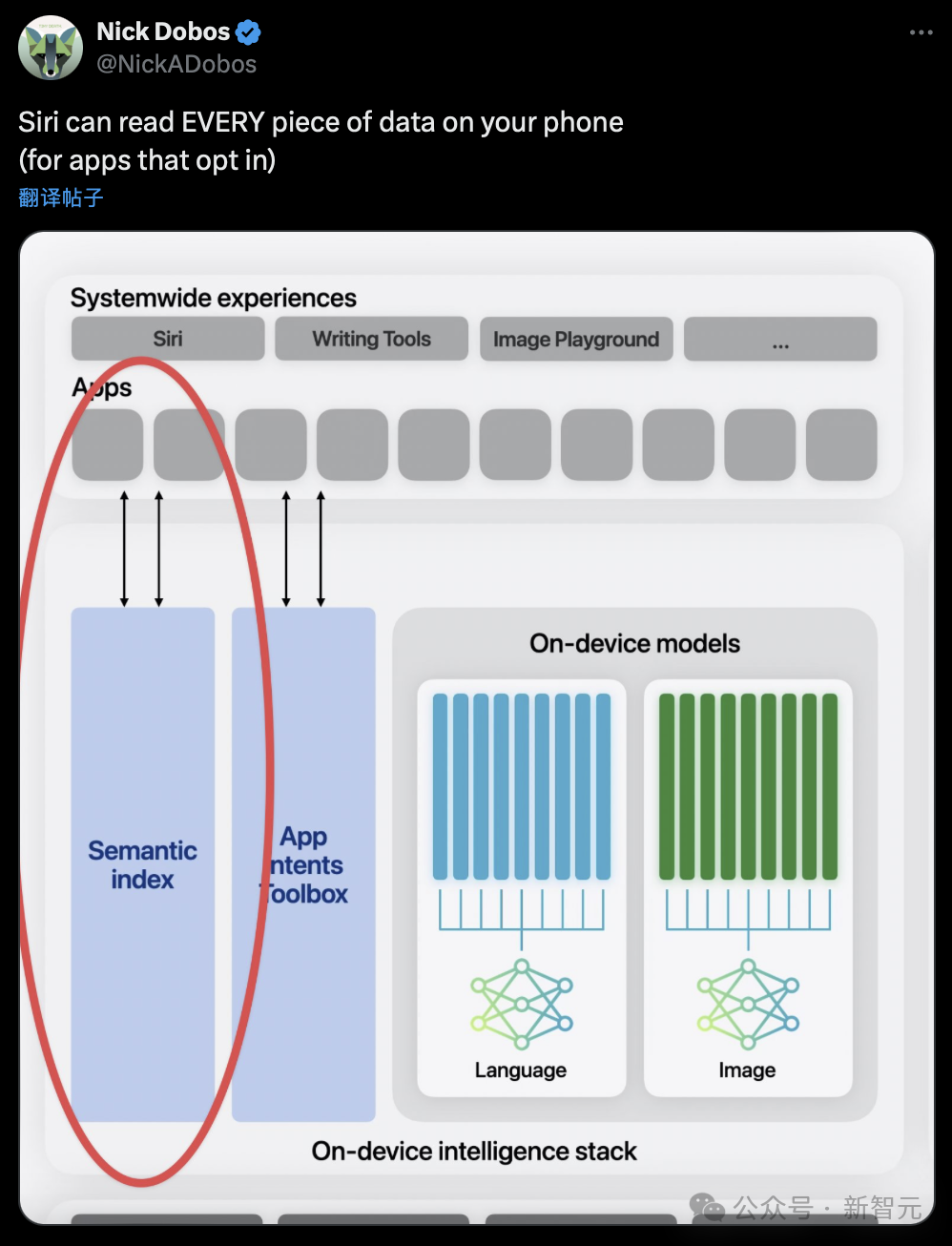

Apple Intelligence还会为Siri带来屏幕内容感知功能,这样,它就能理解屏幕上的内容,执行相应的操作。比如朋友发消息告诉你ta的新地址,你可以直接在信息对话中说,「把这个地址加入ta的联系人名片中」。

当然,Siri也可以完成跨app操作。比如我们可以说:「让我看看Stacey在纽约穿着粉色大衣的照片」,Siri就会把它们找出来,然后还能按照我们的指令开始修图。

然后,我们还可以让Siri把这张照片加到备忘录中Stacey的简介里,它就会从照片app跳转到备忘录app中,来完成操作。这些增强功能,也并不限于苹果开发的APP。比如,我们可以让Siri用Moment的Pro Camera,来拍摄光轨的视频。

假如我们打算去机场接妈妈,Siri能直接帮我们规划时间。它能同时参考妈妈在邮件里写的航班详情,以及航班的实时动态,为我们提供最新的到达时间。而在和妈妈的闲聊中,她提到过中午订了餐厅,我们就可以直接问Siri去那家餐厅需要多久,完全不必在邮件、信息和地图中跳来跳去了!如苹果所说,今年将成为Siri新纪元的起点。 苹果「全家桶」用上GPT-4o

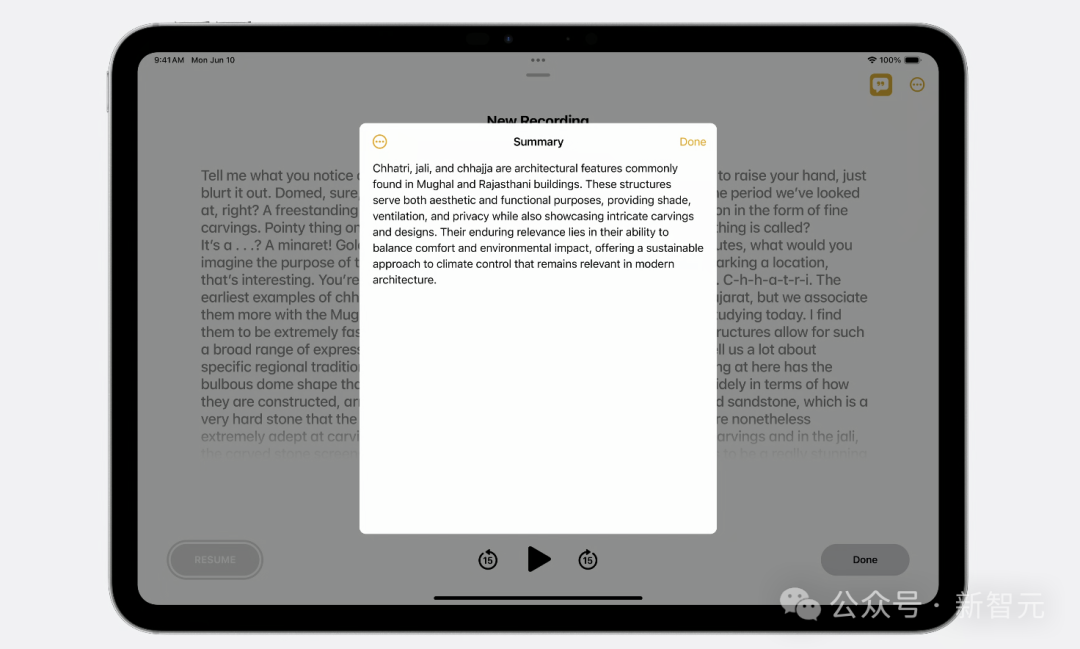

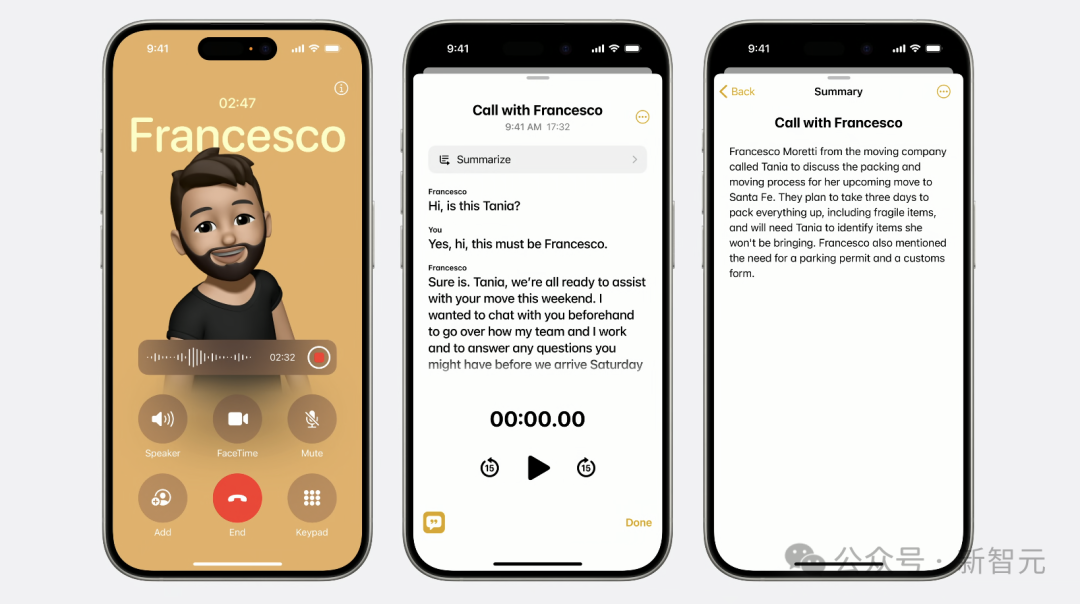

以上所展示的苹果AI能力,仅是一个「起点」。它能够以极为独特的方式理解你、尊重你、支持你。未来,苹果还将带来超多的实用功能,比如备忘录中的录音和转写功能。 它能够帮你更详细地记下笔记,专心听讲,完全可以替代GoodNotes、Notability这类的学习工具。录音/转写完成后,苹果AI还能帮你总结摘要,扫一眼便能抓住要点。

Siri召唤ChatGPT

对于一些非常有用的外部AI工具,比如擅长处理某些需要广博知识,或者专业特长的任务,苹果直接将其模型纳入体验之中,而无需来回切换工具。当然,这个工具就是行业的翘楚、市场的开拓者和领头羊—— ChatGPT。苹果AI将用上全新的GPT-4o能力。首先,Siri可以借助ChatGPT的专长,随时为我们所用。比如,你想用刚钓的鱼,和自家种的菜为朋友准备一顿丰盛的大餐时,可以找Siri给些灵感。Siri便会问你,是否召唤ChatGPT,然后直接为你呈上最丰富的答案。 而且,问问题时,你还可以上传一张照片。比如,询问如何家装的建议,拍张照片然后问「这个露台种什么植物好看」?Siri会首先确认是否会向ChatGPT分享照片,然后才会为你找寻点子,整个过程完全就是一气呵成。

甚至,你还可以选中所有内容,让ChatGPT为其生成一副插画。

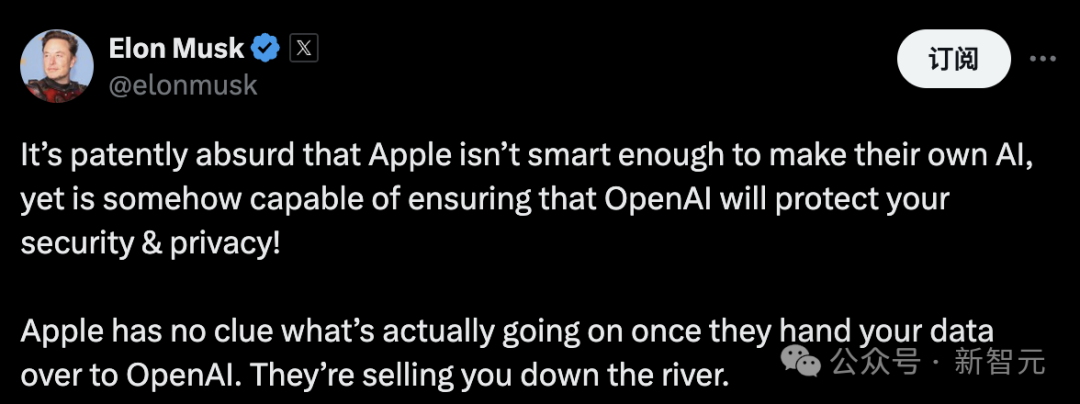

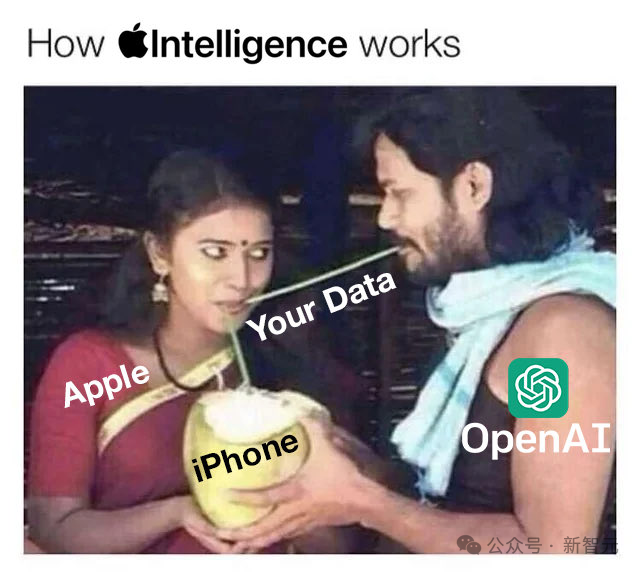

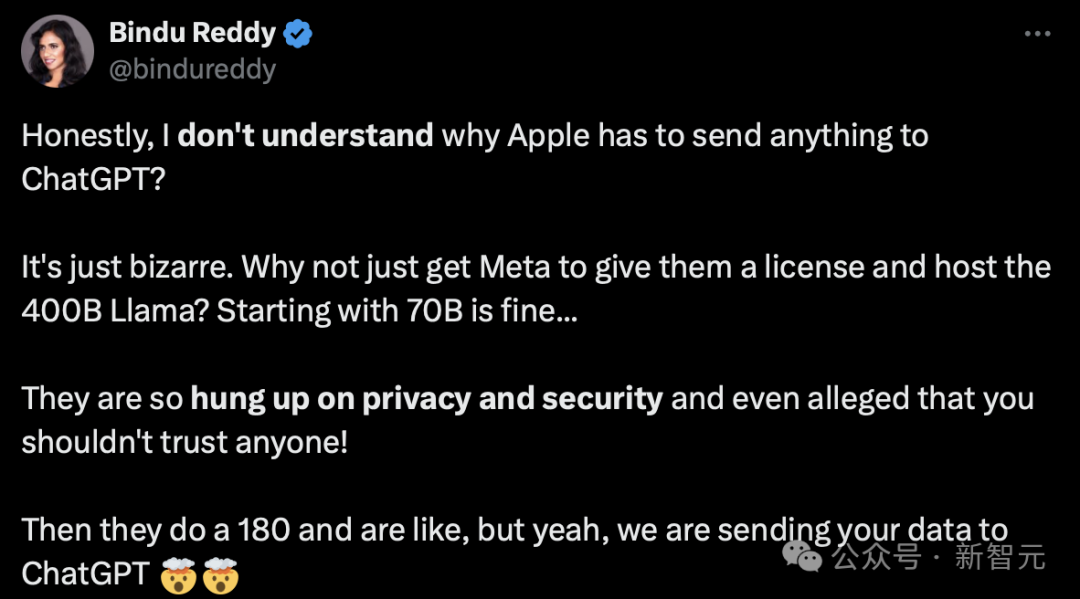

马老板怒了,禁止全员使用苹果

ChatGPT在苹果全家桶中无缝集成能力虽炫酷,却遭到的全网非议。最先反对的就是马老板!他连发多篇帖子,对ChatGPT上机苹果表示不满,甚至扬言禁止公司所有成员使用苹果的设备。 我不想要这个能力。这就如同间谍软件一般,如果你们不阻止,我的公司将禁止使用任何苹果设备。

另外,马斯克还单独发帖子称:「对于公司的外部来访者,都必须在门口将他们的设备放在「法拉第笼」(Faraday cage)中」。

还有人配上梗图讽刺道,「当奥特曼已耗尽100%互联网训练数据时,看到十亿部手机时」。

苹果AI背后模型训练过程揭秘

发布会之外,苹果还发布了一篇关于介绍苹果AI能力实现背后的基础模型的文章。

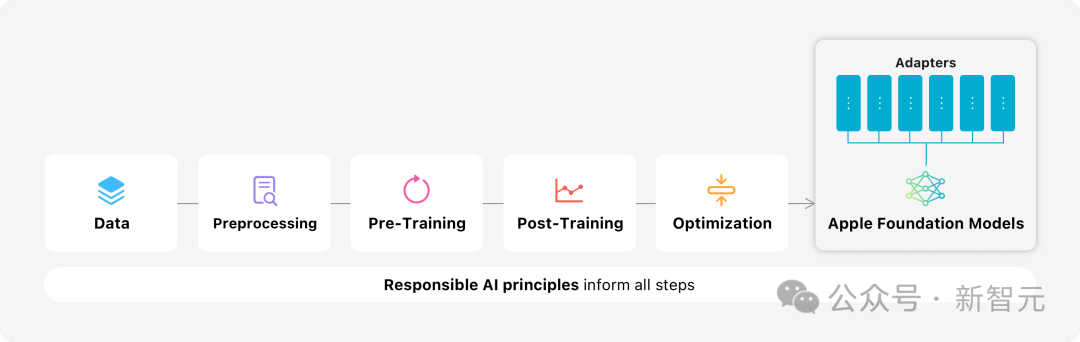

预训练

苹果的基础模型,是在2023年发布的开源项目AXLearn框架之上训练的。AXLearn建立在JAX和XLA之上,可以在各种训练硬件和云平台上高效、可扩展地训练模型,包括TPU和云端及本地GPU。另外,苹果研究团队还采用了数据并行、张量并行、序列并行和全分片数据并行(FSDP)等组合方式,从数据、模型和序列长度等多个维度来扩展训练规模。

后训练

苹果团队意识到,数据质量对于模型的成功,至关重要。因此,他们在训练过程中,采用了「混合数据策略」,即结合使用人工标注和AI生成数据,并进行了彻底的数据筛选和处理。具体来说,研究团队在模型「后训练」阶段,开发了两种全新的算法:(1) 拒绝抽样的微调算法,使用多个教师模型作为参考,对模型输出进行过过滤和微调(2) 人类反馈强化学习算法,结合使用了镜像下降策略优化,以及留一法优势估计器(leave-one-out advantage estimator)新技术。结果发现,这两种算法可以显著提升模型指令跟随的质量。

优化

另外,苹果还采用了一系列创新技术,在设备端和私有云上优化模型的速度和效率。他们对第一个token推理和扩展token推理的性能都进行了大量的优化。无论是设备端模型还是服务器端模型,都采用了「分组查询注意力机制」(grouped-query-attention)。苹果还使用了共享的输入和输出词表,以减少内存需求和推理成本。这些共享的嵌入张量在映射时不会产生重复。设备端模型的词表大小为49k token,而服务器端模型的词表大小为100k token。对于设备内推理,他们还是用了「低比特量化」(low-bit palletization)的技术,能满足所需的内存、功耗和性能要求。为了保持模型输出质量,研究团队开发了一种新框架——使用LoRA adapter,并采用了混合2位和4位的配置策略,平均每个权重占3.5位——从而达到与未压缩模型相同的精度水平。此外,他们还使用了一种名为「Talaria」模型,可以对模型的延迟和功耗进行交互式分析,更好地指导在不同操作中选择合适的量化精度。苹果基础模型还采用了激活值量化和嵌入量化技术,并且开发了一种在苹果神经网络引擎上高效更新键值缓存的方法。值得一提的是,通过以上优化,iPhone 15 Pro可实现每个提示token首次输出的延迟约为0.6毫秒,生成速率为每秒30个token。这一性能实现,并未采用token猜测技术,如若开启,速度将会更近一步提升。

模型自适应

苹果基础模型针对用户日常任务进行了微调,并且能够根据实时任务完成动态化适应。这一过程实现,是借助适配器,即一些可以插入到预训练模型各层的小型神经网络模块,对模型进行特定任务的微调。通过调整适配器中注意力相关的参数和前馈网络的参数,可以让整个LLM的行为专门化到特定任务上。

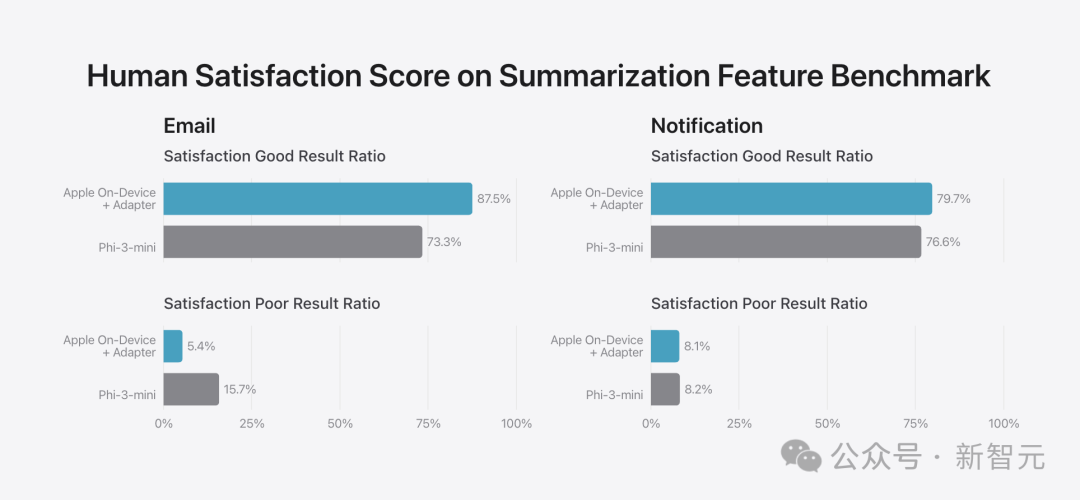

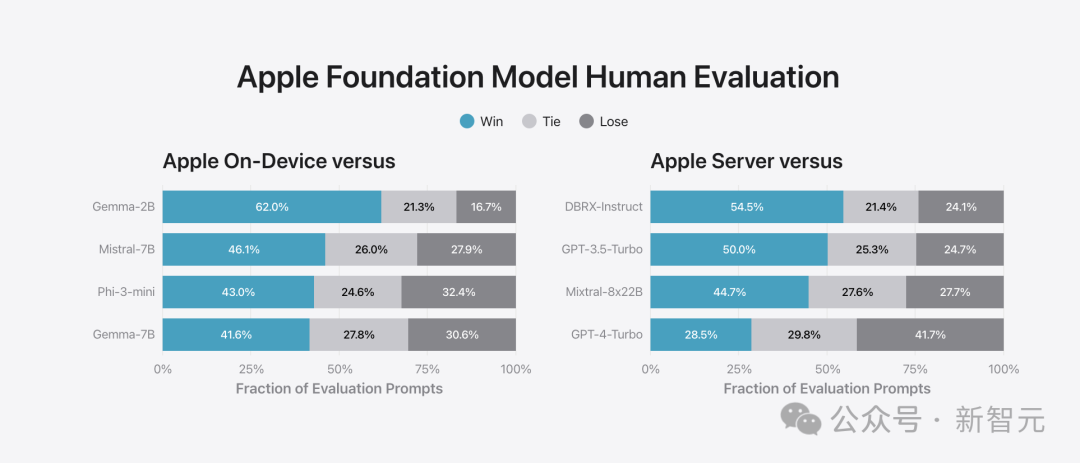

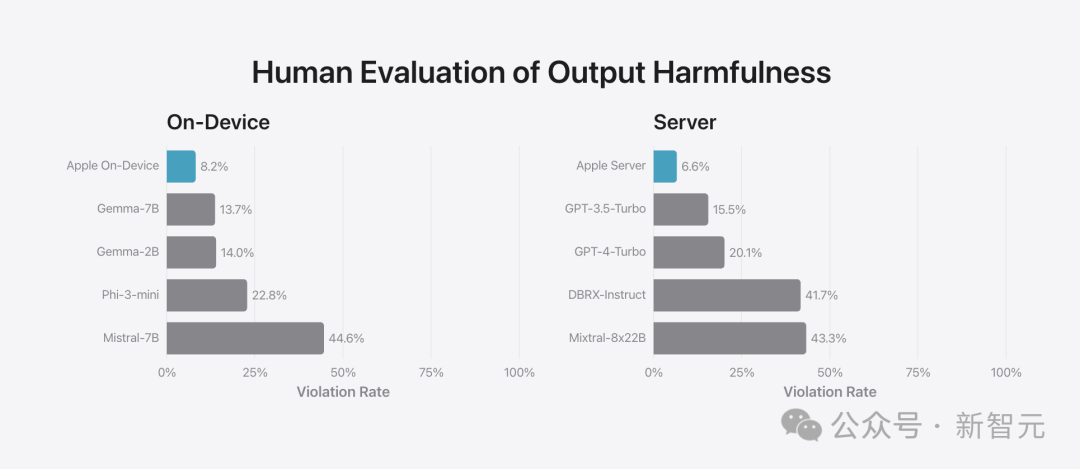

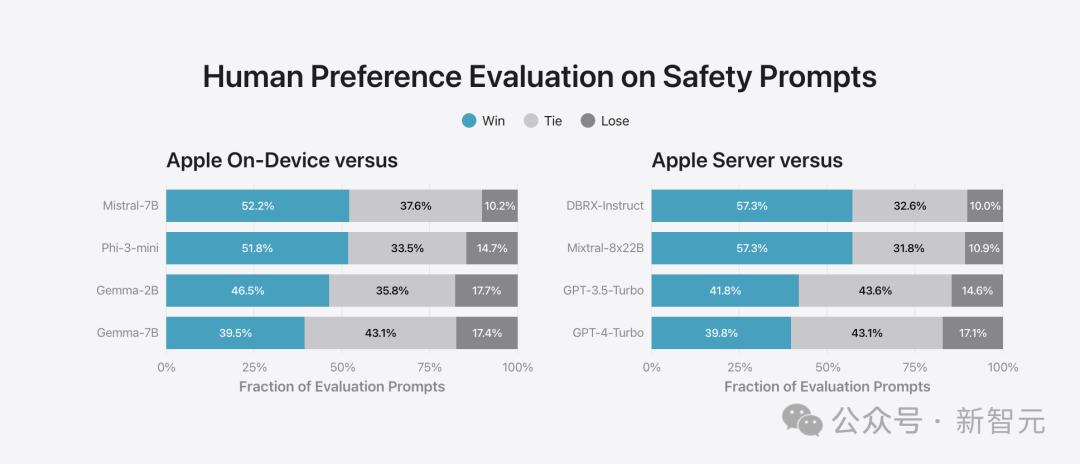

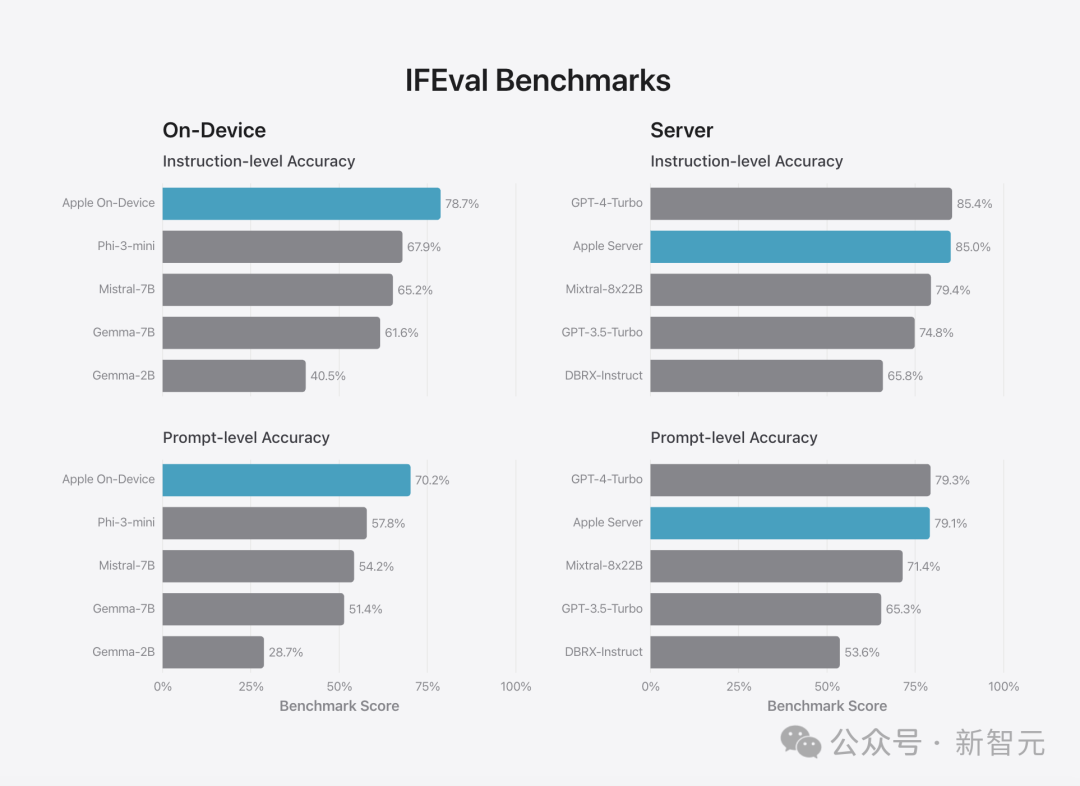

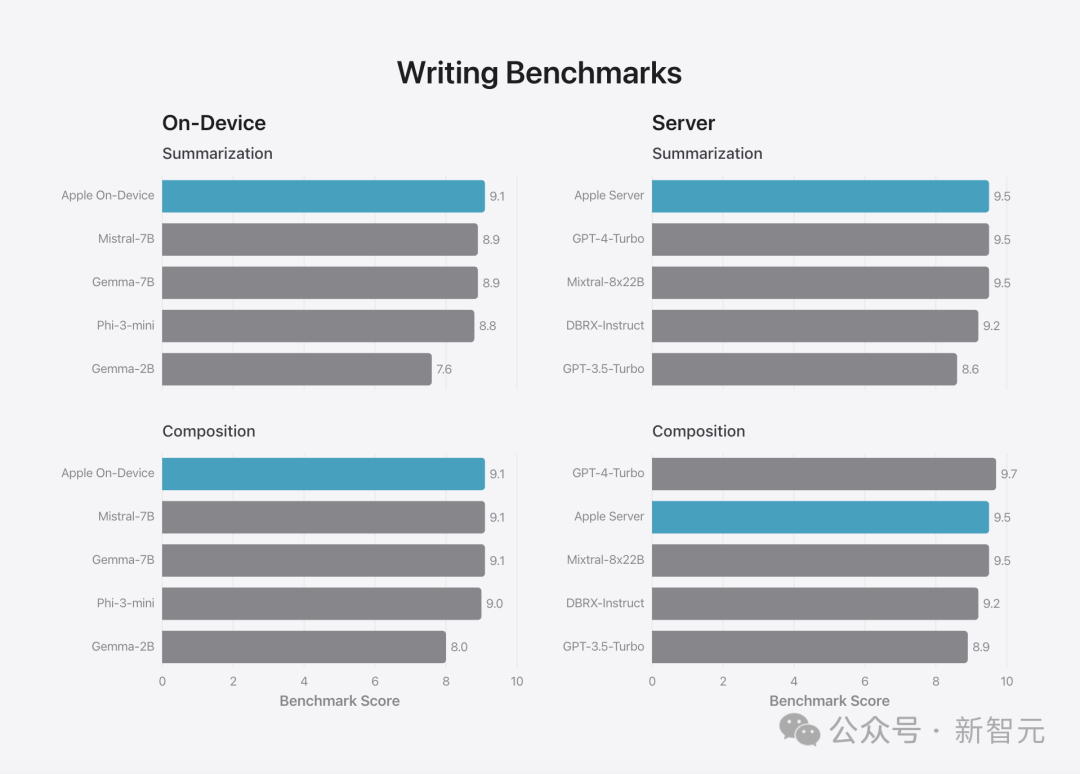

性能与评估

针对总结功能的评估中,苹果与微软Phi-3-mini小模型进行了对比。可以看得出,不论是在邮件、还是通知中,苹果设备端30亿参数的模型在「优秀」和「差」的生成中更占优势。

二代VisionOS更新,苹果头显月底登陆中国

据上次发布Vision Pro和Vision OS刚刚过去4个月,苹果就又在WWDC上宣布了Vision OS的重大更新。而且,还有让中国用户更加激动的消息——库克在发布会上正式官宣,Vision Pro 将于6月28日登陆中国市场,将于本周五(6月14日)开始接受预定,国行价格为29999元起。

之前的Vision Pro已经可以和Mac集成,苹果这次决定升级Vision中的虚拟屏幕,同时提高分辨率和屏幕宽度。今年的更新后,一个Vision Pro相当于电脑的两个4k外接屏幕,动态注视点技术让你无论从哪个角度看屏幕都无比清晰。

而且,这个虚拟屏可以随时打开,比如「旅行模式」可以让你在飞机上随时大屏追剧或私密办公。

- 3D空间内的多任务处理器Volumetric(可以说是Vision Pro上的Stage Manager)

- 让应用锚定在各种平面上的TableTopKit- Enterprise API让企业可以定制各种复杂应用

比如使用TableTopKit开发棋牌游戏,让棋盘锚定在桌面上,加上显示在空间中的FaceTime的头像,下棋的体验就更加沉浸式了。

去年Vision Pro发布了Apple Immersive Video,经过今年的再次更新,苹果始终萎靡不振的内容产业很可能要翻盘了。现在它的手里掌握着各路流媒体都不具有的空间影像技术。180度视角的8k视频加上高品质的音效,达到了甚至超越3D影院的逼真体验。

而且这次的发布非常垂直,打包了3D空间视频的全产业链。对于业余爱好者,拍摄可以用iPhone或与苹果合作的佳能相机,剪辑可以用Mac自带的Final Cut Pro,观看可以用Vision OS中的Vimeo。在专业创作领域,苹果和创意视频公司Black Magic Design合作,从摄像机到剪辑、后期软件全覆盖,今年晚些时候就会发布。

此外,苹果还和多方合作,制作原创的Apple Immersive Video并发布在Apple TV中。合作方在内容领域都是大名鼎鼎,包括顶级歌手The Weekend、奥斯卡奖导演Edward Berger,以及与红牛制作的极限运动系列。参考资料:https://developer.apple.com/videos/play/wwdc2024/101/https://machinelearning.apple.com/research/introducing-apple-foundation-models

比如使用TableTopKit开发棋牌游戏,让棋盘锚定在桌面上,加上显示在空间中的FaceTime的头像,下棋的体验就更加沉浸式了。

比如使用TableTopKit开发棋牌游戏,让棋盘锚定在桌面上,加上显示在空间中的FaceTime的头像,下棋的体验就更加沉浸式了。 此外,苹果还和多方合作,制作原创的Apple Immersive Video并发布在Apple TV中。合作方在内容领域都是大名鼎鼎,包括顶级歌手The Weekend、奥斯卡奖导演Edward Berger,以及与红牛制作的极限运动系列。参考资料:

此外,苹果还和多方合作,制作原创的Apple Immersive Video并发布在Apple TV中。合作方在内容领域都是大名鼎鼎,包括顶级歌手The Weekend、奥斯卡奖导演Edward Berger,以及与红牛制作的极限运动系列。参考资料: