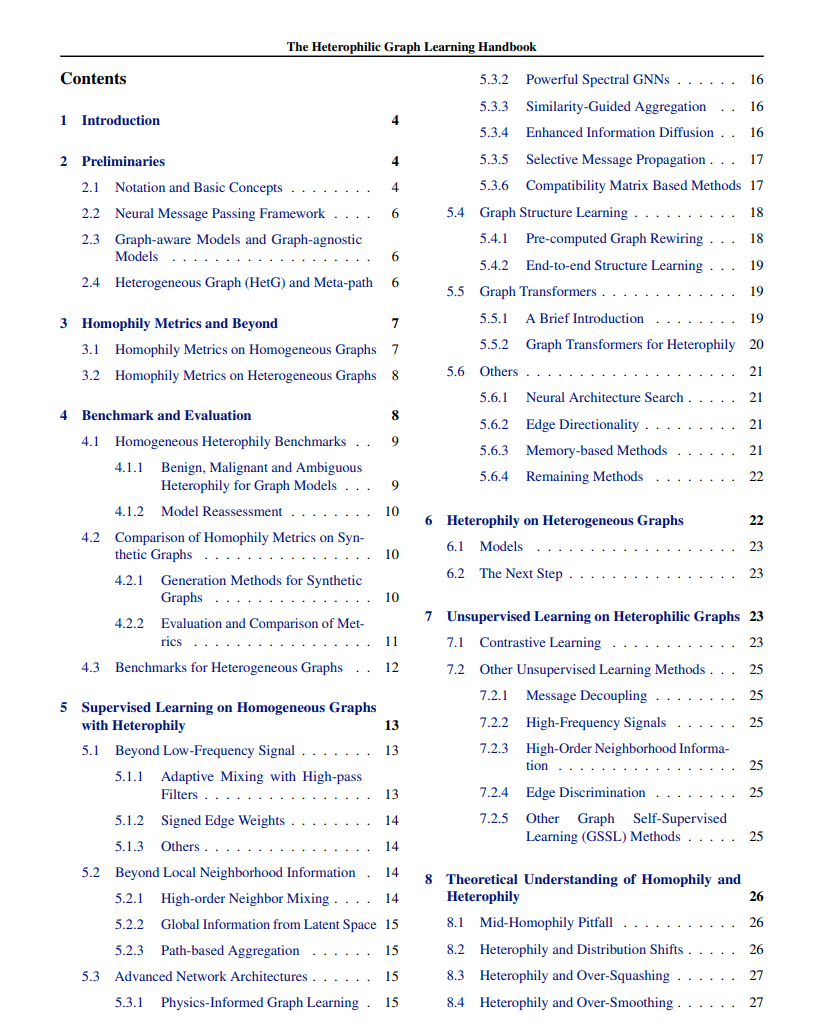

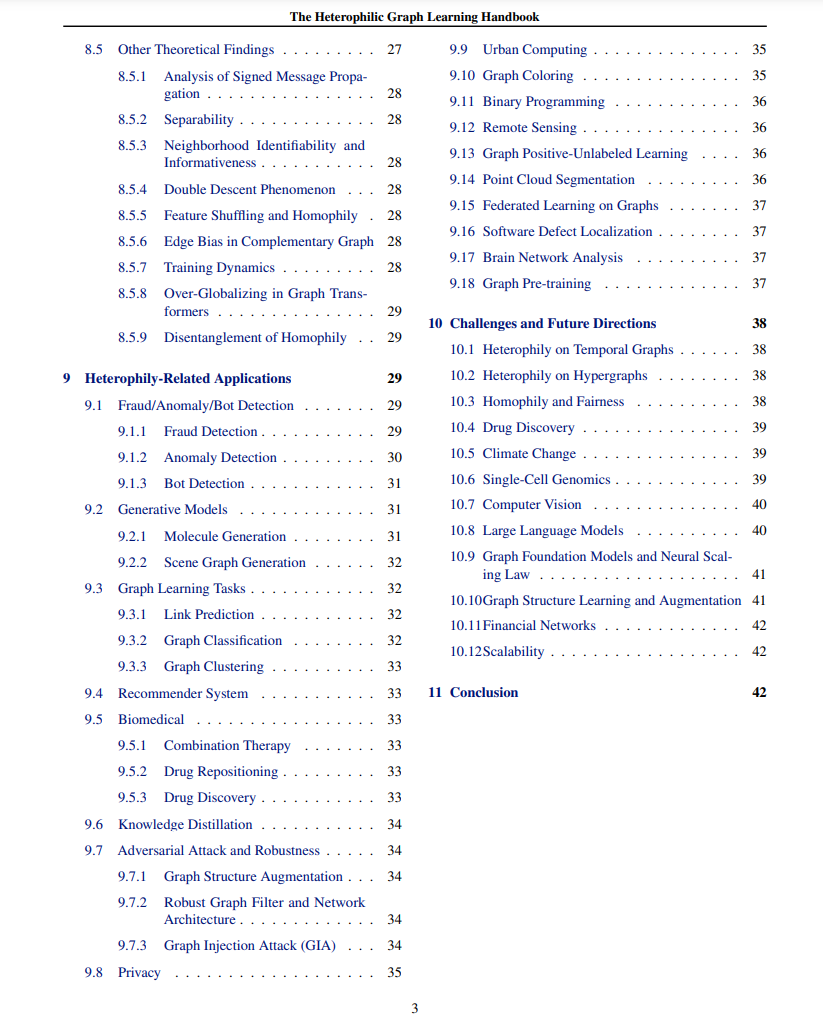

同质性原则,即具有相同标签或相似属性的节点更可能被连接,一直被认为是图神经网络(Graph Neural Networks,GNNs)在图结构数据上,尤其是在节点级任务上,相较于传统神经网络(Neural Networks,NNs)更具优势的主要原因。然而,最近的研究发现了一些数据集,在这些数据集中,GNN的表现相对于NN并不理想。异质性,即低同质性,被认为是这一经验观察的主要原因。人们已经开始重新审视和评估大多数现有的图模型,包括图转换器及其变体,在各种图中的异质性情景下的表现,如异构图、时间图和超图。此外,许多与图相关的应用被发现与异质性问题密切相关。在过去的几年里,已经有相当多的努力投入到研究和解决异质性问题上。

在本综述中,我们对异质图学习的最新进展进行了全面回顾,包括对基准数据集和合成图上的同质性指标的广泛总结,最新的有监督和无监督学习方法的细致分类,同质性/异质性的理论分析的深入消化,以及异质性相关应用的广泛探索。值得注意的是,通过详细的实验,我们首次将基准异质数据集分为三类:恶性、良性和模糊异质性。恶性和模糊数据集被识别为测试新模型在异质性挑战中有效性的真正挑战性数据集。最后,我们提出了异质图表示学习的几个挑战和未来方向。我们希望这篇论文能够成为你研究异质图表示学习的友好教程和百科全书。

作为一种通用的数据结构,图能够在许多现实世界的问题中建模对象之间的复杂关系。在过去的十年中,图神经网络(Graph Neural Networks,GNNs)作为一种强大的图机器学习工具,获得了广泛的关注。通过结合图信号处理和卷积神经网络,提出了各种GNN架构,并已被证明在关系数据和图结构数据的建模中优于传统神经网络。

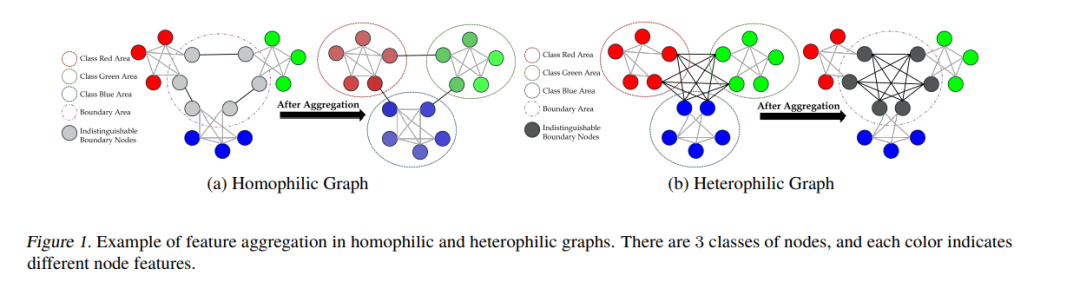

GNNs的成功,尤其是在节点级任务上的成功,通常被认为是基于同质性原则。同质性是社会学和进化生物学中的一个概念,指出具有相似特征的个体更容易相互交流和建立联系。在图表示学习中,它描述了连接的节点更可能具有相似标签或属性的网络。同质性结构为原始节点特征的聚合提供了额外的有用信息,这种关系归纳偏差被认为是GNNs在各种任务上优于传统NNs的主要原因。

另一方面,缺乏同质性,即异质性,被认为是GNNs在异质图上表现不佳的主要原因。由于异质性边连接了不同类别的节点,它们可能导致混合且不可区分的节点嵌入,从而使得GNNs的分类任务更加困难。最近,提出了大量的分析、基准和模型来研究和解决异质性挑战。此外,许多应用被发现与异质性问题密切相关,如欺诈/异常检测、图聚类、推荐系统、生成模型、链接预测、图分类和着色等。 在本文中,我们对最近与异质性相关的研究进行了全面回顾,包括基准、模型、理论研究和分析、应用、挑战和未来方向。与现有的异质性综述相比,我们的贡献包括: * 对同质性指标(第三部分)和异质性基准(第四部分)的详细和新颖分类:

我们首次全面总结了同质性指标,并在具有各种生成方法的合成图上对它们进行了详细比较 * 我们首次提出并识别了良性、恶性和模糊异质性数据集 * 我们广泛总结和分类了同质和异质图基准 * 对异质性模型(第五、六部分)的全面回顾,包括:

同质图上最新更新的异质性模型(第五部分) * 首次对异质图上异质性问题的模型进行回顾(第六部分) * 对异质图上无监督学习方法的广泛总结(第七部分) * 首次深入回顾同质性和异质性的理论研究(第八部分) * 对异质性相关应用的全面概述,如欺诈/异常检测、隐私保护、联邦学习、知识蒸馏和点云分割等(第九部分) * 对挑战和未来方向的最广泛和深入的概述,如大型语言模型(LLM)、图基础模型和缩放法则等(第十部分)

在同质图上进行异质性问题的有监督学习

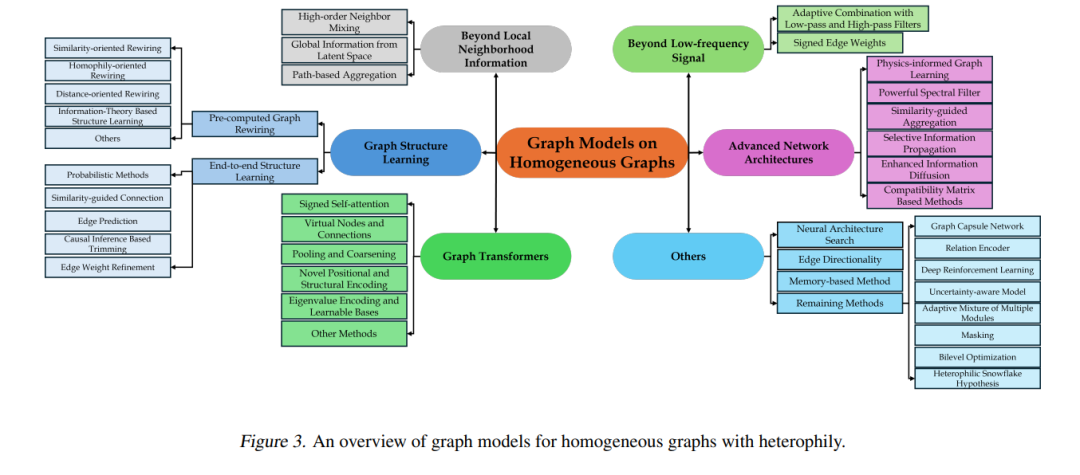

大多数为解决异质性问题设计的图模型都是基于同质图的。在本节中,我们将总结和分类最具代表性的方法。 本节的结构如下:

超越低频信号(第5.1节)GNNs被认为是低通滤波器,主要捕捉低频图信号。然而,高频信号能够捕捉到邻域的不相似性,被发现对异质性有帮助,但在大多数GNNs中缺失。高通滤波器和带符号(负)消息传递是利用高频信号的两种主要技术。

超越局部邻域信息(第5.2节)异质性描绘的不相似性是局部邻域的属性,为了找到具有相似标签的节点,目标节点可以从全局信息中获得帮助。这类方法包括从高阶邻居、潜在空间和基于路径的聚合中获取全局信息。

先进的网络架构(第5.3节)这一组方法试图设计更复杂和更强大的网络架构,以更好地利用异质性信息。它们包括基于物理信息的图学习、强大的频谱GNNs、相似性引导的聚合、选择性消息传递、增强信息扩散和基于兼容矩阵的方法。 * 图结构学习(第5.4节)这一系列方法试图打破有害或与任务无关的连接,并重建边缘以获得更好的学习图结构。它们包括预计算重连和端到端结构学习方法。

图变换器(第5.5节)图变换器(GT)是一种特殊类型的图模型,它采用自注意力和各种编码技术来捕捉节点之间的长程依赖性,并可能对异质性有帮助。在这一小节中,我们将总结特定于异质性的GTs。

其他方法(第5.6节)还有一些不太具有代表性但仍值得一提的方法。它们是主流方法的良好补充,例如神经结构搜索、边缘方向性、基于记忆的方法等。

在接下来的小节中,我们将详细介绍上述方法。在图3中,我们提供了在同质图上进行异质性问题的有监督学习的图模型概述。

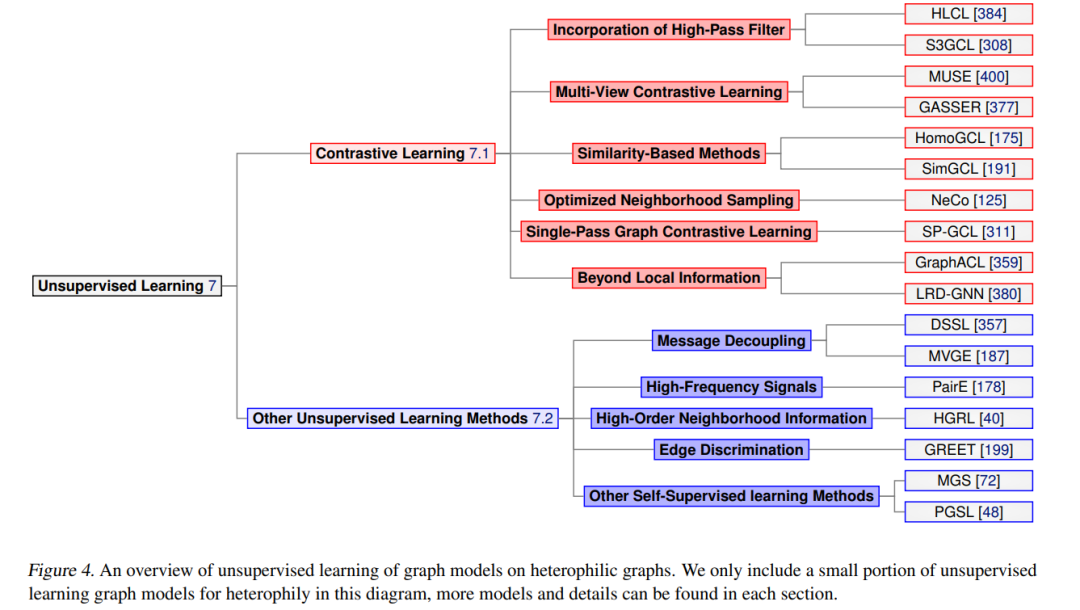

在异质图上的无监督学习

图无监督学习方法能够在没有标记节点的情况下学习节点嵌入和发现潜在结构。异质性的概念可以在图无监督学习中得到利用。在本节中,我们将探讨异质图上的对比学习(第7.1节),并总结其他无监督学习方法(第7.2节)。在图4中,我们展示了异质图上的无监督学习模型概述。

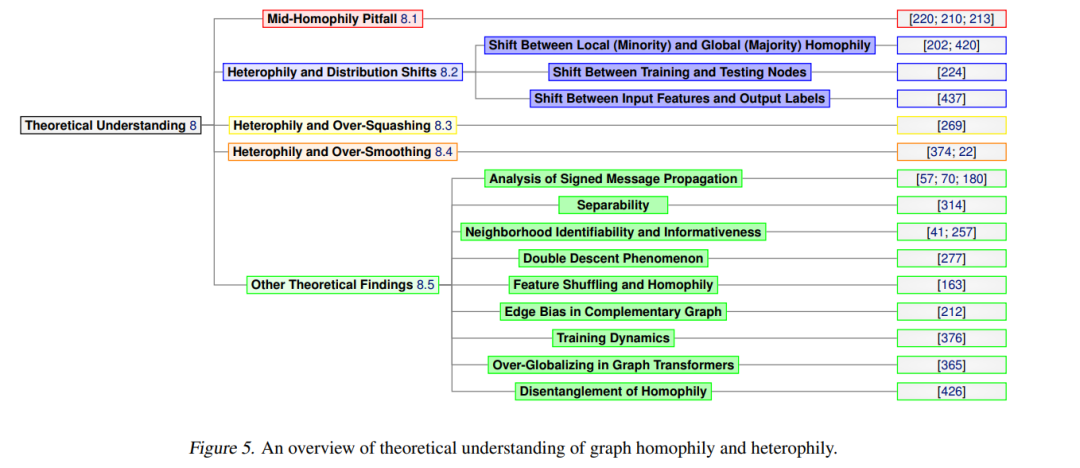

同质性和异质性的理论理解

通常认为同质性对图学习有益,而异质性结构对模型性能有负面影响。然而,最近的实证研究(见第4.1节)和理论结果表明,同质性和异质性的影响远比“同质性胜利,异质性失败”要复杂得多。研究人员对同质性/异质性的理解存在不同观点,这些争议在近年来图社区中得到了广泛讨论。在本节中,我们将总结近期在不同方面的理论研究,包括中等同质性陷阱(第8.1节)、分布偏移(第8.2节)、异质性与过度压缩(第8.3节)、异质性与过度平滑(第8.4节)以及其他有趣的理论发现(第8.5节),如可分性、双下降现象、训练动态、过度全球化和同质性解缠等。在图5中,我们展示了本节的概述。

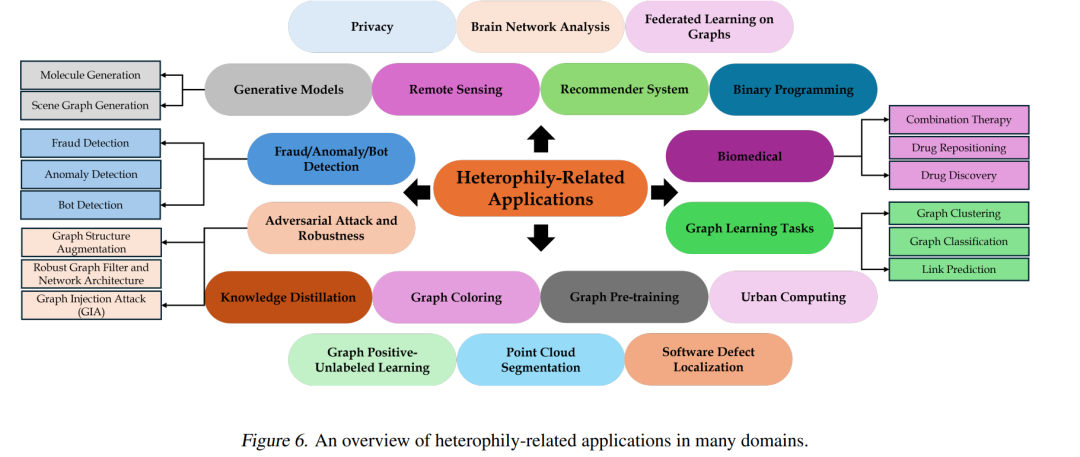

与异质性相关的应用

许多现实世界的应用可以建模为图,而异质性挑战可能与其中的大多数密切相关。在本节中,我们将尽可能广泛地探索与异质性相关的应用,包括: * 第9.1节:欺诈/异常/机器人检测 * 第9.2节:生成模型 * 第9.3节:图学习任务 * 第9.4节:推荐系统 * 第9.5节:生物医学 * 第9.6节:知识蒸馏 * 第9.7节:对抗攻击和鲁棒性 * 第9.8节:隐私保护 * 第9.9节:城市计算 * 第9.10节:图着色 * 第9.11节:二元编程 * 第9.12节:遥感 * 第9.13节:图正负无标签学习 * 第9.14节:点云分割 * 第9.15节:联邦学习 * 第9.16节:软件缺陷定位 * 第9.17节:脑网络分析 * 第9.18节:图预训练