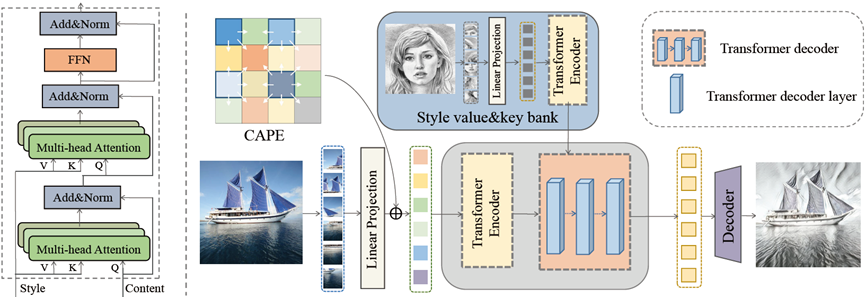

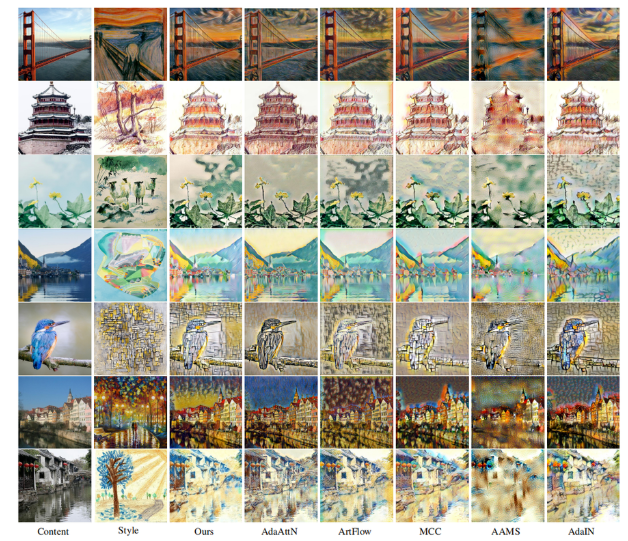

本文提出了一种基于Transformer的图像风格迁移方法,即StyTr2,将输入图像的长期依赖关系引入到风格化中。与用于其它视觉任务的Transformer不同,本文设计的StyTr2包含两个不同的Transformer编码器,分别为内容和风格图片生成具有不同域特征的序列。在编码器之后,采用多层Transformer解码器,根据风格序列对内容序列进行风格化。此外,本文分析了现有位置编码方法的不足,提出了内容感知的位置编码,该方法具有尺度不变特性,更适合于图像风格化任务。与基于CNN和基于流的最新方法相比,定性和定量实验均证明了StyTr2的有效性。

成为VIP会员查看完整内容

相关内容

专知会员服务

8+阅读 · 2022年3月12日

专知会员服务

34+阅读 · 2020年6月19日