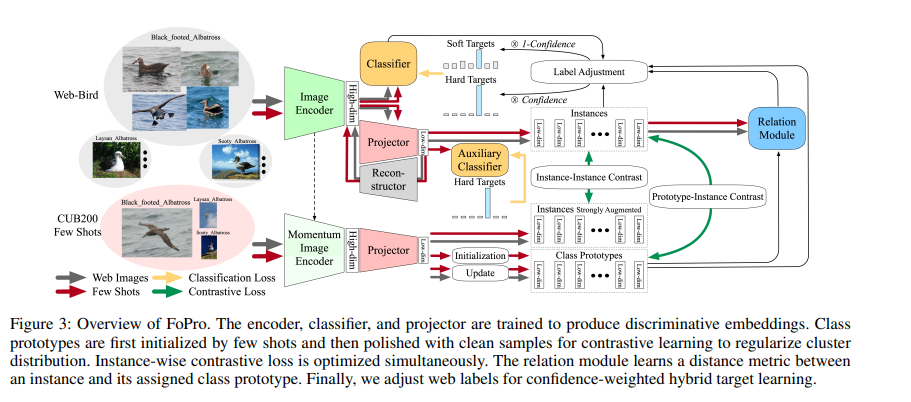

最近,人们开始研究web监督学习(WSL)如何利用来自互联网的大量可访问数据。现有的大多数方法都专注于从网络图像中学习噪声鲁棒模型,而忽略了由于网络域与现实域的差异而导致的性能下降。然而,只有解决了上述性能差距,我们才能充分利用web数据集的实用价值。为此,提出一种少样本引导的原型表示学习方法(FoPro),只需要来自现实的少量标记样本,可以显著提高现实世界领域的性能。具体地说,我们用少量的真实世界数据作为“现实”原型初始化每个类中心。然后,通过对比学习,缩小了网络实例与“现实”原型之间的类内距离。最后,我们用一个可学习的度量来测量图像-原型距离。原型由相邻的高质量网络图像进行抛光,并涉及到去除遥远的分布不均的样本。在实验中,FoPro在web数据集上进行训练,并在真实世界的数据集上进行指导和评估。我们的方法在三个细粒度数据集和两个大规模数据集上实现了最先进的性能。与现有的WSL方法相比,在相同的少样本设置下,FoPro仍然在现实世界的泛化能力方面表现出色。代码可从https://github.com/yuleiqin/fopro获得。

成为VIP会员查看完整内容