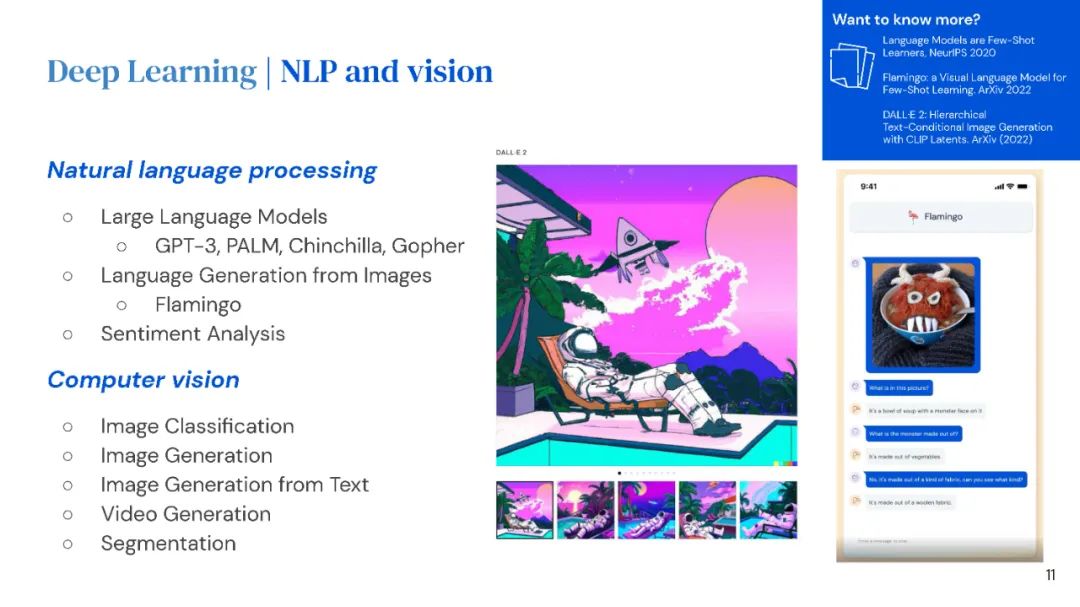

深度神经网络在计算机视觉、自然语言处理和机器人技术等领域取得了卓越的成就。然而,这些模型在理解我们周围世界的能力,以及概括和适应新任务或环境的能力方面仍然是苍白的。这个问题的一个可能的解决方案是理解因果关系的模型,因为这样的模型可以推断因果变量之间的联系和干预对它们的影响。然而,现有的因果算法通常不能扩展,也不能适用于高度非线性的设置,它们也假设因果变量是有意义的和给定的。最近,为了解决上述挑战,人们对因果关系和深度学习的交集产生了越来越多的兴趣和研究活动,它们使用深度学习来受益于因果算法,反之亦然。本教程旨在为两种受众介绍因果关系和深度学习的基本概念,提供近期工作的概述,以及目前在这两个领域研究的协同作用、挑战和机会。

因果关系的深度学习

建模功能的关系 学习图上的分布 表征是学习特征的丰富组成 潜在的因果变量

深度学习的因果关系

为什么DL有因果关系 DL中因果学习的基准 DL中因果学习的目标和架构 利用因果关系的概念来帮助DL

讲者:

Nan Rosemary Ke是Deepmind的一名研究科学家,她的研究兴趣是建立模型,通过理解因果关系来概括变化的任务和环境。在加入Deepmind之前,她是Mila的博士生,由Yoshua Bengio和Chris Pal担任导师。她还获得了Facebook奖学金,并在2020年被评为机器学习领域的一颗后起之星。Rosemary的研究兴趣结合了深度学习和因果关系的见解;她一直致力于建立能够充分理解因果关系的模型,以推断因果变量之间的联系以及干预对它们的影响。她的研究成果已在各大会议(NeurIPS, ICML, ICLR)上发表。

Stefan Bauer是斯德哥尔摩KTH的助理教授和CIFAR Azrieli全球学者。通过使用和开发因果关系、深度学习和真实机器人系统的工具,他的研究聚焦于人工智能的长期目标,即设计能够跨环境和任务推断经验的机器。他在苏黎世联邦理工学院获得计算机科学博士学位,并因杰出博士论文被授予苏黎世联邦理工学院奖章。在此之前,他毕业于苏黎世联邦理工学院(ETH Zurich),获得数学学士学位和理学硕士学位,以及伦敦大学(LSE)的经济学和金融学学士学位。在学习期间,他获得了瑞士和德国国家功绩基金会的奖学金。2019年,他获得了机器学习国际会议(ICML)的最佳论文奖,2020年,他是云端机器人挑战real-robot-challenge.com的主要组织者。

参考文献:

Michael Ahn et al. "Do as i can, not as i say: Grounding language in robotic affordances." arXiv preprint arXiv:2204.01691 (2022).

Kartik Ahuja, Jason Hartford, and Yoshua Bengio. "Properties from mechanisms: an equivariance perspective on identifiable representation learning." NeurIPS (2021).

Martin Arjovsky et al. "Invariant risk minimization." arXiv preprint arXiv:1907.02893 (2019).

Ossama Ahmed, Frederik Träuble, Anirudh Goyal, Alexander Neitz, Yoshua Bengio, Bernhard Schölkopf, Manuel Wüthrich, and Stefan Bauer. Causalworld: A robotic manipulation benchmark for causal structure and transfer learning, ICLR, 2021.

Sara Beery, Grant Van Horn, and Pietro Perona. "Recognition in terra incognita." ECCV. 2018.

Matthew Botvinick et al. Reinforcement learning, fast and slow. Trends in cognitive sciences 2019.

Robert Geirhos, et al. "Shortcut learning in deep neural networks." Nature Machine Intelligence (2020).