DeepMind 牛津大学《视觉注意力机制》,提高视觉推理能力(PPT下载)

【导读】神经网络中的注意机制(attention mechanism),也被称为神经注意(neural attention)或注意(attention),近几年得到了人们越来越多的关注。近日,牛津大学博士生 Adam Kosiorek 在9月20日至21日在伦敦举行的深度学习峰会上做了关于注意力机制提高视觉推理能力的报告,本文是其在会前接受采访时的一些问答。此外演讲的34页PPT也一同公布。

Adam Kosiorek 是牛津大学博士三年级学生,导师是牛津大学统计学教授 Yee Whye Teh,同时Adam Kosiorek跟随导师也加入了DeepMind实习。在这里八卦一下Yee Whye Teh是Hinton高徒的高徒,他和Hinton在2006年共同提出深度信念网络。

此外还可以关注AdamKosiorek关于注意力机制的博文《Attention in Neural Networks and How to Use It》。链接:

http://akosiorek.github.io/ml/2017/10/14/visual-attention.html

注意力机制

Attention Mechanisms: How Can Knowing Where to Look Improve Visual Reasoning?

作者|Pip Curtis, Director - RE•WORK

编译|专知

整理|Mandy, Sanglei

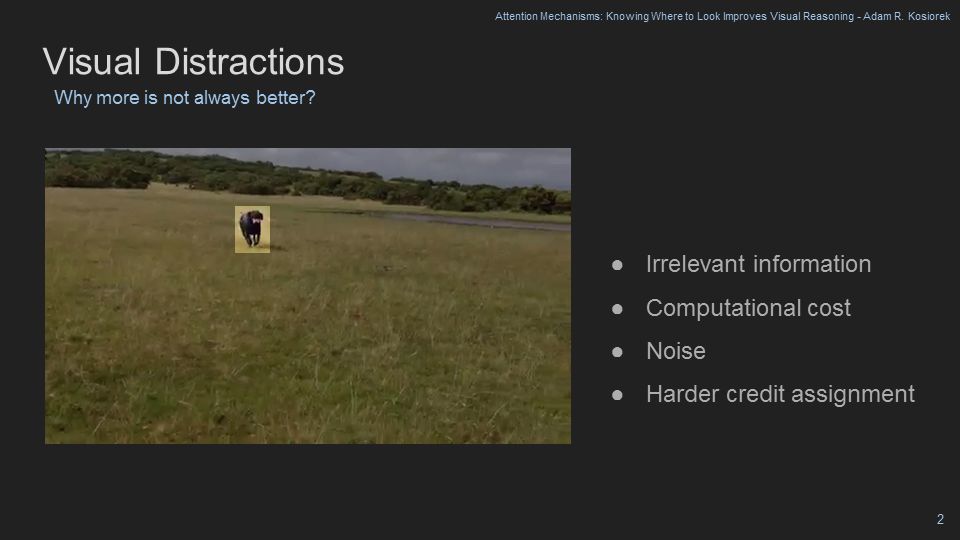

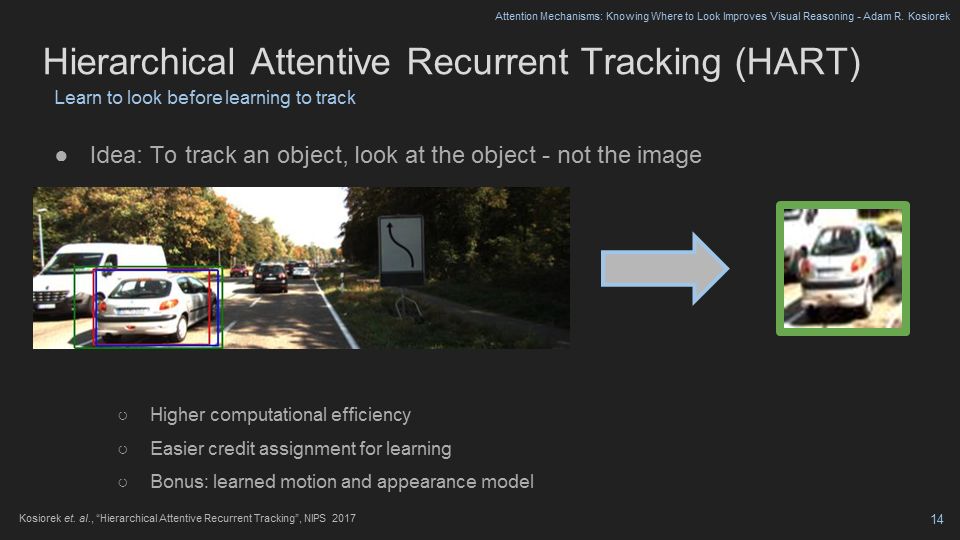

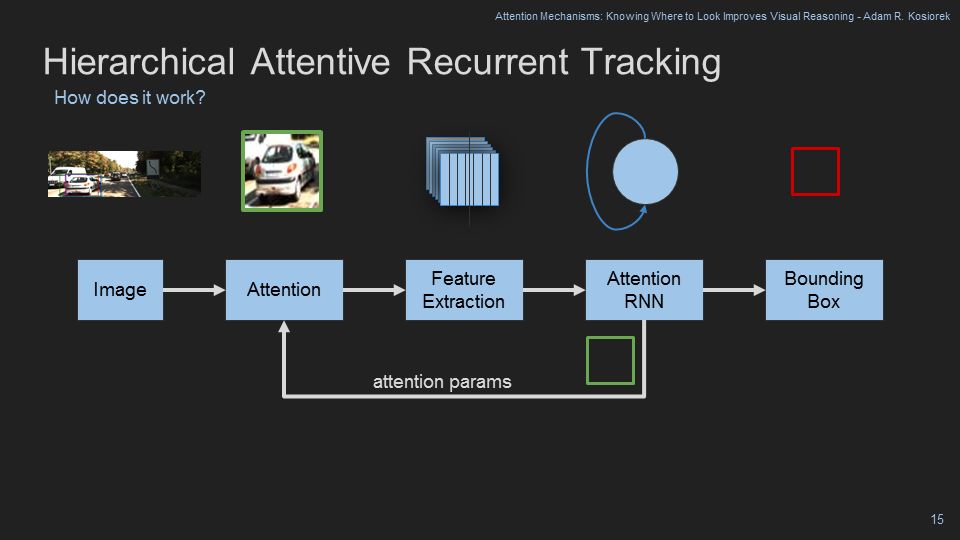

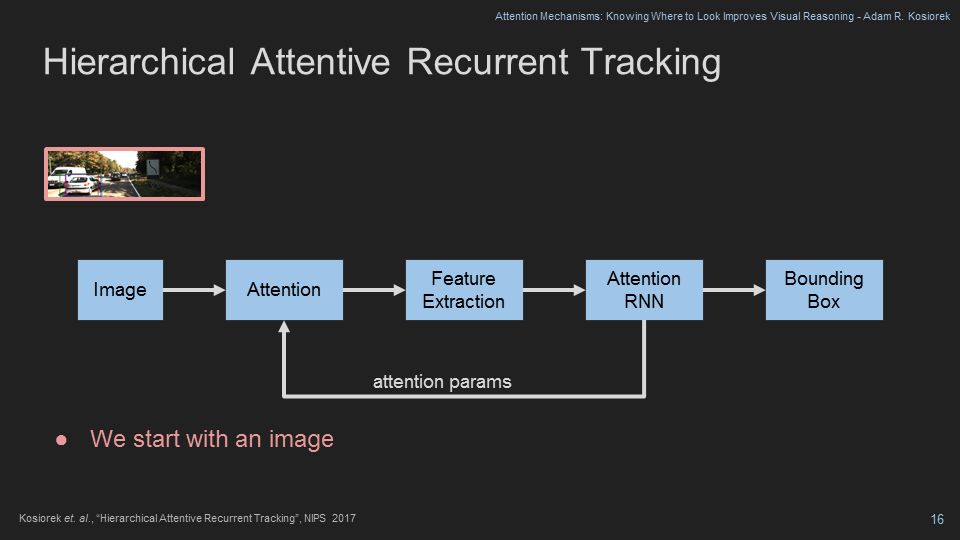

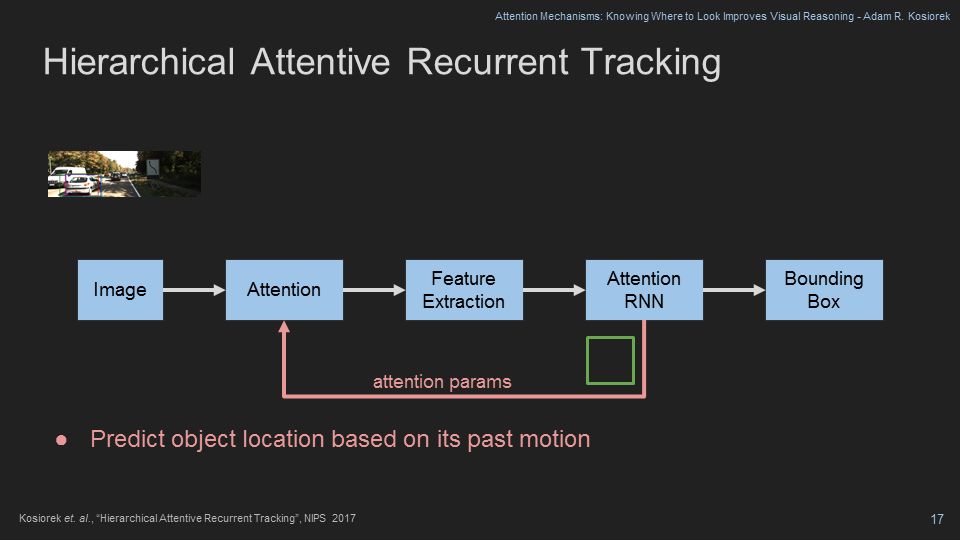

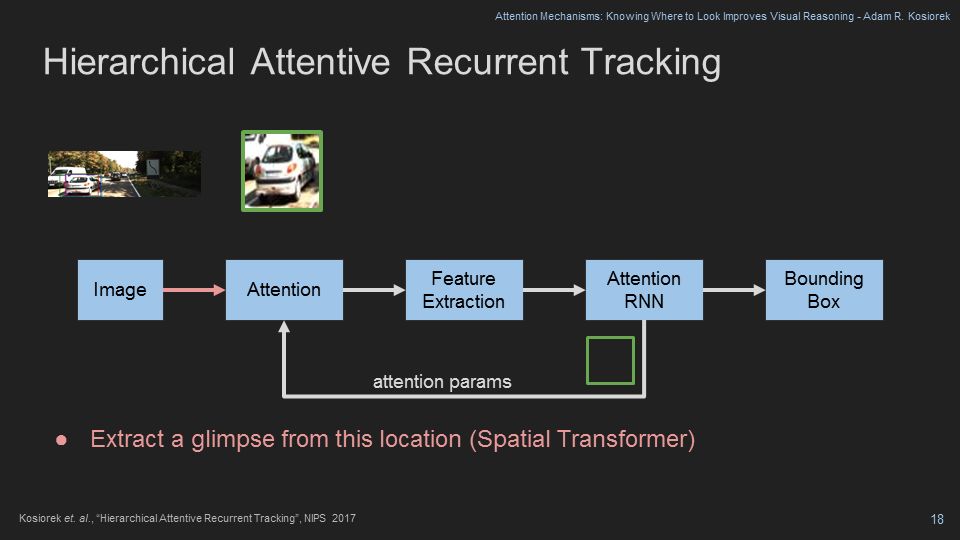

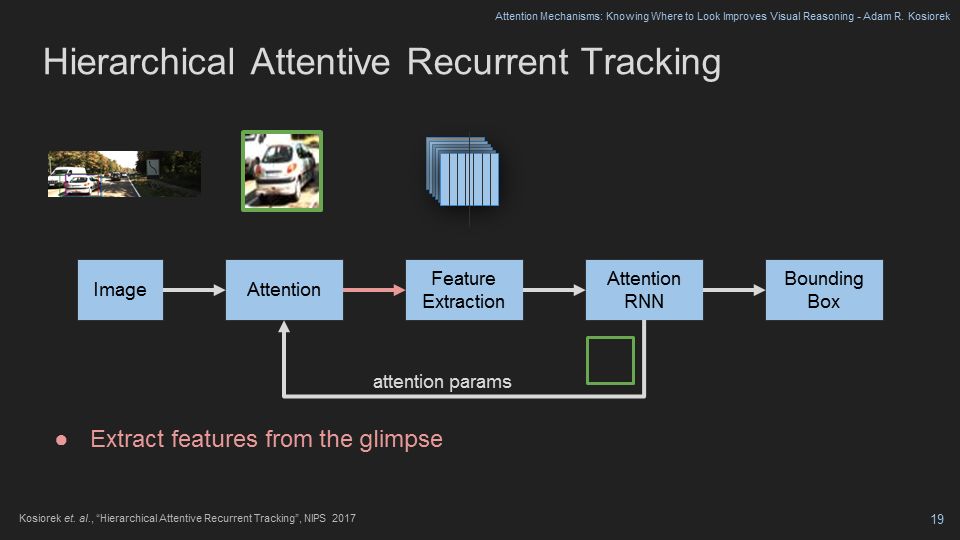

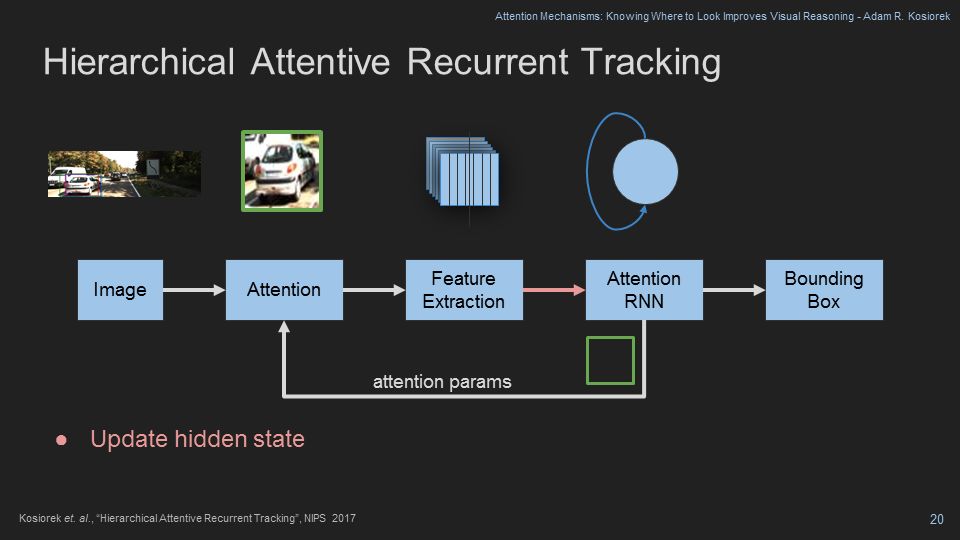

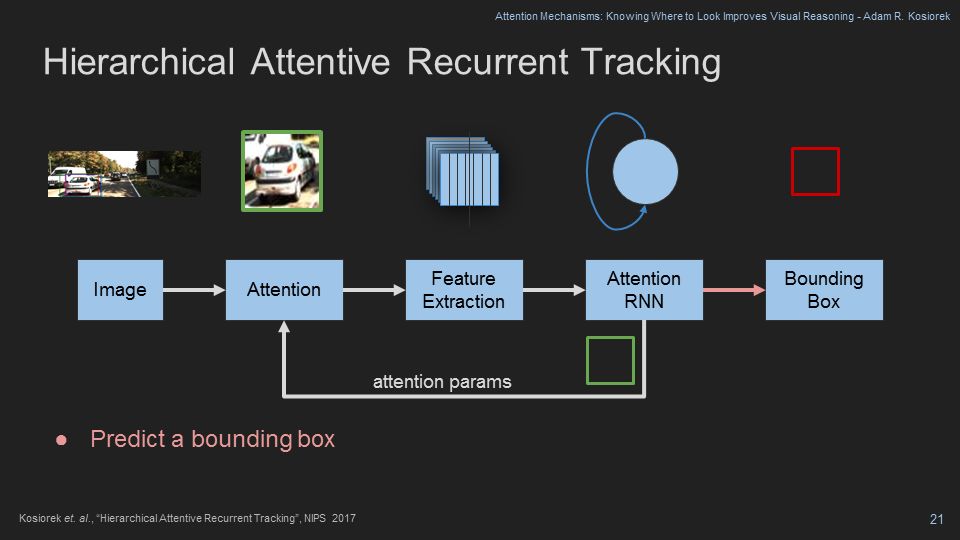

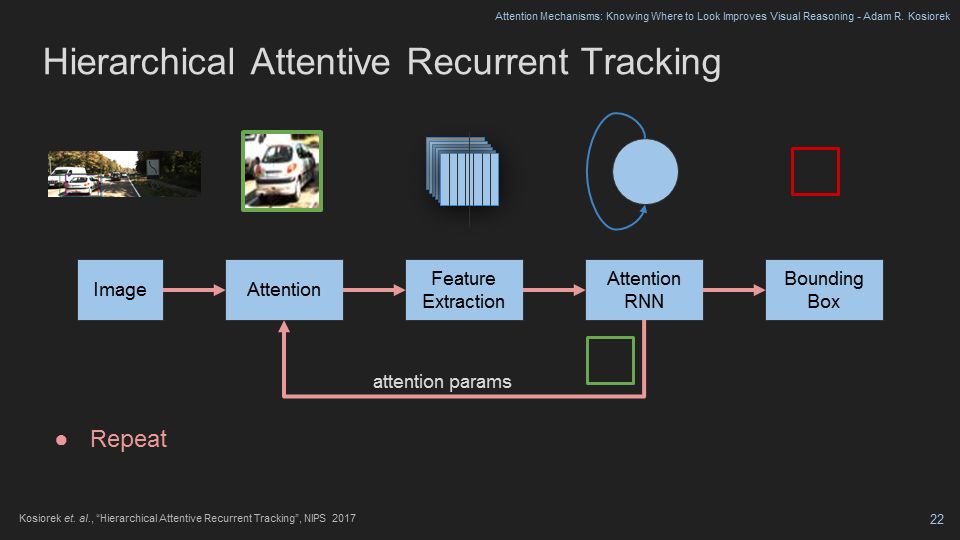

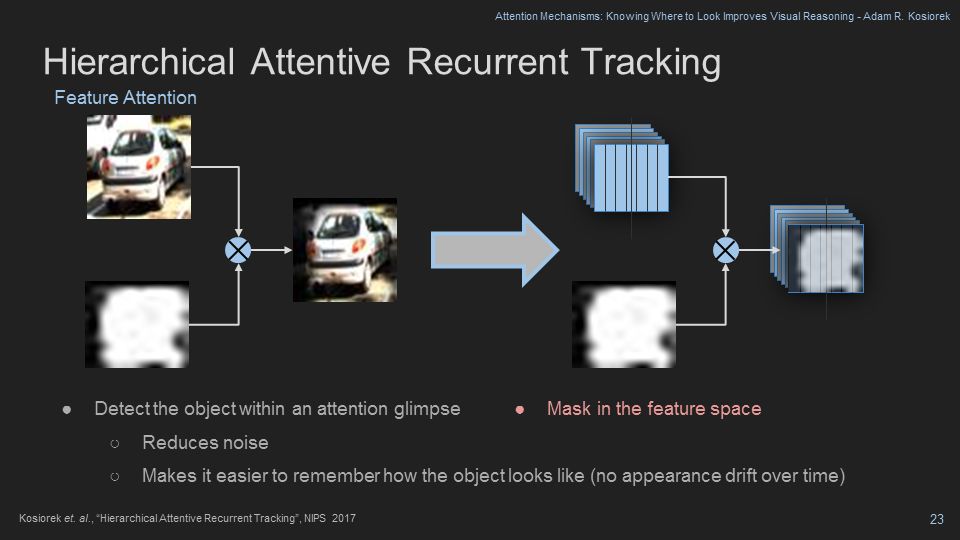

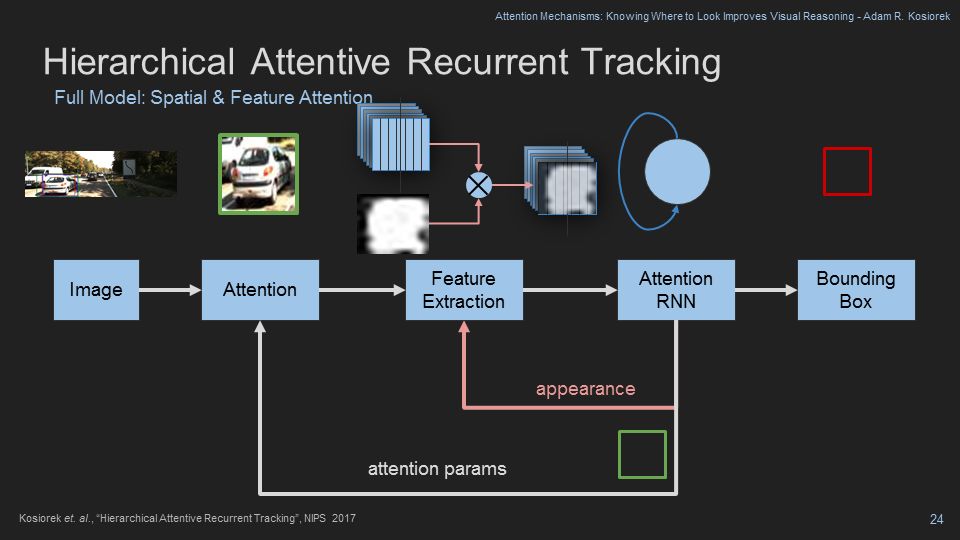

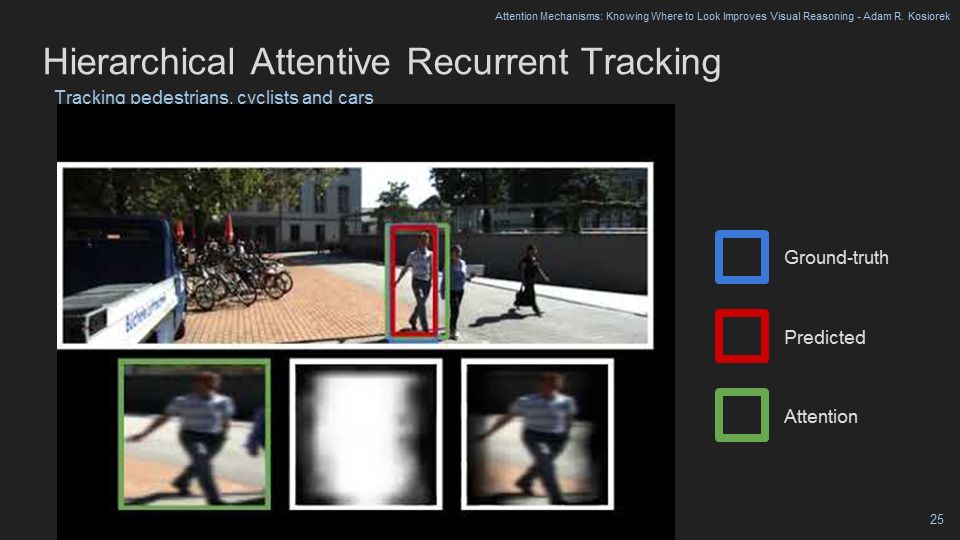

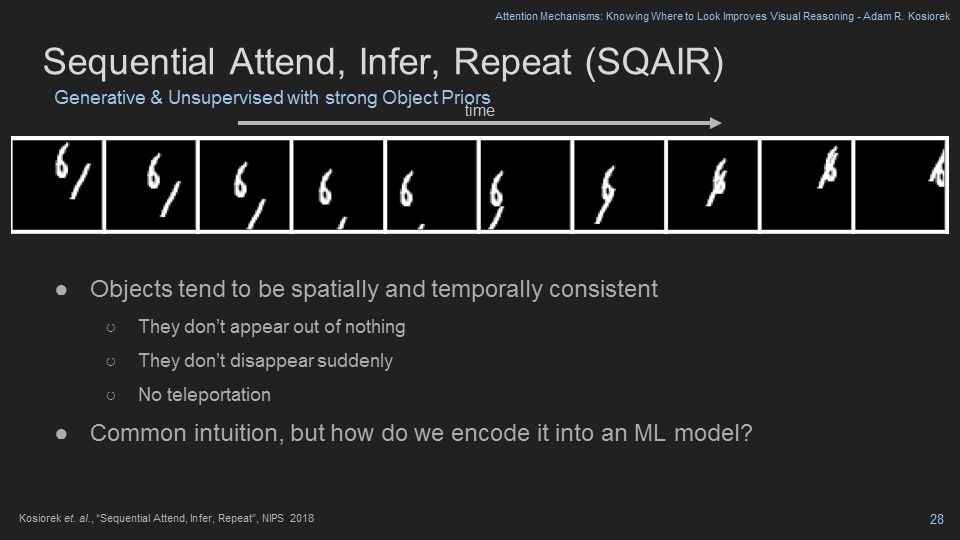

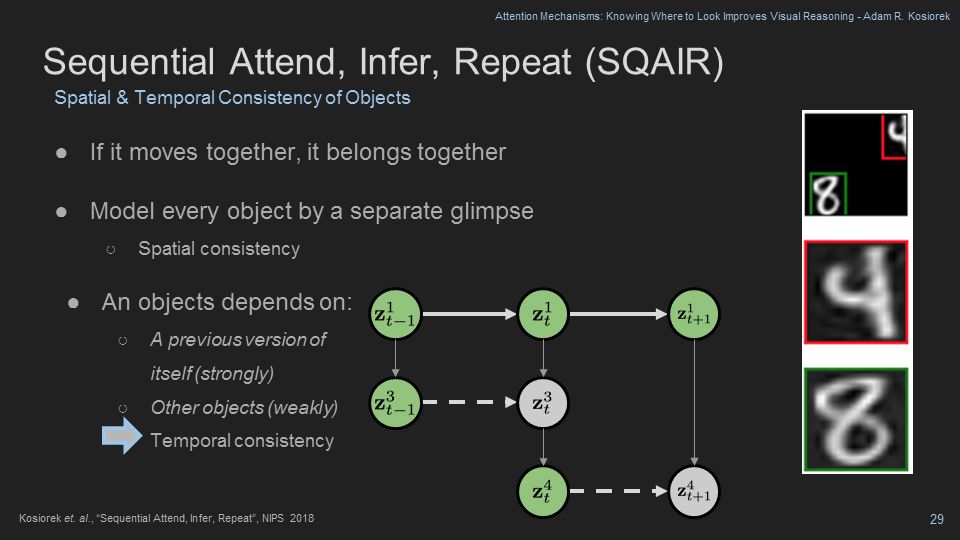

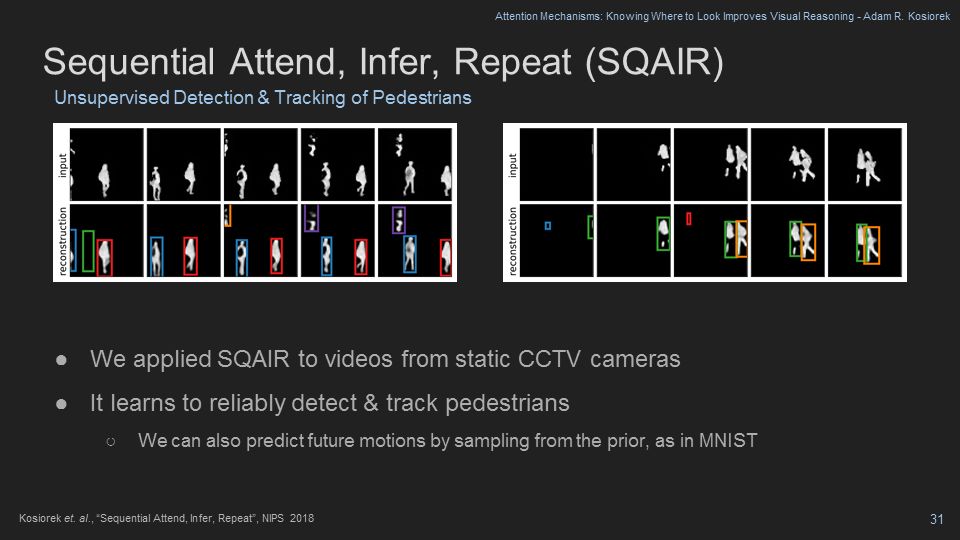

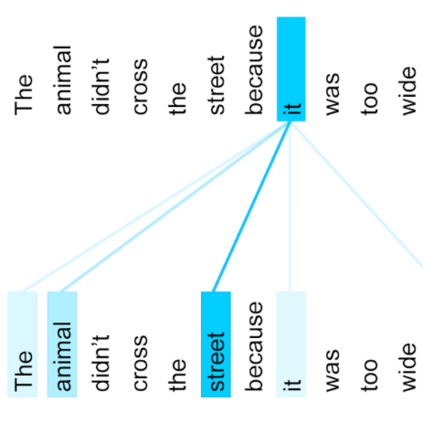

人类视觉皮层使用注意机制来丢弃无关信息,并有效地分配计算资源。它启发了现代机器学习,其中注意力机制是内存模块的重要组成部分,用于建模对象交互以及解决复杂的推理任务。今年9月20日至21日在伦敦举行的深度学习峰会上,牛津大学博士,DeepMind的研究实习生Adam Kosiorek将探索视觉任务的注意力机制,并展示在具有注意力机制层次结构的循环框架中,他们如何帮助跟踪真实世界视频中的物体。注意力也能够模拟我们对物体做出的共同假设 - 它们不会凭空出现,也不会消失在空气中。这种洞察力有助于无监督地检测和跟踪多个物体 - 无需任何人为监督。在峰会召开之前,我们采访了Adam,进一步了解了他迄今为止的职业生涯以及他目前的工作。

概述一下您在牛津大学和DeepMind的工作

我相信概率推理 —— 相信我们周围发生的事情。重要的是他们不仅要捕捉周围世界的状态,还要捕捉它的不确定性。出于这个原因,我的研究主要集中在随机神经网络和用于训练它们的算法上,主要用于时间序列的生成建模。

您是如何开始深度学习的工作的?您首先想到的是什么?机器人技术还是人工智能?

我对机器人的痴迷始于我在2008年重看电影《I, Robot》。我被为每个人创建个人助理的想法所吸引:它可以改善地球上大多数人的生活质量。但那时我还没有意识到这个问题有多难。

我花了几年的时间才发现真正吸引我的是学习能力和智能。我们需要什么样的控制算法来让类人机器人以类似于人类的方式移动?我们如何赋予人工智能以我们所拥有的推理能力?我试图回答这样的问题,这激发了我对深度学习的兴趣。现在我最感兴趣的是推理部分。思考意味着什么?我们如何建立机器学习模型来实现这一点?

是什么激励您继续在这个领域工作?

我发现深度学习研究非常有价值。创建系统有一些特殊之处,可以学习从头开始解决难题。一开始他们从不工作,但随着我们投入时间和精力,我们可以慢慢了解他们的工作方式并慢慢改进。

您是如何改进视觉推理的?

计算机视觉深度学习的研究主要集中在监督学习方面。我们以输入和输出对的形式提供问题规范,我们训练机器学习模型来匹配输入和输出。这种方法非常成功,但一般来说,除非你是一家大公司,否则这种方法非常昂贵,而且无法实现。

我关注的是结构化的模型,它可以在没有人为监督的情况下学习有用的表示。通过这种方式,我们可以利用无限数量的未标记数据来学习表示,然后只需要很少的监督就可以使用这些数据来解决问题。一方面,它使学习更像人类;另一方面,它使机器学习对于那些没有无限资源的人来说更容易使用。

您目前在工作中面临哪些挑战,以及如何使用AI来克服这些挑战?

我目前研究的问题是关于空间,或者更确切地说,我们如何让人工智能意识到它们周围的(物理)空间。这个问题很有挑战性,也因为我们并不完全清楚想要的结果是什么:我们不确定意识到空间意味着什么。

您的工作在现实世界中有哪些应用?

我帮助开发的一些学习算法可以用于训练随机自编码器类型的神经网络,它几乎可以应用于任何地方。

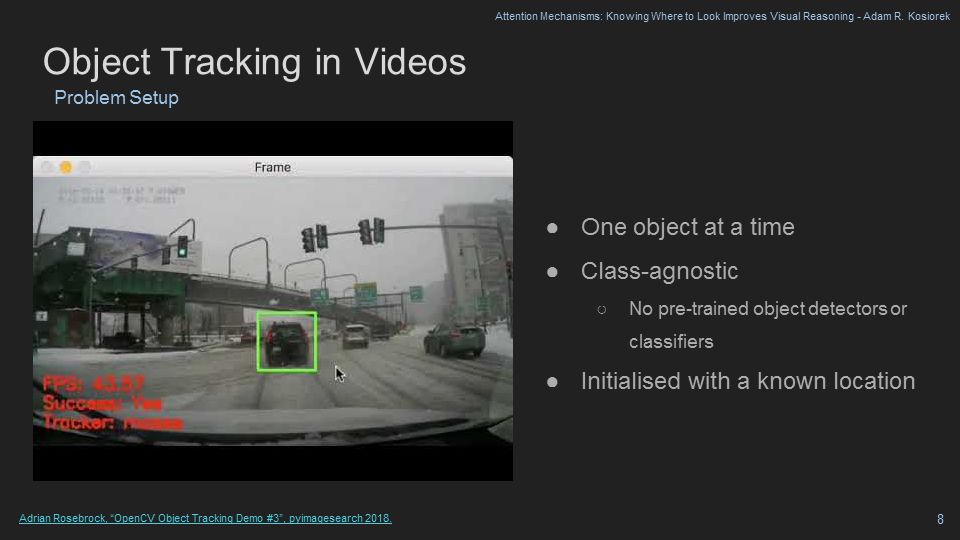

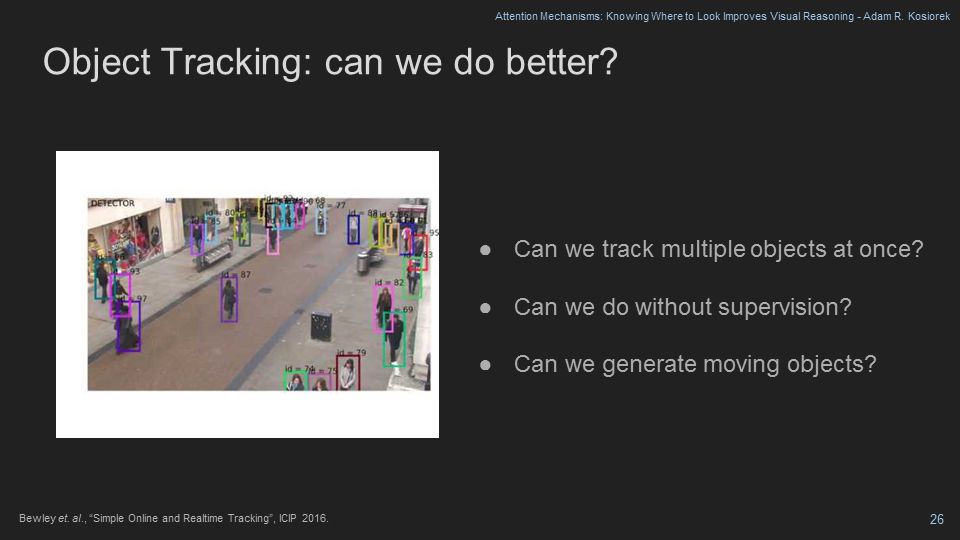

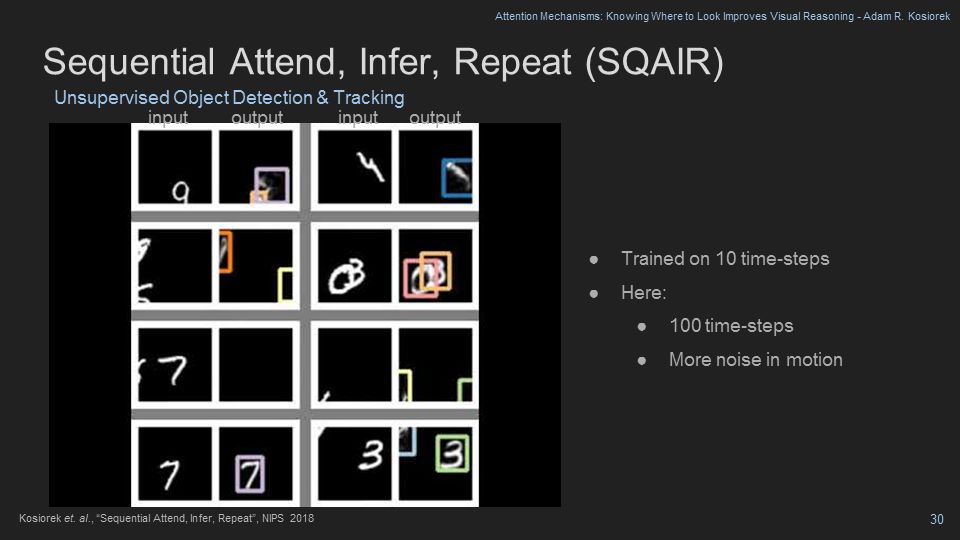

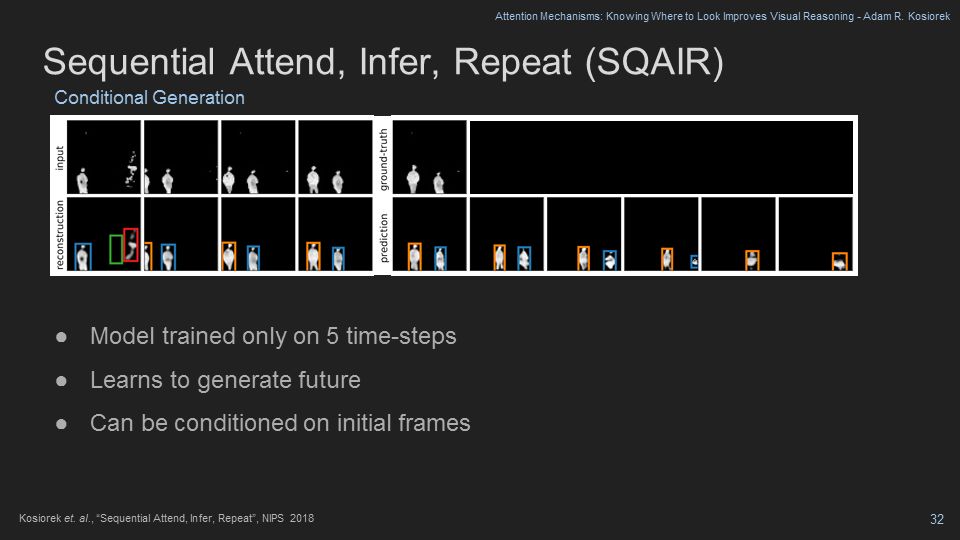

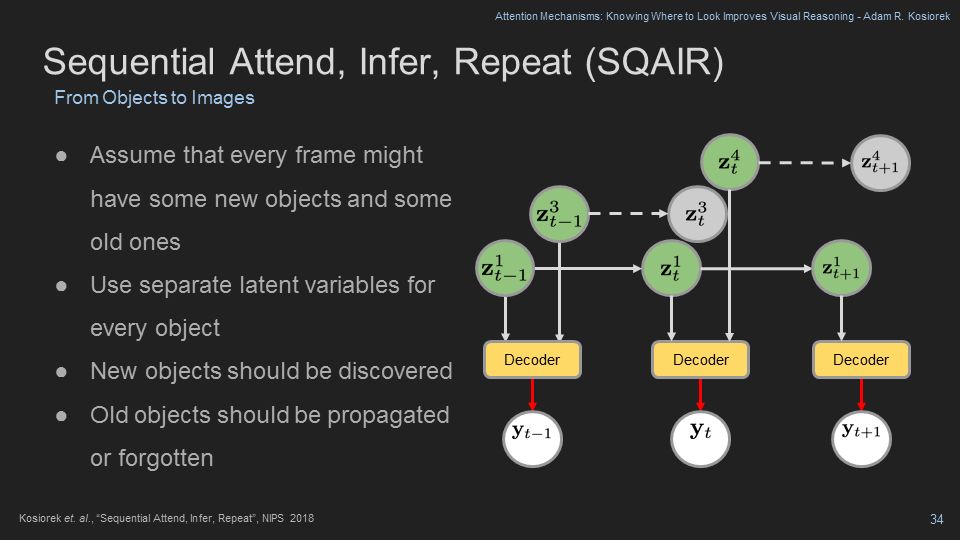

我还开发了两种新的目标跟踪算法,我将在我的演讲中详细介绍。第一个是HART1,它可以用于在真实世界的视频中跟踪对象,尽管它需要人为标记的数据来进行训练。第二种是SQAIR2,它允许在没有任何人工监督的情况下对移动对象进行建模,并能够创建可以在视频中检测和跟踪对象的系统。

人工智能正在无数的行业中得到应用 - 您最期待看到哪些领域的变革,您认为我们将在哪些领域看到最大的影响?

我对改变科学感到非常兴奋。机器学习模型可用于增强和加速许多领域的研究进程。它们使我们能够加快模拟恒星的速度,或降低发现新药的成本(通常是按数量级)。我们甚至可以使用ML来提高组织的效率,通过帮助我们安排会议并有效地运行会议。

您的下一步计划是什么?

我试图赋予人工智能以空间感和围绕它们的物体的概念。这是我博士学位的一部分,我还有一年多一点的时间。毕业后,我还不确定自己是要创办一家公司,还是继续从事工业研究。

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“AM2018” 就可以获取最新PPT 下载链接~

附PPT全文:

参考链接;

https://www.re-work.co/blog/attention-mechanisms-how-can-knowing-where-to-look-improve-visual-reasoning

-END-

专 · 知

人工智能领域26个主题知识资料全集获取与加入专知人工智能服务群: 欢迎微信扫一扫加入专知人工智能知识星球群,获取专业知识教程视频资料和与专家交流咨询!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请加专知小助手微信(扫一扫如下二维码添加),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

请关注专知公众号,获取人工智能的专业知识!

点击“阅读原文”,使用专知