在复杂场景尤其是对抗环境下,大量在实验环境下性能优秀的算法依旧与人类视觉感知能力存在巨大的鸿沟。这一现状表明,合理的评测方式不应局限于机器与机器进行性能对比,而应将“人”的因素加入到回路中,根据人类的能力对机器进行更加有效的评估。

中科院自动化所智能系统与工程研究中心立足人机对抗智能技术研究[1],并从人机对抗智能评测角度提出了视觉智能发展方向:视觉图灵[2]。视觉图灵是以类人视觉为标准的评估体系,旨在打破机器和人类认知的鸿沟。目前主流的视觉智能评估方法是基于大规模数据、大模型参数开展的,如团队针对视觉跟踪任务,构建大规模广覆盖单目标视觉跟踪评估平台GOT-10k[3],并提出训练与测试类别不重合的评估准测来度量算法在开集测试下的性能,与此不同,中心从“人机对抗”出发提出了视觉跟踪智能评估新方法,进一步对现有视觉跟踪智能方法的局限性进行分析,具体从拓展视觉跟踪任务、构建对抗实验环境和提出智能评估新方法三方面开展:

类人跟踪新任务:人类可以在任意场景中持续定位任意目标,在复杂场景尤其是对抗环境下依旧保持鲁棒跟踪能力。然而,目前的单目标跟踪任务因包含众多约束条件而被限制在简单场景下,导致现有跟踪方法无法具备“类人”的鲁棒跟踪能力。因此,团队首先拓展单目标跟踪任务的边界,并提出全局实例跟踪任务(Global Instance Tracking, GIT),旨在对人类视觉跟踪能力进行精确建模,使任务的应用范围进一步拓展至对抗场景中。

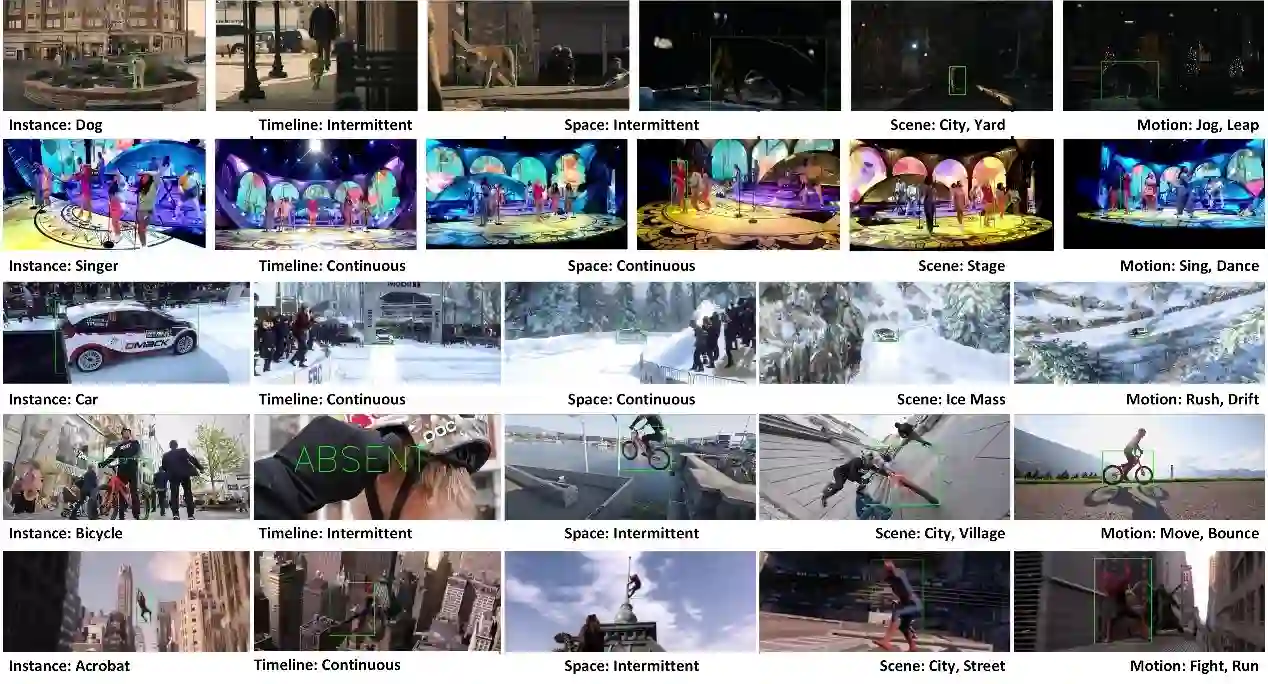

高质量对抗跟踪环境:真实世界包含诸多挑战因素和对抗场景,但目前的单目标跟踪基准主要由简单场景构成,与真实应用环境具有较大差异。因此,团队基于任务特点构建全局实例跟踪智能评估平台 VideoCube,旨在为算法提供一个近似于真实世界的高质量环境。VideoCube包含丰富的对象类别、场景类型、运动模式和大量挑战属性,并充分涵盖被其他数据集所忽略的复杂场景和对抗场景,实现对真实世界的精确刻画。

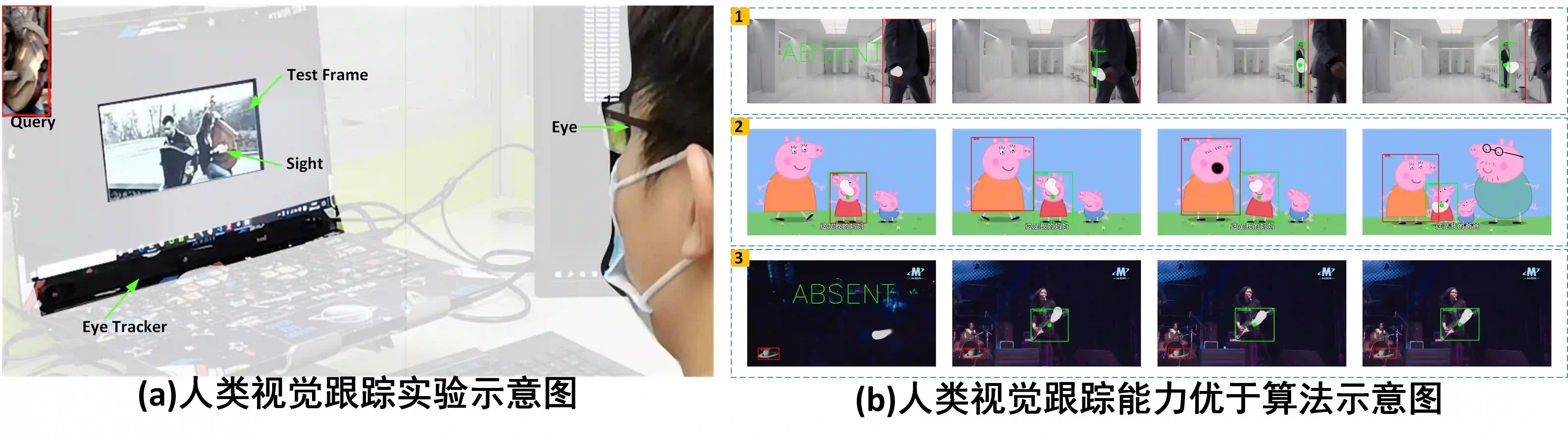

人机对抗智能评估方法:团队从“人机对抗”的角度出发,首次在视觉物体跟踪任务中引入人类实验者,旨在以人类视觉跟踪能力为基准,全面度量算法的智能程度。实验结果表明,在运动较为平缓的视频帧,现有目标跟踪方法与人类视觉跟踪能力相近。但在复杂场景尤其是对抗场景下,人类视觉跟踪能力要优于算法。

图1 VideoCube代表性视频示意图。每段视频均包含丰富的挑战因素,并充分涵盖被其他数据集所忽略的复杂场景和对抗场景,实现对真实世界的精确刻画。

图2 视觉跟踪实验及部分结果示意图(b图中绿色为目标真实位置,红色为算法结果,白色圆点为人眼注视位置)。

综上,这一工作以“人机对抗”为引导,在任务设定、环境构建和智能评估三个维度进行创新,成功将“视觉图灵”应用于单目标跟踪任务中,为实现近似或超越人类的跟踪算法提供研究基础,同时也为基于“视觉图灵”开展计算机视觉任务研究提供一种可行的范式。相关研究成果Global Instance Tracking: Locating Target More Like Humans于2022年2月被IEEETransactions on Pattern Analysis and Machine Intelligence(TPAMI)期刊正式录用。

论文信息:

Shiyu Hu, Xin Zhao, Lianghua Huang, andKaiqi Huang. “Global Instance Tracking: Locating Target More Like Humans”, IEEETransactions on Pattern Analysis and Machine Intelligence (TPAMI), 2022.

参考文献:

[1] 黄凯奇,兴军亮,张俊格,倪晚成,人机对抗智能技术,中国科学:信息科学, 2020, 50(4):540-550, DOI:10.1360/N112019-00048.

[2] 黄凯奇,赵鑫,李乔哲,胡世宇,视觉图灵:从人机对抗看计算机视觉下一步发展,图学学报,2021, 42(3):339-348, DOI:10.11996/JG.j.2095-302X.2021030339.

[3] Lianghua Huang, Xin Zhao, and Kaiqi Huang. “GOT-10k: A Large High-diversity Benchmark for Generic ObjectTracking in the Wild”, IEEE Transactions on Pattern Analysis and MachineIntelligence (TPAMI), 2021, 43(5): 1562-1577, DOI:10.1109/TPAMI.2019.2957464.