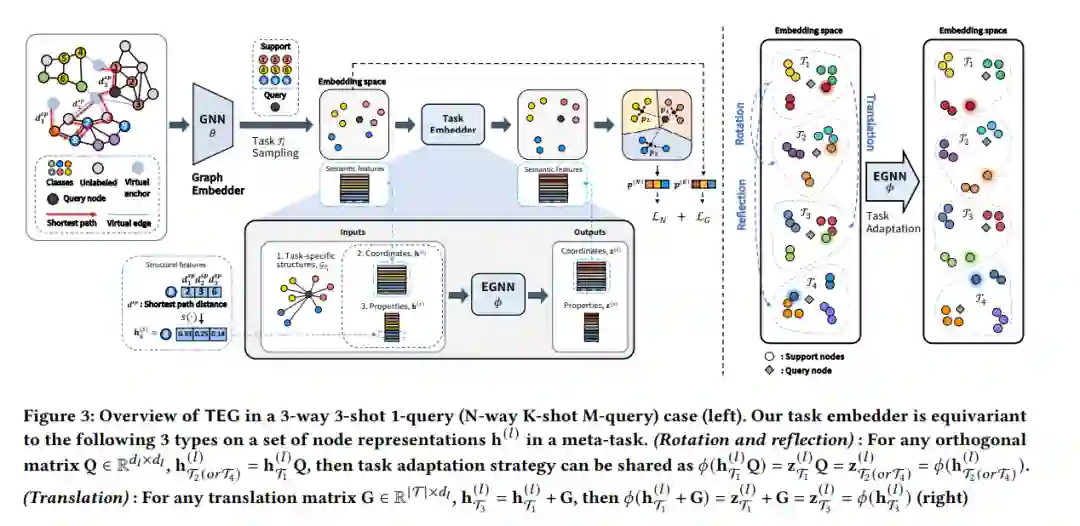

尽管图神经网络(GNNs)在节点分类任务中取得了成功,但其性能严重依赖每个类别有足够数量的标记节点的可用性。在现实情况中,不是所有的类别都有很多标记的节点,可能存在模型需要分类新类别的实例,这使得手动标记变得困难。为了解决这个问题,GNNs能够在只有少数标记节点的情况下分类节点是非常重要的,这被称为少样本节点分类。先前基于情景元学习的方法已在少样本节点分类中显示出成功,但我们的发现表明,只有在有大量不同训练元任务的情况下才能实现最优性能。为了应对基于元学习的少样本学习(FSL)的这一挑战,我们提出了一种新的方法,即任务等变图少样本学习(TEG)框架。我们的TEG框架使模型能够使用有限数量的训练元任务来学习可转移的任务适应策略,从而获得大范围元任务的元知识。通过结合等变神经网络,TEG可以利用它们的强大泛化能力来学习高度适应的任务特定策略。因此,即使在训练元任务有限的情况下,TEG也能够达到最新的性能。我们在各种基准数据集上的实验显示出TEG在准确性和泛化能力方面的优势,即使在使用最小的元训练数据的情况下,也强调了我们提出的方法在应对基于元学习的少样本节点分类的挑战方面的有效性。我们的代码可在以下链接获取:https://github.com/sung-won-kim/TEG。

https://www.zhuanzhi.ai/paper/8dd39564415f0565ca0314e2437cc751

成为VIP会员查看完整内容

相关内容

Arxiv

20+阅读 · 2023年3月21日

Arxiv

20+阅读 · 2019年10月25日