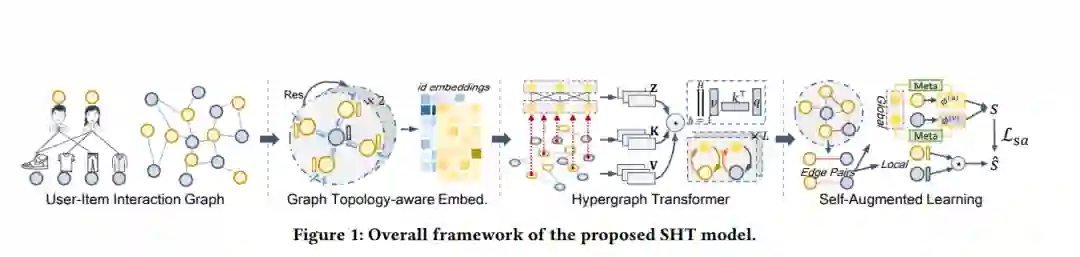

图神经网络(GNNs)已被证明是有前途的解决方案的协同过滤(CF)与用户项交互图建模。现有的基于GNN的推荐系统的关键思路是递归地执行沿用户-项目交互边缘传递的消息,以细化编码的嵌入。尽管他们的有效性,但是,目前大多数的推荐模型依赖于足够的和高质量的训练数据,这样学习的表示可以很好地捕捉准确的用户偏好。在许多实际的推荐场景中,用户行为数据往往是有噪声的,并且呈现出偏态分布,这可能导致基于GNN的模型的表现性能欠佳。在本文中,我们提出了一种新的自监督超图transformer 框架(SHT),它通过明确地探索全局协作关系来增强用户表示。具体来说,我们首先赋予图神经CF范式以超图transformer 网络来维持用户和物品之间的全局协同效果。在提取全局上下文的基础上,提出了一种跨视图生成式自监督学习组件,用于用户-物品交互图上的数据增强,以增强推荐系统的鲁棒性。大量实验表明,SHT可以显著提高各种最先进的基线性能。进一步的消融研究表明,我们的SHT推荐框架在缓解数据稀疏性和噪声问题方面具有卓越的表达能力。源代码和评估数据集可以在https://github.com/akaxlh/SHT上找到。

https://www.zhuanzhi.ai/paper/26befcb0dcaffada049d2feb3264ec47

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2022年9月23日