在人类中,注意力是所有感知和认知操作的核心属性。考虑到我们处理竞争性信息来源的能力有限,注意力机制选择、调整和关注与行为最相关的信息。

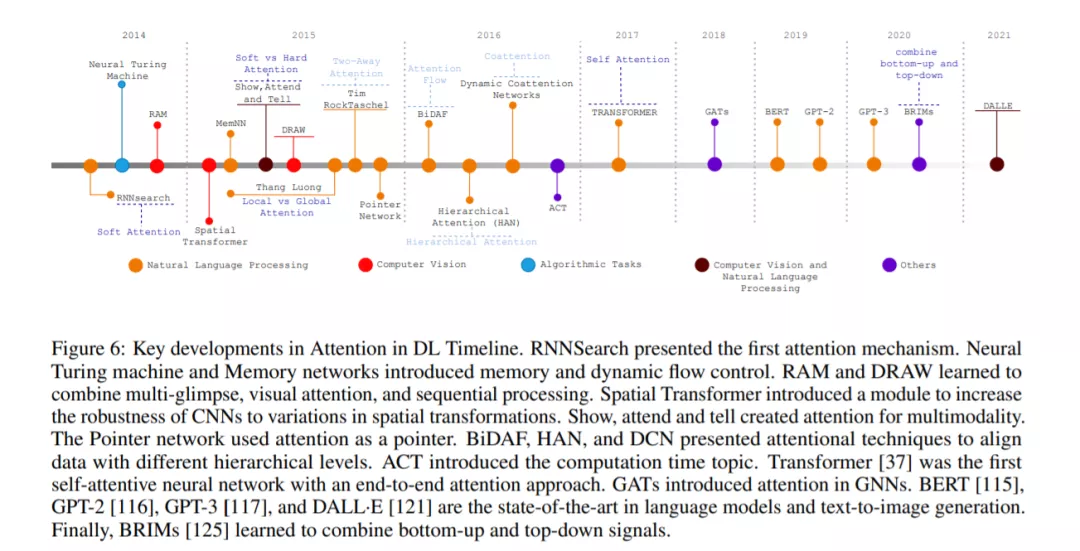

几十年来,哲学、心理学、神经科学和计算机科学都在研究注意力的概念和功能。在过去的六年中,这一特性在深度神经网络中得到了广泛的研究。目前,深度学习的研究进展主要体现在几个应用领域的神经注意力模型上。

本研究对神经注意力模型的发展进行了全面的概述和分析。我们系统地回顾了该领域的数百个架构,识别并讨论了那些注意力显示出重大影响的架构。我们亦制订了一套自动化方法体系,并将其公诸于众,以促进这方面的研究工作。通过批判性地分析650部文献,我们描述了注意力在卷积、循环网络和生成模型中的主要用途,识别了使用和应用的共同子组。

此外,我们还描述了注意力在不同应用领域的影响及其对神经网络可解释性的影响。最后,我们列出了进一步研究的可能趋势和机会,希望这篇综述能够对该领域的主要注意力模型提供一个简明的概述,并指导研究者开发未来的方法,以推动进一步的改进。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2021年5月26日

Arxiv

7+阅读 · 2018年10月31日