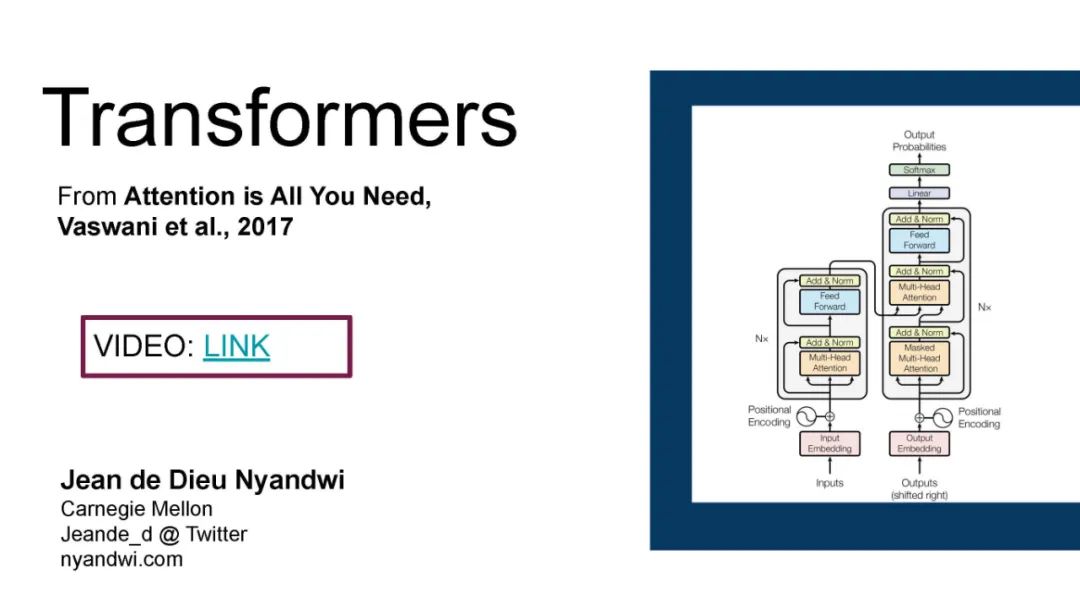

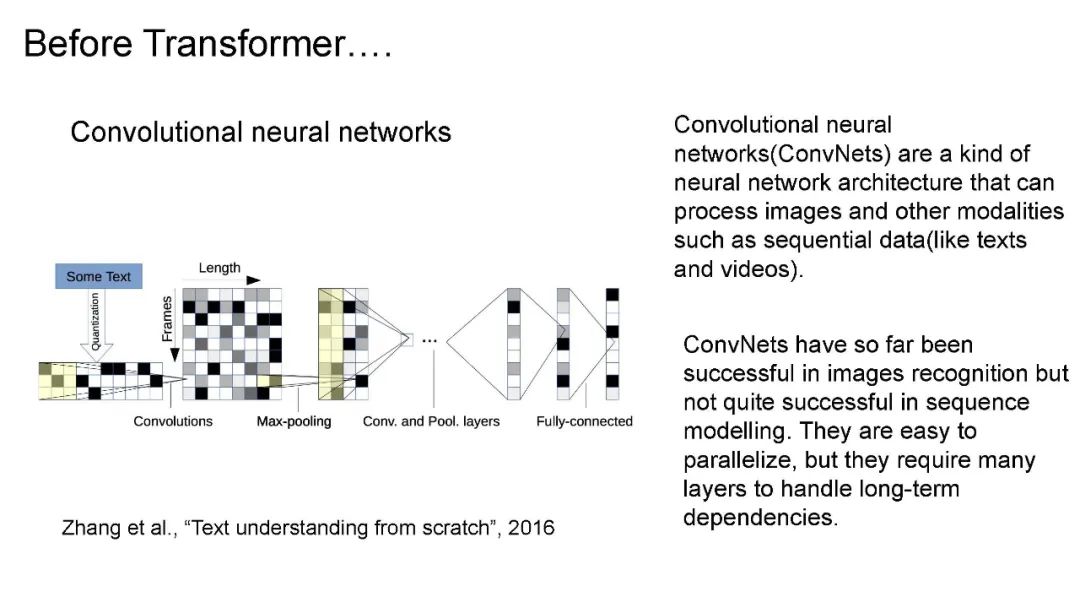

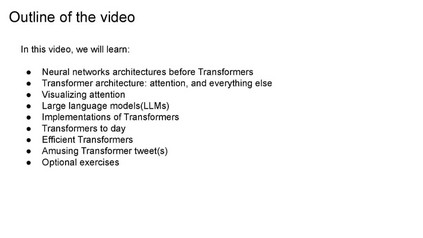

Transformer是一种基于注意力机制的神经网络架构。Transformer架构在Attention is All You Need论文中介绍,这是一篇你可能知道的优秀论文。transformer最初用于机器翻译,但截至目前,它们已应用于人工智能的其他领域,如计算机视觉、多模态学习、机器人、强化学习等。这是一个全面的视频,深入探讨了Transformer架构和注意力机制以及其他相关主题,如大型语言模型(涵盖BERT和GPT-3),高效的Transformer和Transformer目前的状态。

https://www.youtube.com/watch?v=VygOX3AyDQs&t=2s

成为VIP会员查看完整内容