斯坦福大学首个Transformers专题讲座视频放出,NLP、CV和RL无所不包

机器之心编辑部

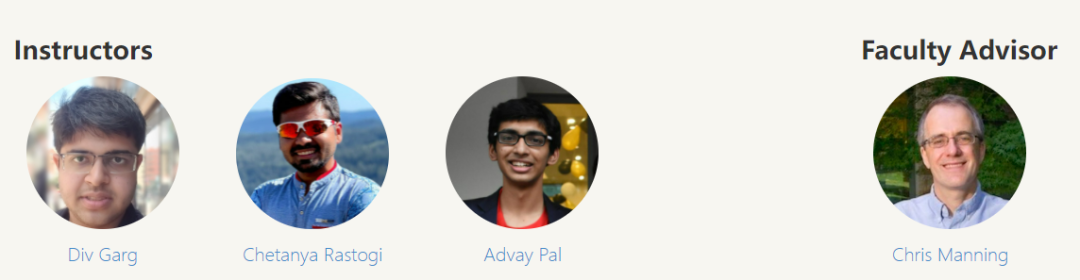

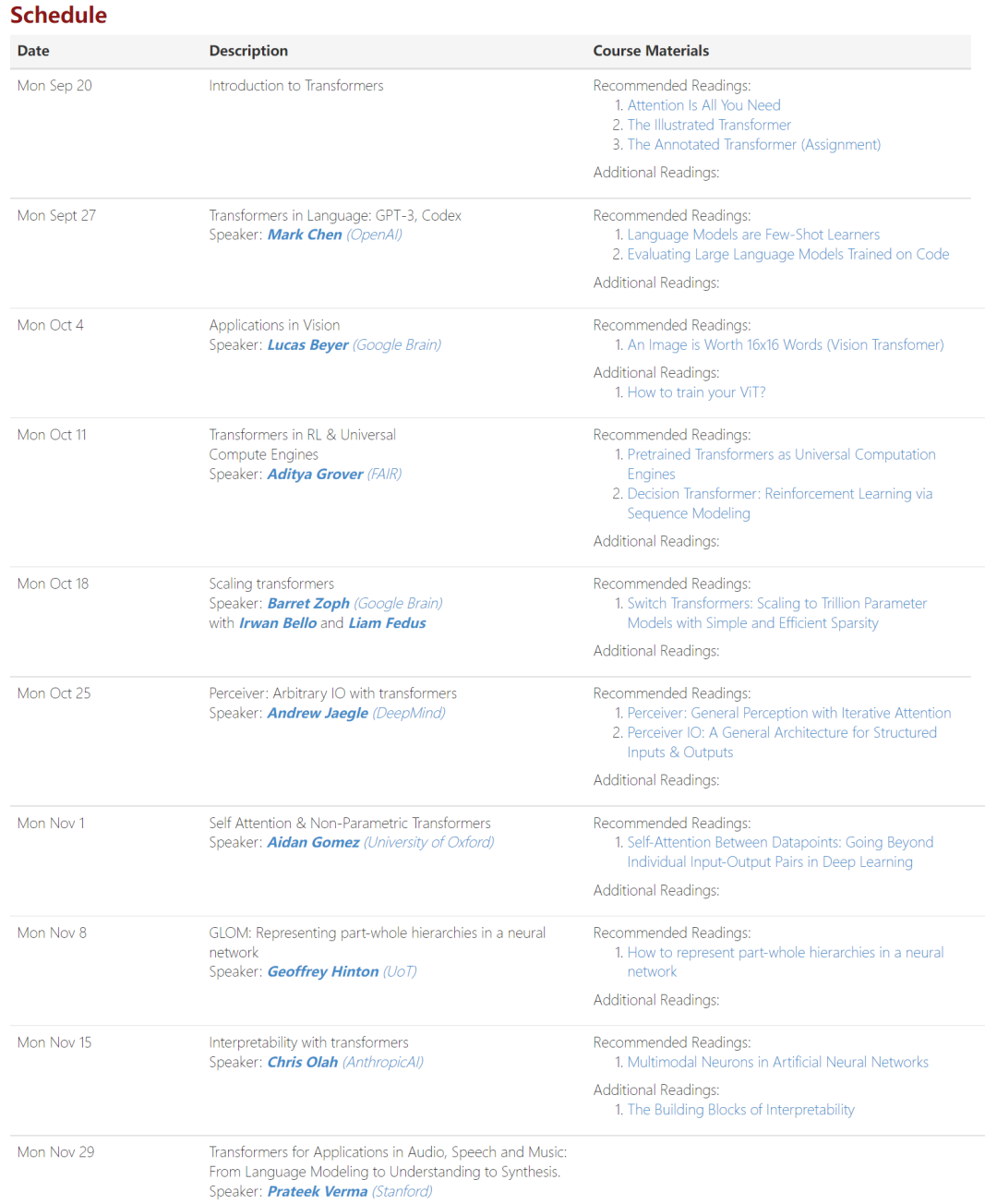

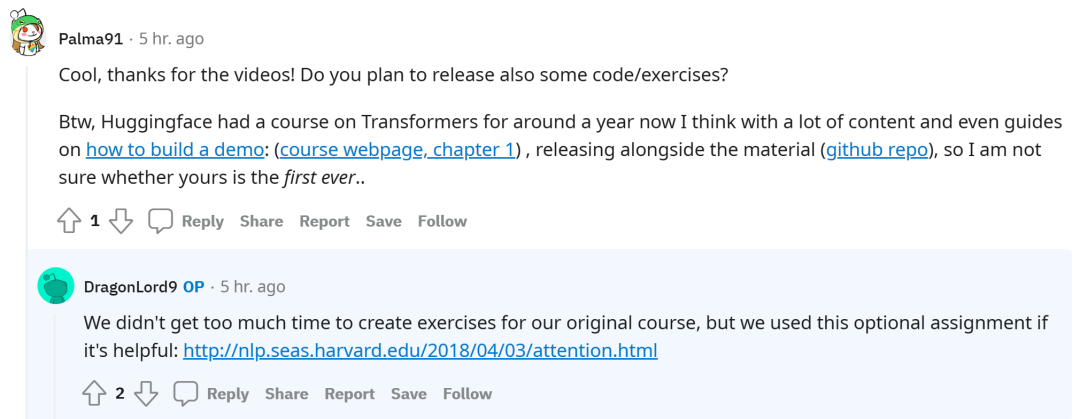

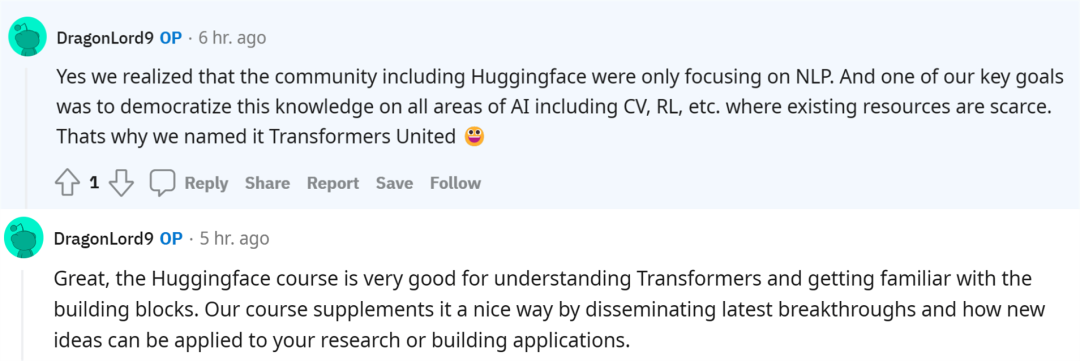

据了解,这是首个关于 Transformers 的专题课程。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“Transformer” 就可以获取《Transformer知识资料大全》专知下载链接

登录查看更多