近年来,我们见证了大型语言模型(LLM)的快速发展。基于强大的LLM,多模态LLM(MLLM)将模态从文本扩展到更广泛的领域,因其广泛的应用场景而引起广泛关注。由于LLM和MLLM依赖大量的模型参数和数据来实现突现能力,数据的重要性正受到越来越广泛的关注和认可。追踪和分析最近针对MLLM的数据导向工作,我们发现模型和数据的发展并不是两条独立的路径,而是相互关联的。一方面,更大量和更高质量的数据有助于MLLM的更好表现;另一方面,MLLM可以促进数据的发展。多模态数据和MLLM的共同发展需要明确以下几点:1)在MLLM的哪个发展阶段可以采用哪些以数据为中心的方法来增强哪些能力,2)通过利用哪些能力和扮演哪些角色,模型可以对多模态数据作出贡献。为了促进MLLM社区的数据-模型共同发展,我们系统地回顾了现有与MLLM相关的工作,从数据-模型共同发展的视角进行分析。本调查相关的一个定期维护的项目可以在 https://github.com/modelscope/data-juicer/blob/main/docs/awesome llm data.md 访问。

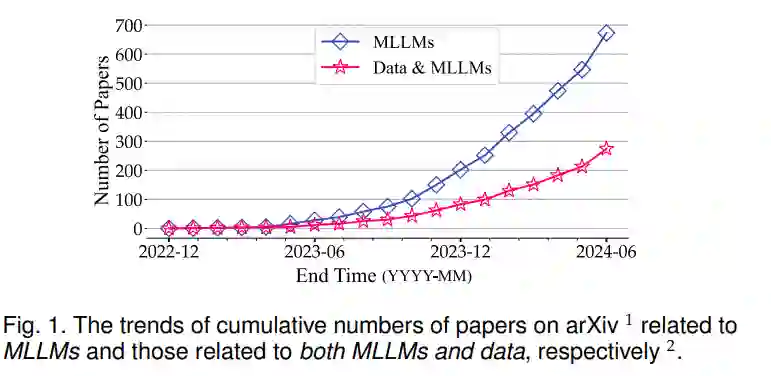

近年来,大型语言模型(LLM)在广泛的任务中展示了令人印象深刻的性能,并且相关技术取得了显著的进展。由于人类的感官不仅限于文本模态,多模态LLM(MLLM)逐渐进入视野,例如能够处理超越文本模态输入或输出的Gemini-1.5 [1] 和 Sora [2],以及能够在输入和输出之间进行多模态交互的GPT-4o [3] 和 NExT-GPT [4]。在过去两年中,MLLM受到广泛关注。正如图1所示,自2023年初以来,与MLLM相关的研究正在以越来越快的速度涌现。 MLLM的卓越性能源于LLM在参数数量扩大带来的解决一系列任务的突现能力[5]。许多研究表明,扩大模型规模需要更加海量的数据来补充[6], [7], [8],例如扩展法则[9], [10]。具体而言,研究表明,多模态模型需要指数级更多的数据才能在下游任务中实现线性零样本改进[11]。鉴于此,一系列工作将重点从仅仅关注模型架构和训练技术转移到数据中心方法,专注于高质量数据的策划[12], [13], [14], [15], [16], [17],以提供进一步释放大型模型潜力的数据基础。从图1可以看出,在现有关注MLLM的论文中,与数据中心方法密切相关的论文也表现出强劲的增长趋势,并占据了重要的部分。 随着与MLLM相关的大量技术工作不断涌现,一些针对MLLM的综述也逐渐出现[18], [19], [20], [21], [22], [23], [24], [25], [26], [27], [28], [29], [30], [31], [32], [33], [34]。这些综述主要从模型中心的角度进行,而数据的重要性需要进一步强调。一项最近的综述将数据中心的视角从单模态扩展到多模态,重点关注现有的数据中心方法,并根据所提出的数据管道阶段进行组织[35]。实际上,数据和模型的发展是交织在一起的,而不是分开的。更大数量和更高质量的数据提高了模型性能,而从高质量数据中受益的良好训练的模型可以进一步改进数据。这减少了人工成本,扩大了数据量,并通过使用需要标注的分割掩码进行训练的Segment Anything模型(SAM)[36]的训练成功展示了这一点。随着SAM在训练中的熟练程度提高,它逐渐取代人在标注任务中的角色,从而形成一个改进模型和数据集的循环。这样的渐进和良性循环促进了MLLM的发展,即受益于高质量数据集的MLLM可以帮助改进训练数据,反过来进一步增强MLLM。 数据-模型共同发展范式很有前途,但尚未得到充分研究。根据我们的调查,目前还缺乏从数据-模型共同发展视角对MLLM的综述。现有综述尚未建立数据中心方法与MLLM能力之间的关系,也没有清晰阐明MLLM的能力如何帮助构建数据集。实现MLLM数据-模型共同发展的关键在于阐明哪些数据方法可以增强每种特定的MLLM能力,以及了解模型可以扮演的角色,以改进多模态数据。因此,本综述旨在通过综合回顾回答以下研究问题,推进MLLM的数据-模型共同发展: * RQ1:在MLLM的生命周期中,哪些数据中心方法可以在哪个阶段用于增强哪些MLLM能力? * RQ2:模型可以扮演哪些角色以促进不同的数据中心方法,并在每种情况下利用模型的哪些特定能力?

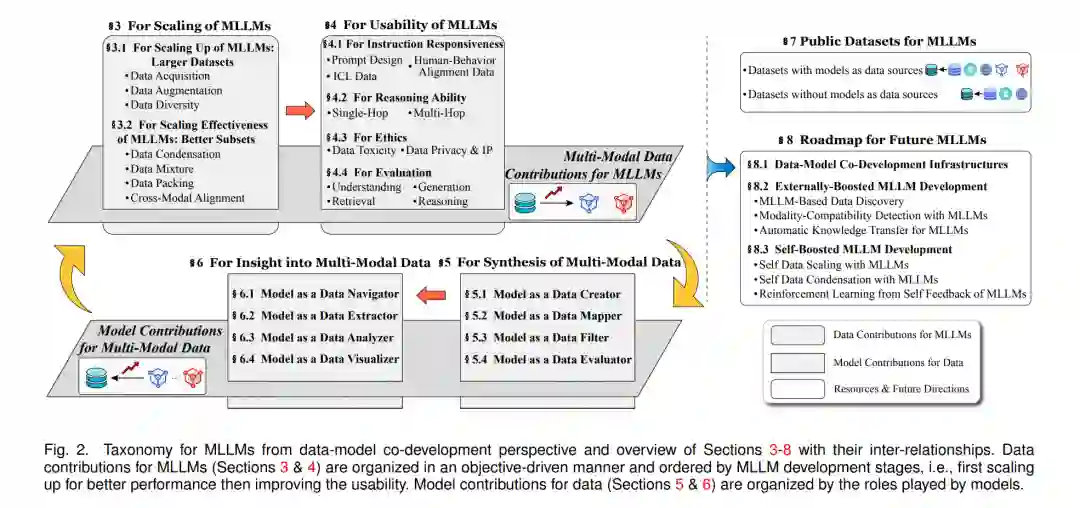

为了回答这两个关键研究问题,我们首先提出一个基于MLLM数据-模型共同发展范式的新分类法。我们将先前的努力分为两个主要类型:数据对模型的贡献和模型对数据的互惠贡献,建立其在MLLM能力中的深层连接。随后,我们从数据-模型共同发展的视角对现有MLLM工作进行全面审查,揭示了推进数据-模型共同发展范式的巨大潜力,主要归因于缺乏对数据和模型之间协同作用的专注。基于获得的见解,我们描绘了若干进步的未来方向,以更好地利用数据和模型之间的互补,从基础设施到各种自我增强程度的数据-模型共同发展。该综述的主要贡献有三点: * MLLM开发的新视角:我们提出了一种新分类法,强调多模态数据与MLLM之间的协同作用,旨在理解和挖掘数据和模型开发的互惠优势。该分类法系统地基于开发MLLM所需的数据相关技术的层次结构进行组织,为研究人员和开发人员提供了推进MLLM的清晰视角。 * 从数据-模型共同发展视角对MLLM的最新综述:我们系统地回顾了快速增长的MLLM工作,阐明1)哪些MLLM能力可以通过特定的数据中心方法增强,2)经过良好训练的模型的能力如何反过来支持数据中心方法。据我们所知,这是第一篇从数据-模型共同发展视角对MLLM进行综述的论文。 * MLLM未来的路线图:我们提供了一个进步组织的路线图,涵盖若干先进和有前途的子方向,重点关注数据和MLLM之间的内部互动。通过这项工作,我们希望为学术研究人员和工业从业者在MLLM不断发展的领域提供灵感和指导。

组织结构。本文余下部分的组织如下。第二节提供了背景,包括背景知识、分类法以及与现有相关综述的定性比较。第三节介绍了扩展MLLM的数据中心方法。第四节总结了提高MLLM可用性的数据中心方法。第五节描述了模型直接帮助策划MLLM数据集的能力。第六节整理了模型作为数据科学家辅助策划MLLM数据集的应用。第七节列出了一些公开的MLLM数据集,并标明模型在数据策划中的参与。第八节讨论了MLLM未来发展的路线图。